Recast Navigation 详解

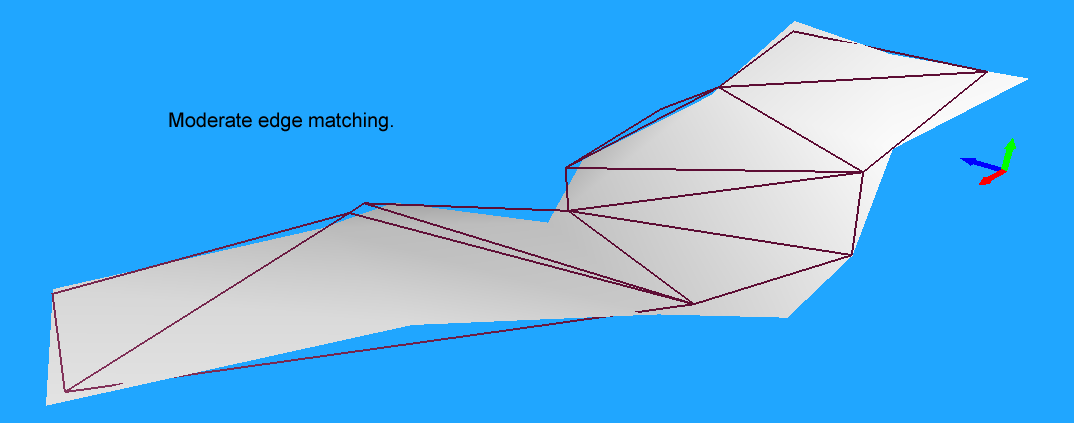

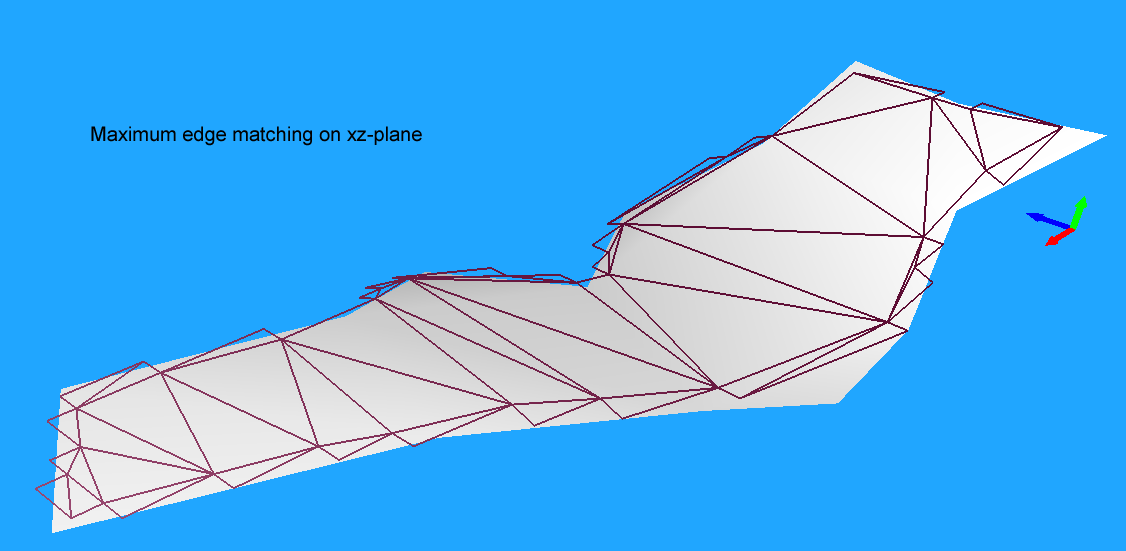

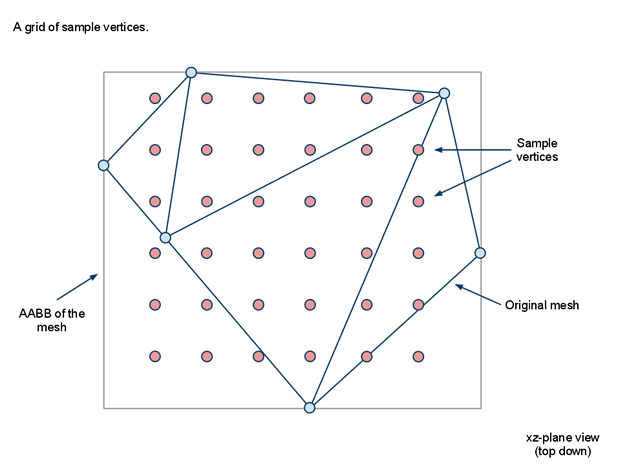

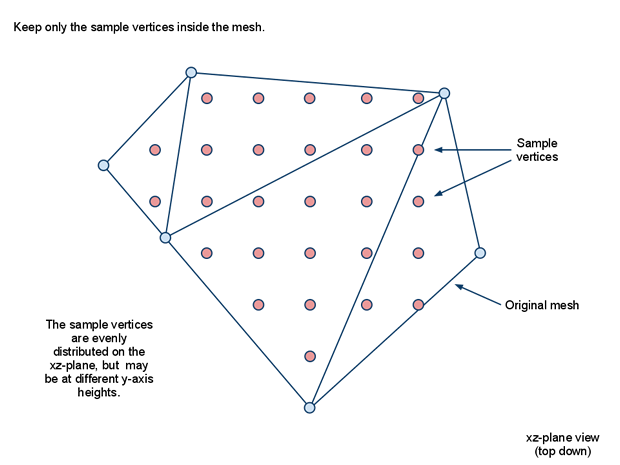

Recast Navigation自2012年开源在github上之后,由于其生成NavMesh的速度快,运行时内存占用小,接入方便等有点,迅速的成为了游戏业界三维场景地表寻路的标准解决方案。两大主流游戏引擎Unity、Unreal以及网易的Messiah、NeoX引擎等自带的寻路方案都是基于开源版本进行的修改迭代而来。由于Recast Navigation作为寻路解决基础方案的重要性,我们将在本章节中对其生成NavMesh的工作流程进行详解,方便理解其原理以及后续的参数调优。

recast navigation 的基本步骤

recast navigation软件按照功能可以分为三个部分:

- 负责生成场景对应

NavMesh的recast部分 - 使用

NavMesh来执行连通路径寻找的detour部分 - 使用连通路径驱动多个寻路

entity位置更新的DetourCrowd部分

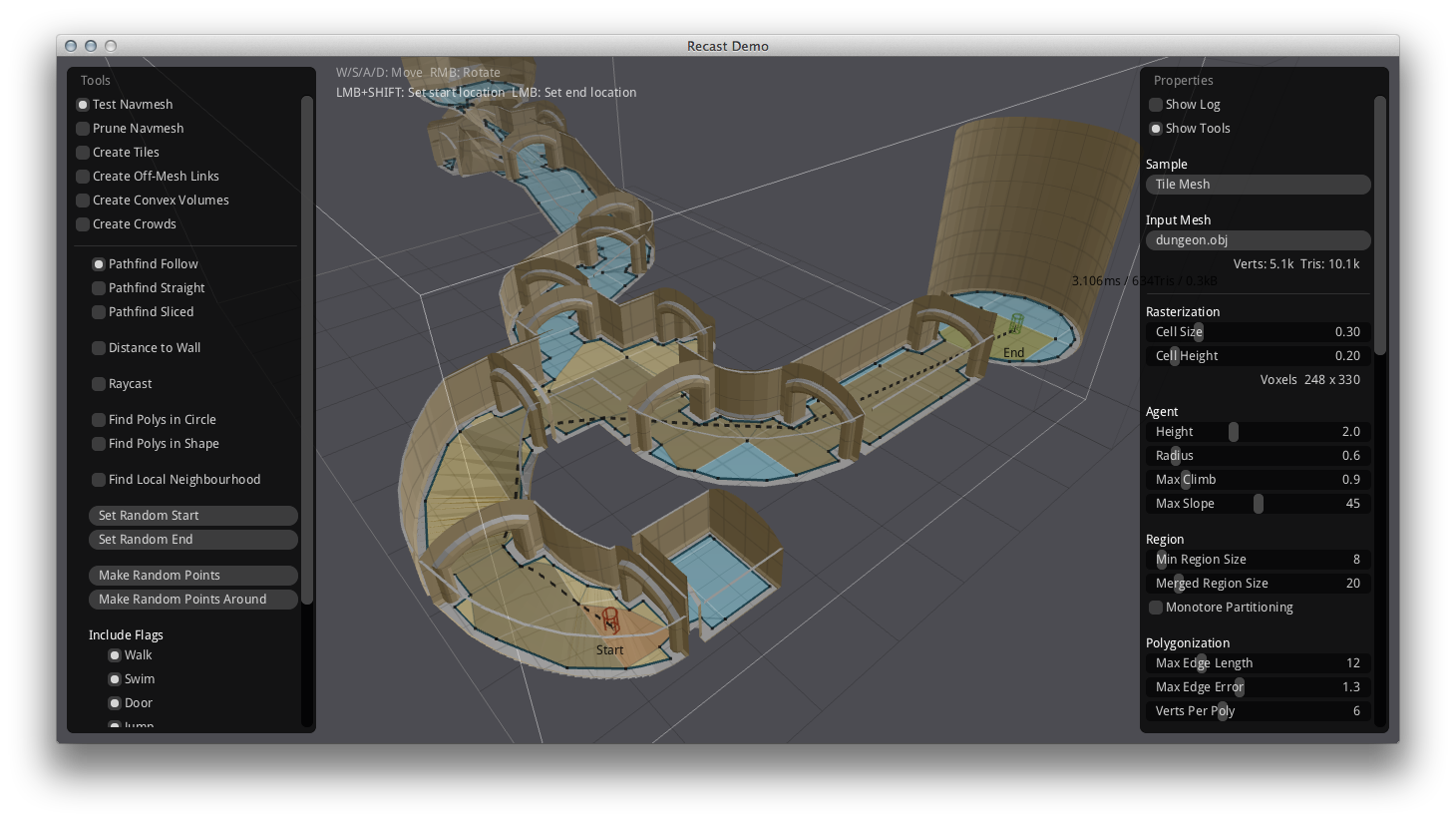

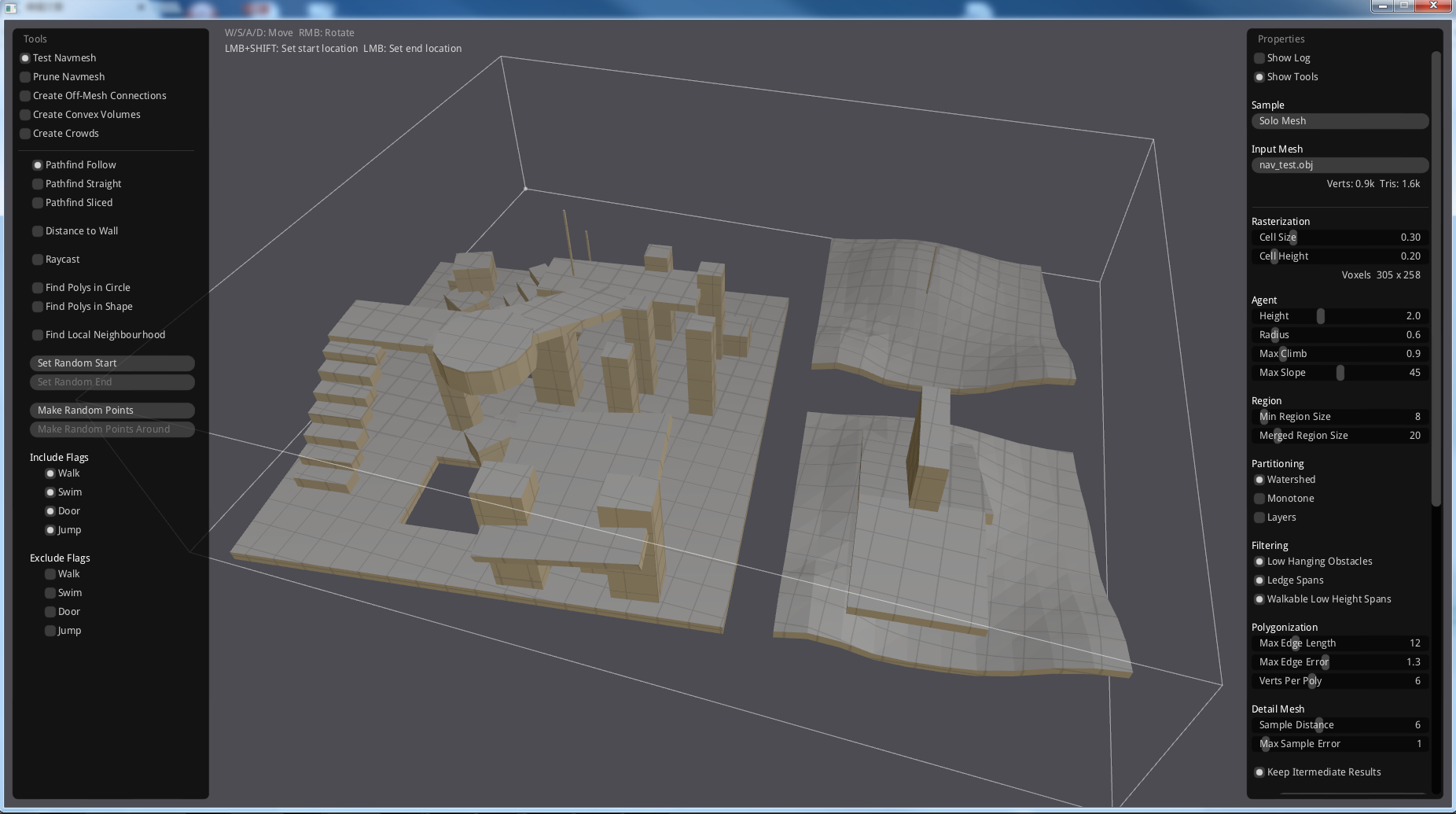

此外此软件自带一个可视化的编辑器RecastDemo来展示recast和detour的各阶段执行结果。

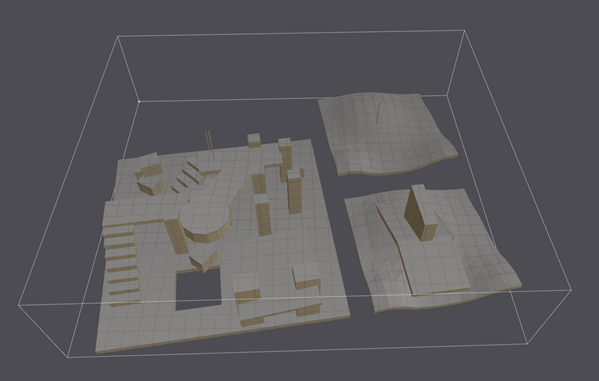

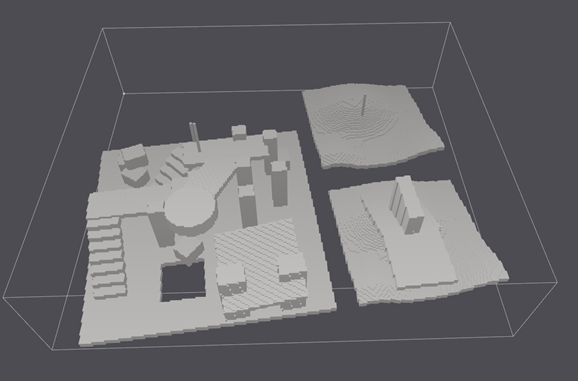

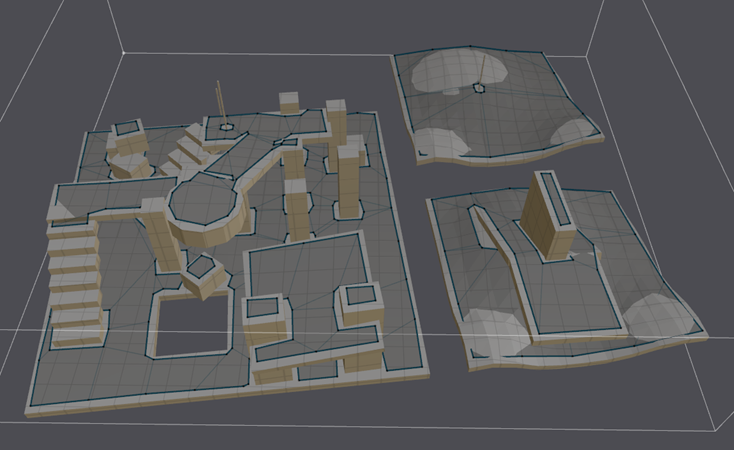

本章内容主要介绍其中的Recast部分,Detour和DetourCrowd部分将在后面的群体寻路章节中进行介绍。在这个RecastDemo程序中,我们首先需要导入obj格式的场景文件:

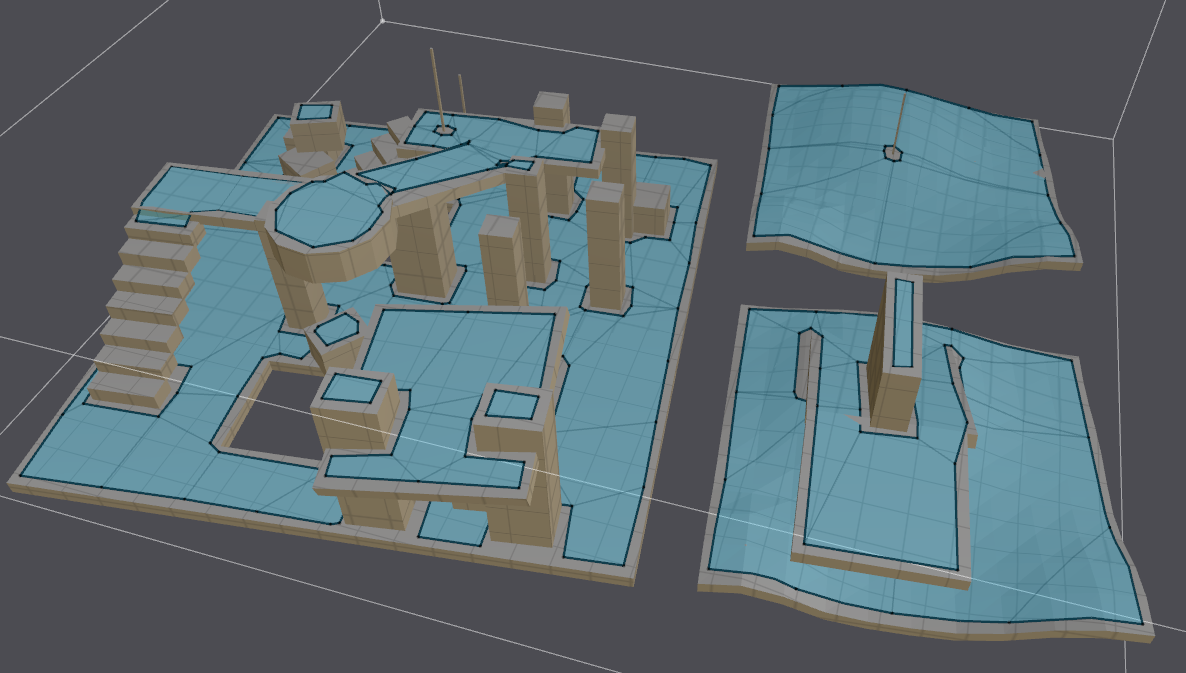

导入完成之后,配置好相关的参数,再点击生成按钮,即可获取如下的带NavMesh可视化的结果,图中的浅蓝色区域代表NavMesh中的多边形构造的可行走表面:

当然从场景数据生成NavMesh的过程并不是点击几下按钮这么简单,它其实包括了如下几个步骤:

- 导入场景并配置生成

NavMesh的相关参数

- 将场景进行体素化

-

筛选可行走表面 这里主要过滤掉一些会引起圆柱体寻路时与环境穿插的情况

-

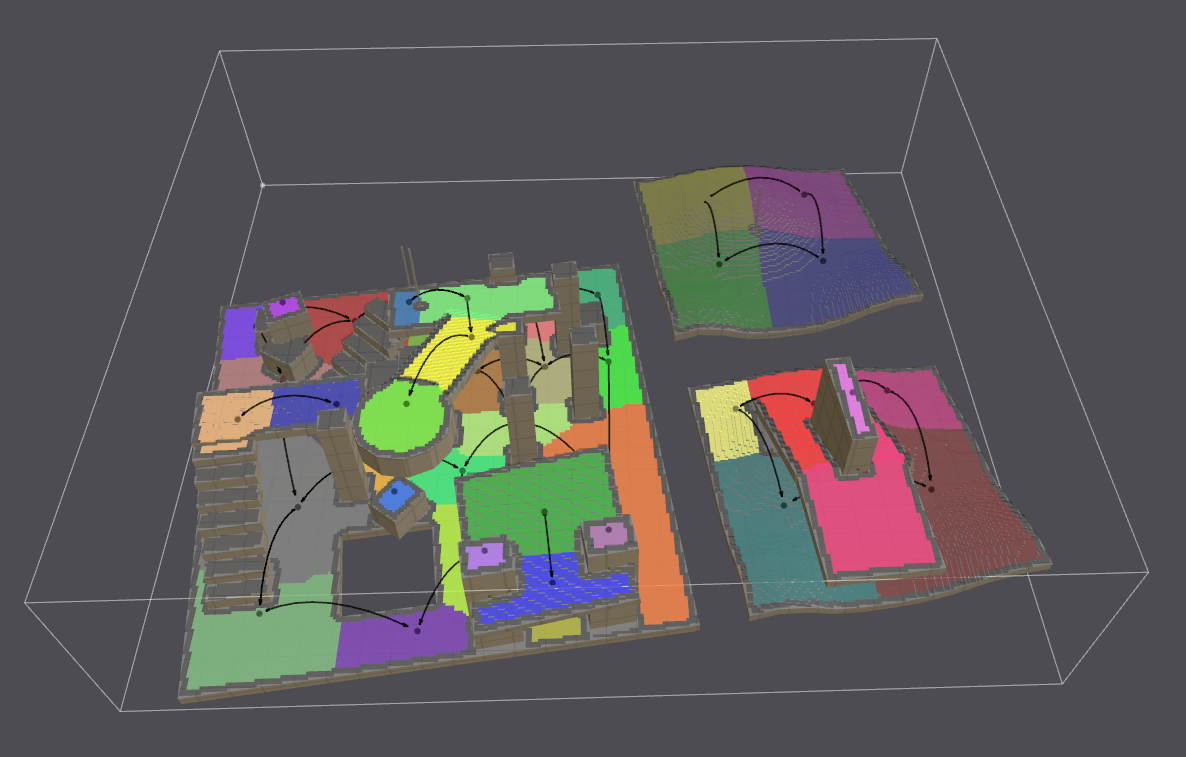

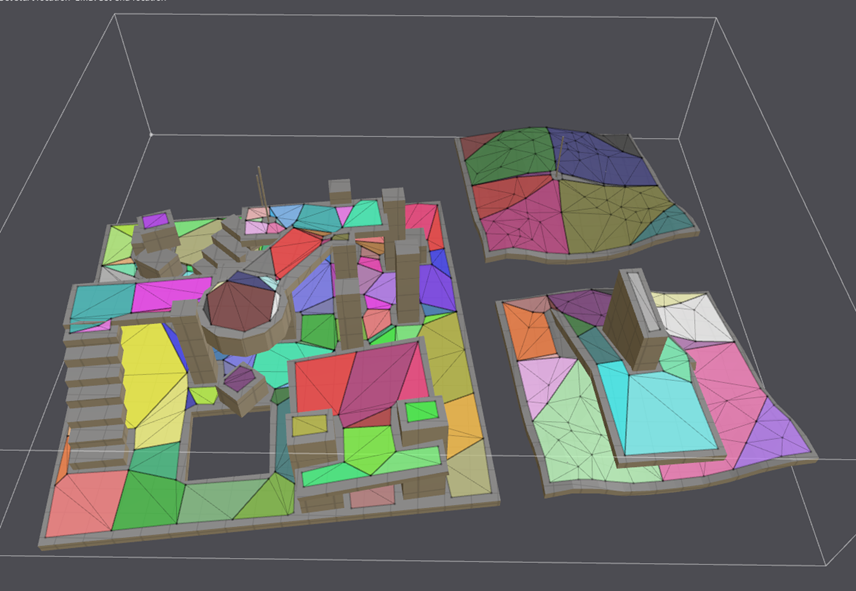

将可行走表面拆分为多片连续的区域,下图中每个颜色代表一个区域,每条黑色的弧形边代表对应的两个区域连通

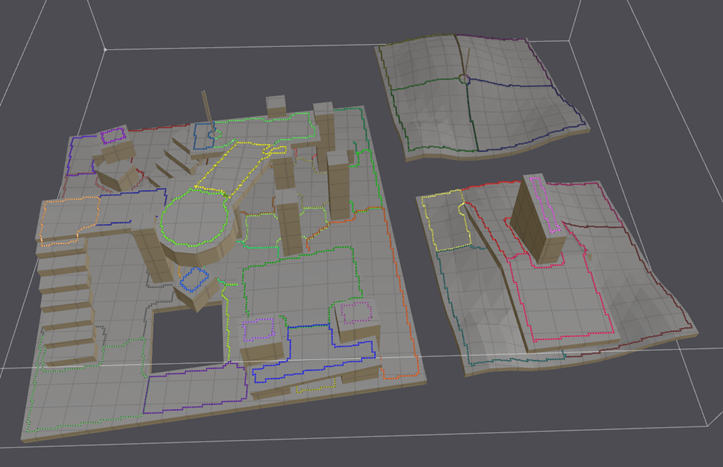

- 将各个区域的轮廓进行平滑,减少用来后续要处理的顶点数量

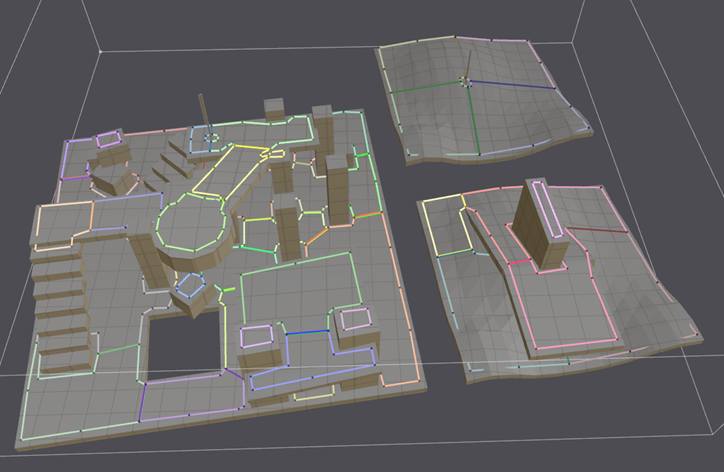

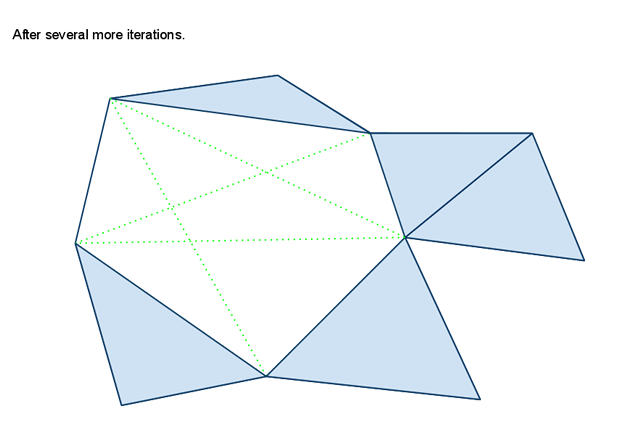

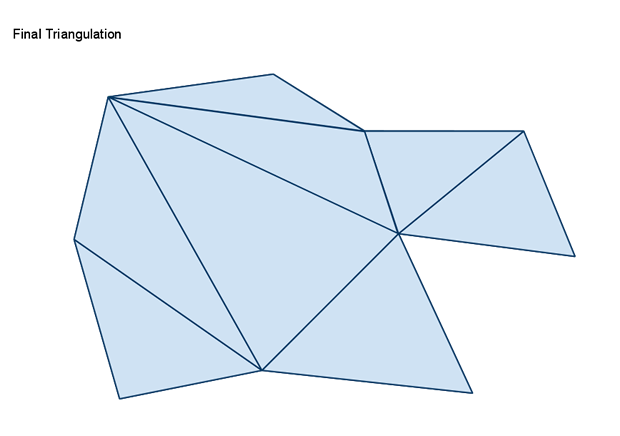

- 对各个区域进行三角划分,然后执行三角合并,生成凸多边形

Mesh

- 创建细节

Mesh数据以贴合地表

- 生成最后的导航网格

后续我们将对这八个步骤对照源代码进行详解。

加载场景数据

Recast支持的场景描述文件为Wavefront格式的OBJ文件,在源码目录的RecastDemo/Bin/Meshes里提供了多个样例文件。这个OBJ格式规范比较简单,是基于行的文本文件。OBJ文件由一行行文本组成,注释行以一个#为开头,空格和空行可以随意加到文件中以增加文件的可读性。有字的行都由一两个标记字母也就是关键字(Keyword)开头,关键字可以说明这一行是什么样的数据。多行可以逻辑地连接在一起表示一行,方法是在每一行最后添加一个连接符\。Recast支持了下面几种基本关键字:

v几何体顶点(Geometric vertices)后续接着三个浮点数代表这个顶点的坐标,例如v -0.58 0.84 0,所有的顶点都会赋予一个隐式的递增编号,编号的值为此顶点的出现顺序,第一个编号为1vn顶点法线(Vertex normals)后续接着三个浮点数代表此法线的坐标,例如vn 0.000000 -1.000000 0.000000,这个顶点法线也有一个隐士递增编号,规则与几何体顶点一样vt贴图坐标点(Texture vertices)后续接着两个浮点数,例如vt 0.0 0.5,贴图坐标点也有类似于几何体顶点的编号规则f代表多边形的面 后续接着多个个三元组, 每个三元组都有一个整数,分别索引到几何体顶点、顶点法线、贴图坐标点,样例f 1/1/1 2/2/2 4/4/3就声明了一个三角形,多边形内的点的坐标以逆时针排列

recast加载OBJ格式文件的代码在bool rcMeshLoaderObj::load(const std::string& filename)中,其加载逻辑忽略了所有的vn、vt分量,同时对于读取到的多边形面数据,进行拆分为多个三角形:

nv = parseFace(row+1, face, 32, m_vertCount);

for (int i = 2; i < nv; ++i)

{

const int a = face[0];

const int b = face[i-1];

const int c = face[i];

if (a < 0 || a >= m_vertCount || b < 0 || b >= m_vertCount || c < 0 || c >= m_vertCount)

continue;

addTriangle(a, b, c, tcap);

}

添加完成所有的三角形之后,再分别计算每个三角形的面法线数据:

// Calculate normals.

m_normals = new float[m_triCount*3];

for (int i = 0; i < m_triCount*3; i += 3)

{

const float* v0 = &m_verts[m_tris[i]*3];

const float* v1 = &m_verts[m_tris[i+1]*3];

const float* v2 = &m_verts[m_tris[i+2]*3];

float e0[3], e1[3];

for (int j = 0; j < 3; ++j)

{

e0[j] = v1[j] - v0[j];

e1[j] = v2[j] - v0[j];

}

float* n = &m_normals[i];

n[0] = e0[1]*e1[2] - e0[2]*e1[1];

n[1] = e0[2]*e1[0] - e0[0]*e1[2];

n[2] = e0[0]*e1[1] - e0[1]*e1[0];

float d = std::sqrt(n[0]*n[0] + n[1]*n[1] + n[2]*n[2]);

if (d > 0)

{

d = 1.0f/d;

n[0] *= d;

n[1] *= d;

n[2] *= d;

}

}

上面循环中的e0,e1代表三角形的两条首尾相连逆时针的边,而n则是这两个向量计算出来的叉积,这个叉积的方向一定是与当前面垂直的,同时代表当前面的正向,最后再单位化。

同时在RecastDemo中为了支持点击获取三角形的操作,还对加载好的OBJ文件做了一个BVH结构,创建了一个rcChunkyTriMesh来加速点选查询:

#define float float

bool rcCreateChunkyTriMesh(const float* verts, const int* tris, int ntris,

int trisPerChunk, rcChunkyTriMesh* cm)

参数中的verts存储了所有的节点,tris存储了所有的三角形面,ntris代表有多少个三角形,trisPerChunk代表BVH树的叶子节点里存储的三角形的数量。这个函数初始时需要构造好所有的BVH Node和所有三角形的AABB Bound:

struct BoundsItem

{

float bmin[2];

float bmax[2];

int i;

};

int nchunks = (ntris + trisPerChunk-1) / trisPerChunk;

cm->nodes = new rcChunkyTriMeshNode[nchunks*4];

if (!cm->nodes)

return false;

cm->tris = new int[ntris*3];

if (!cm->tris)

return false;

cm->ntris = ntris;

// Build tree

BoundsItem* items = new BoundsItem[ntris];

if (!items)

return false;

for (int i = 0; i < ntris; i++)

{

const int* t = &tris[i*3];

BoundsItem& it = items[i];

it.i = i;

// 这里有一些代码负责计算三角形的在XZ平面的AABB bound 直接忽略了高度轴Y轴

}

这里引入了两个结构体:

struct BoundsItem

{

float bmin[2];

float bmax[2];

int i;

};

struct rcChunkyTriMeshNode

{

float bmin[2];

float bmax[2];

int i;

int n;

};

BoundsItem就代表一个只在XZ平面的AABB包围盒,而rcChunkyTriMeshNode代表BVH树之中的节点,这里除了有包围盒信息之外,还有两个字段i,n:

i如果为非负数则代表这个节点是叶子节点,i的值就是其包含的多个连续三角形在cm->tris的开始索引,此时n则代表内部包含的三角形的个数i如果为负数,则其绝对值代表其下面各个层级的子节点的总数,

这里不存储左右两个子节点的偏移量是因为左子节点相对于当前节点的偏移量永远是1,即使用了下图的存储方式

这里用一个连续的数组来存储BVH树。做好这些准备工作之后,开始调用subdivide函数执行BVH的递归划分过程:

int curTri = 0;

int curNode = 0;

subdivide(items, ntris, 0, ntris, trisPerChunk, curNode, cm->nodes, nchunks*4, curTri, cm->tris, tris);

delete [] items;

cm->nnodes = curNode; //存储最终使用了多少个节点

这个函数的签名如下:

static void subdivide(BoundsItem* items, int nitems, int imin, int imax, int trisPerChunk,

int& curNode, rcChunkyTriMeshNode* nodes, const int maxNodes,

int& curTri, int* outTris, const int* inTris)

这里需要讲解一下相关的参数定义:

items代表存储mesh中所有三角形包围盒的数组开始指针,递归时此参数不变nitems代表mesh中三角形的个数,递归时此参数不变imin代表当前节点要处理的三角形的开始索引imax代表当前节点要处理的三角形的结束索引trisPerChunk代表叶子节点里存储的三角形最大个数,递归时此参数不变curNode,代表当前的BVH节点的索引,每次执行subdivide之后这个值都会递增,这样就做到了一个节点内的所有子节点都是连续分配的nodes代表BVH节点的存储数组,递归时此参数不变maxNodes代表nodes里最大可用索引,递归时此参数不变curTri代表下一个可以使用的存储三角形顶点序列数组的索引outTris代表存储三角形顶点序列的数组开始地址,递归时此参数不变inTris代表最开始mesh中三角形的存储数组开始地址

了解这些参数的定义之后,我们才能更好的理解递归划分的流程。首先记录当前需要处理的节点索引以及三角形的数量:

int inum = imax - imin; // 当前节点内三角形的个数

int icur = curNode; // 当前节点的索引

rcChunkyTriMeshNode& node = nodes[curNode++];

然后判断剩余三角形的个数是否小于等于了trisPerChunk,此时不再执行递归划分:

if (inum <= trisPerChunk)

{

// 计算当前nodes aabb 包围盒大小

calcExtends(items, nitems, imin, imax, node.bmin, node.bmax);

// 将对应的三角形数据复制到outTris中

node.i = curTri;

node.n = inum;

for (int i = imin; i < imax; ++i)

{

const int* src = &inTris[items[i].i*3];

int* dst = &outTris[curTri*3];

curTri++; // 注意这里每次复制一个三角形,这里的索引都需要递增

dst[0] = src[0];

dst[1] = src[1];

dst[2] = src[2];

}

}

面对递归处理的情况,需要选择是从X轴还是从Z轴进行分裂,这里选用一个最简单的方法,计算AABB包围盒之后,使用包围盒长度最长的轴进行分裂:

// Split

calcExtends(items, nitems, imin, imax, node.bmin, node.bmax);

int axis = longestAxis(node.bmax[0] - node.bmin[0],

node.bmax[1] - node.bmin[1]);

if (axis == 0)

{

// Sort along x-axis

qsort(items+imin, static_cast<size_t>(inum), sizeof(BoundsItem), compareItemX);

}

else if (axis == 1)

{

// Sort along y-axis

qsort(items+imin, static_cast<size_t>(inum), sizeof(BoundsItem), compareItemY);

}

这里使用了一个快速排序,将[items+imin, items+imax)区间内的数据进行了按照对应的坐标轴数组进行排序。排完序之后,使用中点的索引进行切分为两组连续的三角形,执行递归调用:

int isplit = imin+inum/2; // 中点的索引

// Left

subdivide(items, nitems, imin, isplit, trisPerChunk, curNode, nodes, maxNodes, curTri, outTris, inTris);

// Right

subdivide(items, nitems, isplit, imax, trisPerChunk, curNode, nodes, maxNodes, curTri, outTris, inTris);

注意这里是先执行左子节点[imin, isplit)的subdivide,然后再执行右子节点[isplit, imax)的subdivide,因为只有这样才能保证左子节点的索引为父节点的索引加1。两个子节点都划分好了之后,curNode里存储的就是下一个可以使用的节点索引,减去当前节点的索引我们就可以得到当前节点的所有子节点的个数:

int iescape = curNode - icur;

// 这里用负数来存 用来跟叶子节点区分开

node.i = -iescape;

至此一个基于数组连续存储的BVH递归划分结束。这个BVH主要是用来支持raycast操作,即查询一条线段与Mesh的相交点,最典型的应用就是查询当前点在Mesh上的投影位置。期间会有一个初步筛选的工作来获取所有与这个线段相交的BVH节点:

int rcGetChunksOverlappingSegment(const rcChunkyTriMesh* cm,

float p[2], float q[2],

int* ids, const int maxIds)

{

// Traverse tree

int i = 0;

int n = 0;

while (i < cm->nnodes)

{

const rcChunkyTriMeshNode* node = &cm->nodes[i];

const bool overlap = checkOverlapSegment(p, q, node->bmin, node->bmax);

const bool isLeafNode = node->i >= 0;

if (isLeafNode && overlap)

{

if (n < maxIds)

{

ids[n] = i;

n++;

}

}

if (overlap || isLeafNode)

i++;

else

{

const int escapeIndex = -node->i;

i += escapeIndex;

}

}

return n;

}

初始的时候使用将要处理的节点设置为根节点,然后每次对当前要处理的节点进行如下操作:

- 计算当前节点的

AABB包围盒是否与线段相交 - 如果当前节点是叶子节点且相交 则将这个节点记录到结果中

- 如果当前节点的包围盒与线段相交或者当前节点是叶子节点,则将节点索引加

1,进行下一步处理 - 如果包围盒不相交且不是叶子节点,则跳过当前节点的所有子节点,因为这些子节点一定不会再与线段相交

上面的步骤3中的加1操作其实就是获取二叉树先序遍历树时当前节点的后继,这里对应了三种情况:

- 当前节点是非叶子节点,先序遍历的后继就是当前节点的左子节点,

- 当前节点是叶子节点,且是父节点的左子节点,先序遍历的后继就是当前父节点的右子节点,

- 当前节点是叶子节点,且是父节点的右子节点,先序遍历的后继则需要递归找到其父节点链条中第一个作为左子节点存在的点,然后获取这个节点的兄弟节点

之前我们构造BVH树分配节点索引的规则刚好满足这三种情况下的后继节点的索引都只需要加1即可获得。有了这个函数之后,真正的raycast函数执行的逻辑就比较简单了:

bool InputGeom::raycastMesh(float* src, float* dst, float& tmin)

{

// Prune hit ray.

float btmin, btmax;

if (!isectSegAABB(src, dst, m_meshBMin, m_meshBMax, btmin, btmax))

return false;

float p[2], q[2];

p[0] = src[0] + (dst[0]-src[0])*btmin;

p[1] = src[2] + (dst[2]-src[2])*btmin;

q[0] = src[0] + (dst[0]-src[0])*btmax;

q[1] = src[2] + (dst[2]-src[2])*btmax;

int cid[512];

const int ncid = rcGetChunksOverlappingSegment(m_chunkyMesh, p, q, cid, 512);

if (!ncid)

return false;

tmin = 1.0f;

bool hit = false;

const float* verts = m_mesh->getVerts();

for (int i = 0; i < ncid; ++i)

{

const rcChunkyTriMeshNode& node = m_chunkyMesh->nodes[cid[i]];

const int* tris = &m_chunkyMesh->tris[node.i*3];

const int ntris = node.n;

for (int j = 0; j < ntris*3; j += 3)

{

float t = 1;

if (intersectSegmentTriangle(src, dst,

&verts[tris[j]*3],

&verts[tris[j+1]*3],

&verts[tris[j+2]*3], t))

{

if (t < tmin)

tmin = t;

hit = true;

}

}

}

return hit;

}

不过由于我们前面建立的BVH只处理了XZ平面,所以后面还需要执行一个for循环使用intersectSegmentTriangle去过滤掉不相交的三角形。这个函数调用还可以计算出相交点相对于起点的长度,最终结果选取长度最小的那个交点,作为第一个相交点。其具体执行流程为先计算三角形平面的法线,然后计算起点到这个平面的投影点,利用投影点计算出射线与三角形平面的交点,判断这个交点是否在三角形内。

场景体素化

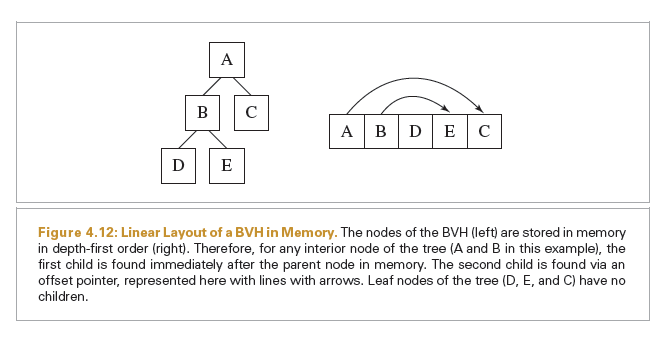

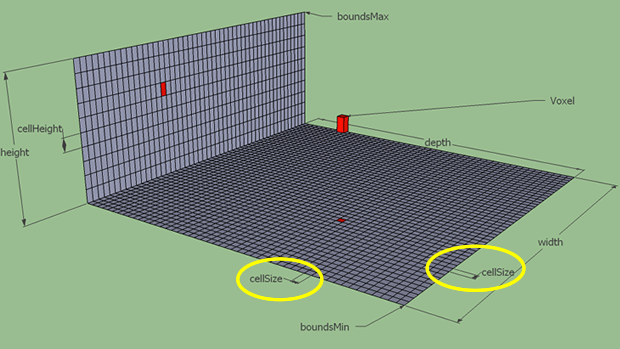

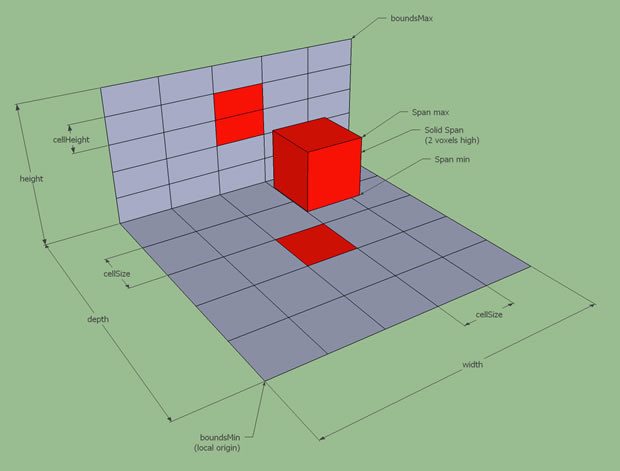

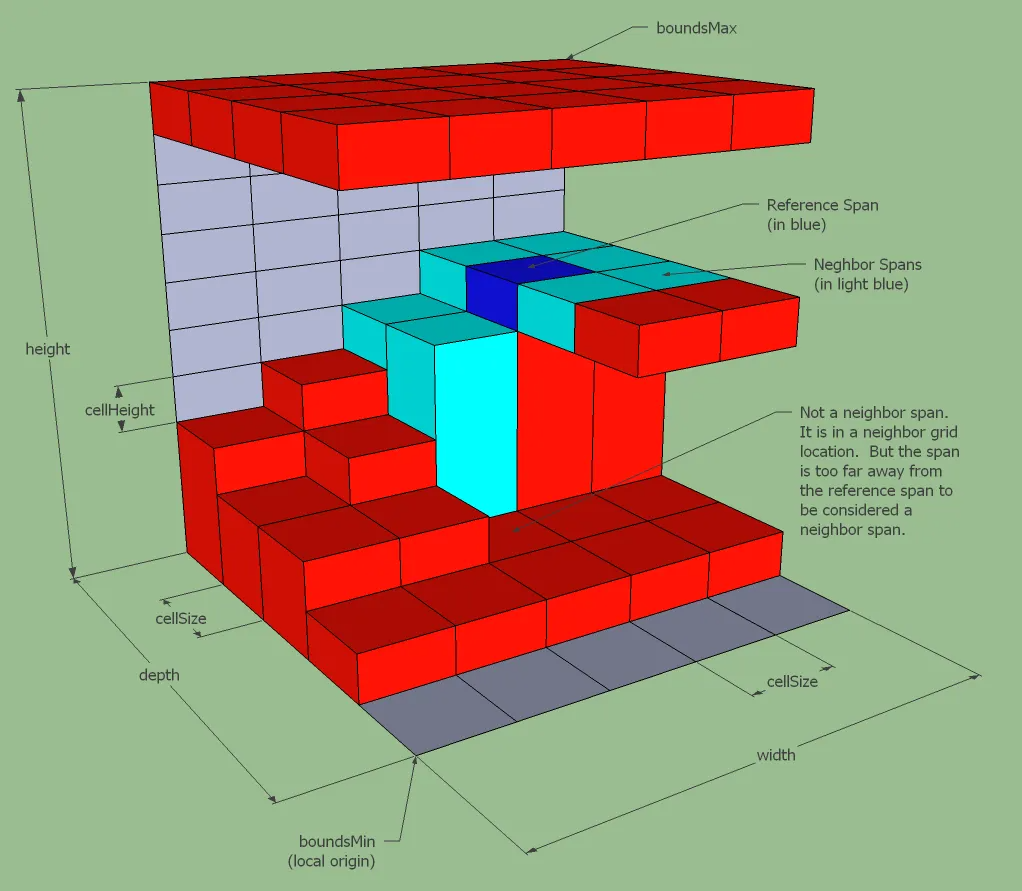

这里的体素化与前面章节里提到的体素化定义是一致的,不过前述章节中我们为了讨论方便,将体素设定为立方体的形状,在recast中放松了此设定,变成了一个底面为正方形的长方体:

此时长方体有两个可配置项:

cellSize代表体素地面的正方形边长cellHeight代表体素的高度

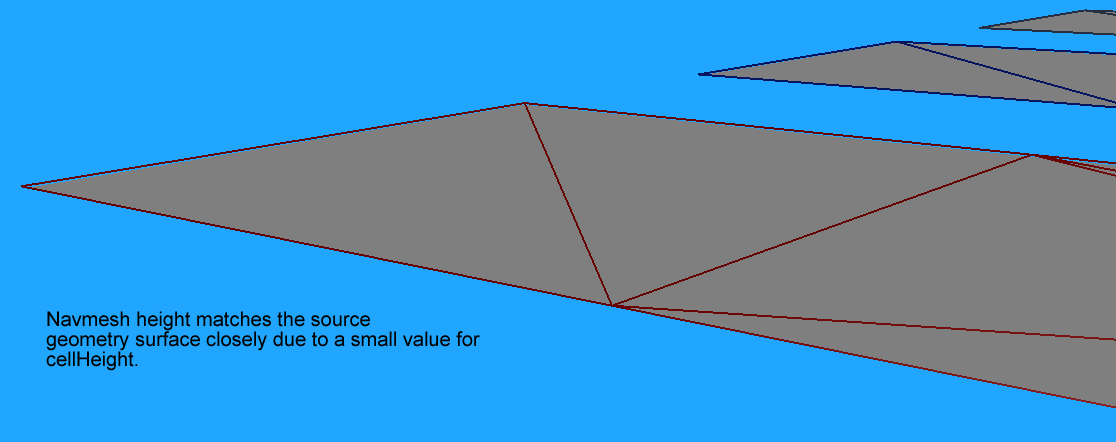

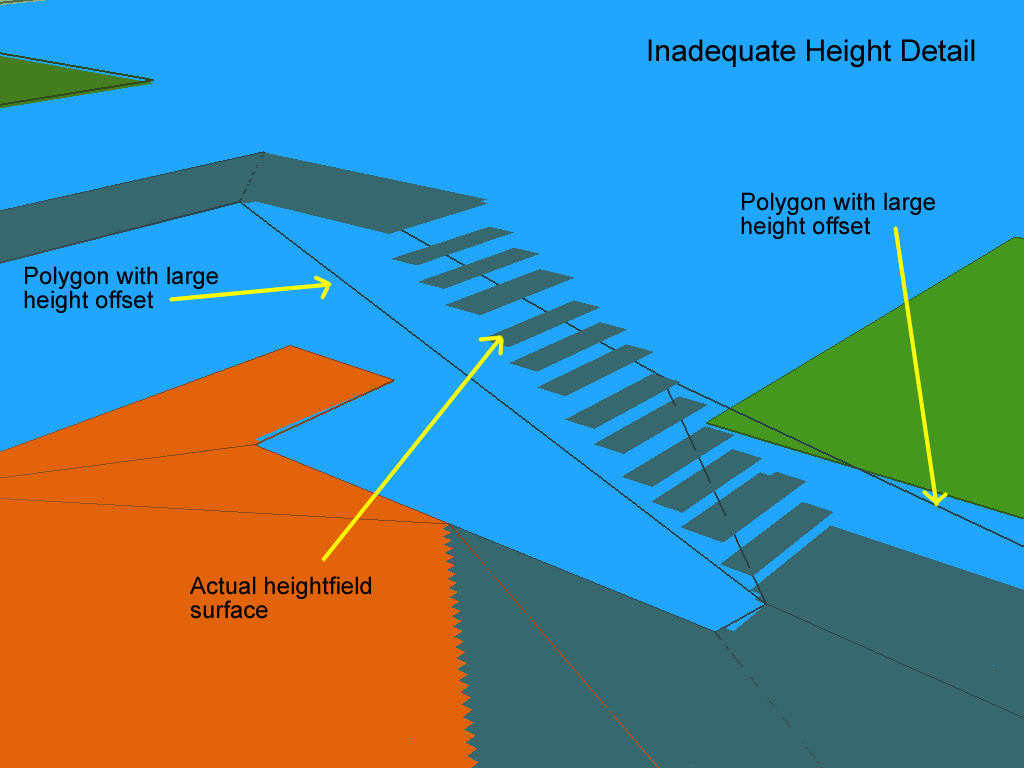

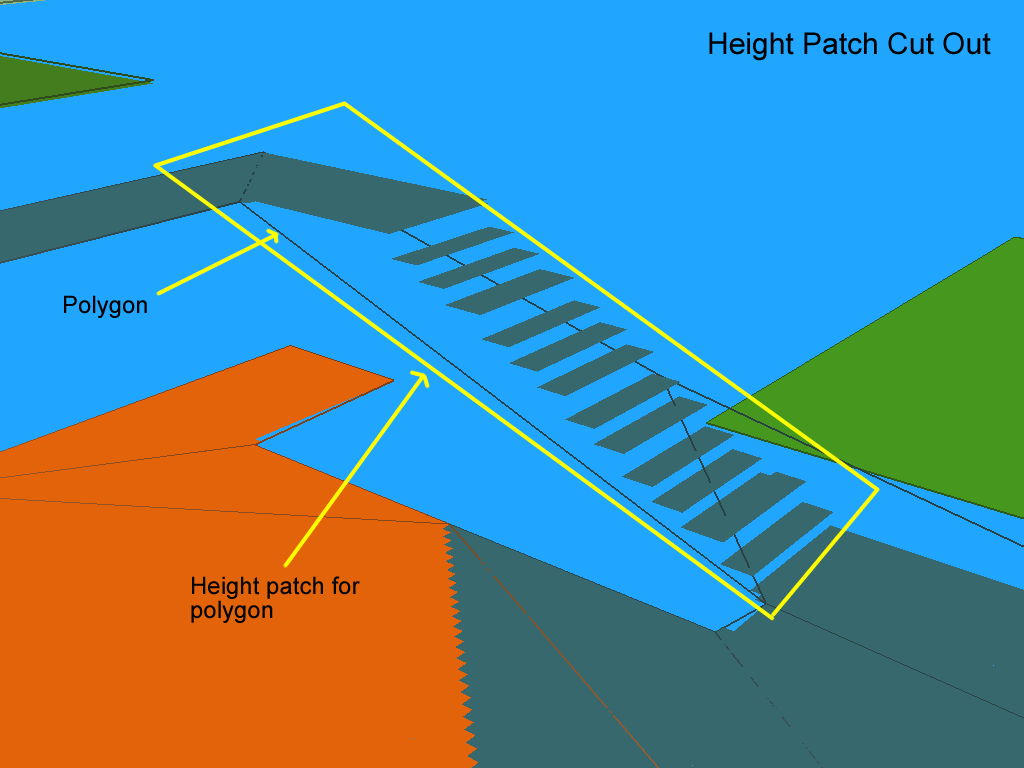

cellSize使用较低的值使得生成的网格更接近源几何形状,下图中就是使用大cellSize时最后生成的网格:

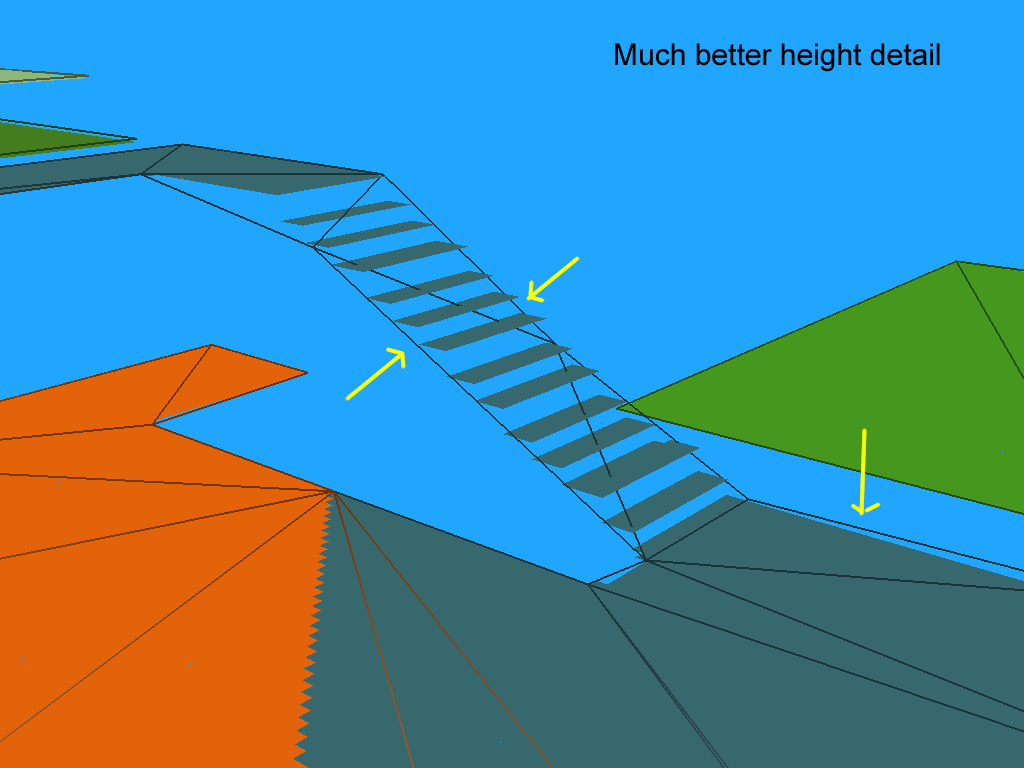

将这个参数调整小之后,就能获取一个更贴近边界的网格:

cellSize不是越小越好,设定的太小则需要更高的处理和内存成本,因为存储空间大概与cellSize*cellSize的大小成反比:

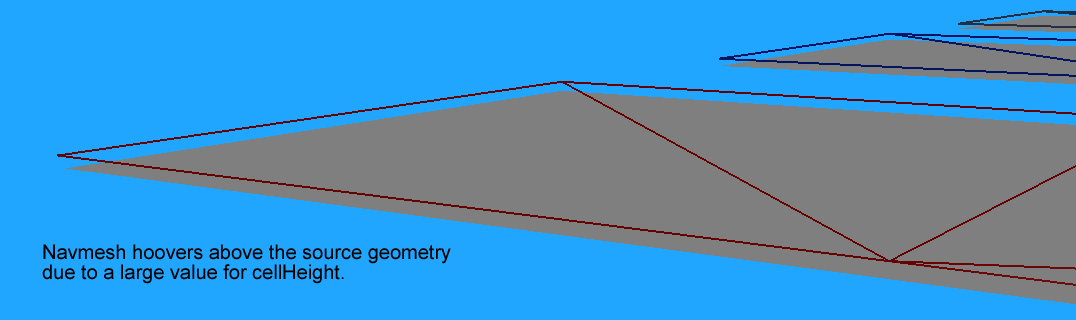

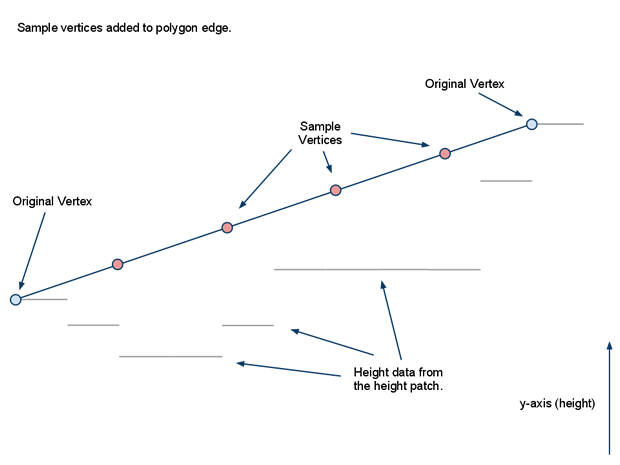

至于cellHeight这个参数,较小的值使得最终的网格更贴近几何形状的表面:

这个参数的设置会影响后续流程中所需要处理的多个参数,walkableHeight、walkableClimb 和 detailSampleMaxError需要大于这个值才能正常工作,所以经验值为walkableHeight、walkableClimb、cellSize,detailSampleMaxError的最小值的三分之一。

不过与cellSize不同的地方在于,使用较低的cellHeight值虽然同样会增加处理的耗时,但是不会显著增加内存使用,因为我们在存储每一列数据的时候使用了span这样的结构去优化。不过这里使用的span记录的是连续的实心阻挡区域,而前面章节的span记录的是连续的空心非阻挡区域。

对应的结构体声明与我们之前定义的span类似:

/// Defines the number of bits allocated to rcSpan::smin and rcSpan::smax.

static const int RC_SPAN_HEIGHT_BITS = 13;

/// Defines the maximum value for rcSpan::smin and rcSpan::smax.

static const int RC_SPAN_MAX_HEIGHT = (1 << RC_SPAN_HEIGHT_BITS) - 1;

/// Represents a span in a heightfield.

/// @see rcHeightfield

struct rcSpan

{

unsigned int smin : RC_SPAN_HEIGHT_BITS; ///< The lower limit of the span. [Limit: < #smax]

unsigned int smax : RC_SPAN_HEIGHT_BITS; ///< The upper limit of the span. [Limit: <= #RC_SPAN_MAX_HEIGHT]

unsigned int area : 6; ///< The area id assigned to the span.

rcSpan* next; ///< The next span higher up in column.

};

不过这里为了省内存,使用了13个bit来存储以cellHeight来计算的高度,在cellHeight设置为10cm时,支持的场景最大高度为800M。rcSpan中还有一个area字段来做span的区域标记,默认情况下来标记这个span的上表面是否可以行走。

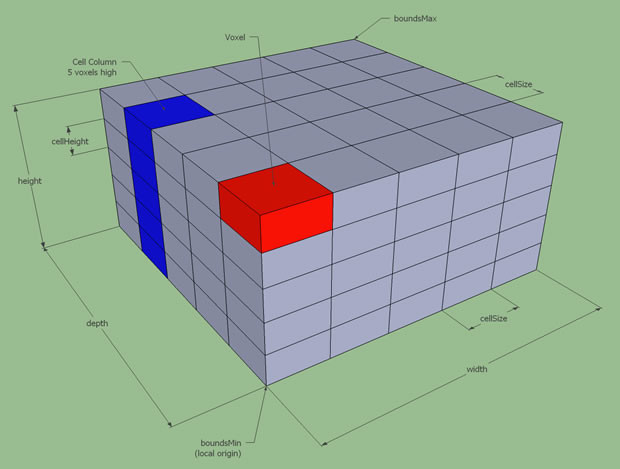

有了这个rcSpan之后,对应的实心高度场结构体定义如下:

/// The number of spans allocated per span spool.

/// @see rcSpanPool

static const int RC_SPANS_PER_POOL = 2048;

/// A memory pool used for quick allocation of spans within a heightfield.

/// @see rcHeightfield

struct rcSpanPool

{

rcSpanPool* next; ///< The next span pool.

rcSpan items[RC_SPANS_PER_POOL]; ///< Array of spans in the pool.

};

/// A dynamic heightfield representing obstructed space.

/// @ingroup recast

struct rcHeightfield

{

int width; ///< The width of the heightfield. (Along the x-axis in cell units.)

int height; ///< The height of the heightfield. (Along the z-axis in cell units.)

float bmin[3]; ///< The minimum bounds in world space. [(x, y, z)]

float bmax[3]; ///< The maximum bounds in world space. [(x, y, z)]

float cs; ///< The size of each cell. (On the xz-plane.)

float ch; ///< The height of each cell. (The minimum increment along the y-axis.)

rcSpan** spans; ///< Heightfield of spans (width*height).

rcSpanPool* pools; ///< Linked list of span pools.

rcSpan* freelist; ///< The next free span.

};

这里的spans就是一个行优先的二维数组,数组里每个rcSpan都是由rcSpanPool来进行分配的。采用Pool分配的好处就是避免频繁的调用malloc,直接走批量分配。而且由于所有的rcSpan的生命周期都是与rcHeightfield一致的,所以也不需要考虑单个rcSpan的free操作了,直接挂靠到freelist的开头即可。

static rcSpan* allocSpan(rcHeightfield& hf)

{

// If running out of memory, allocate new page and update the freelist.

if (!hf.freelist || !hf.freelist->next)

{

// Create new page.

// Allocate memory for the new pool.

rcSpanPool* pool = (rcSpanPool*)rcAlloc(sizeof(rcSpanPool), RC_ALLOC_PERM);

if (!pool) return 0;

// Add the pool into the list of pools.

pool->next = hf.pools;

hf.pools = pool;

// Add new items to the free list.

rcSpan* freelist = hf.freelist;

rcSpan* head = &pool->items[0];

rcSpan* it = &pool->items[RC_SPANS_PER_POOL];

do

{

--it;

it->next = freelist;

freelist = it;

}

while (it != head);

hf.freelist = it;

}

// Pop item from in front of the free list.

rcSpan* it = hf.freelist;

hf.freelist = hf.freelist->next;

return it;

}

static void freeSpan(rcHeightfield& hf, rcSpan* ptr)

{

if (!ptr) return;

// Add the node in front of the free list.

ptr->next = hf.freelist;

hf.freelist = ptr;

}

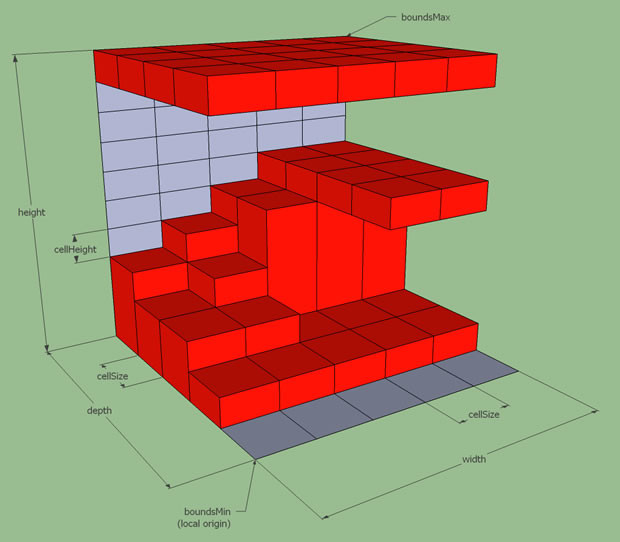

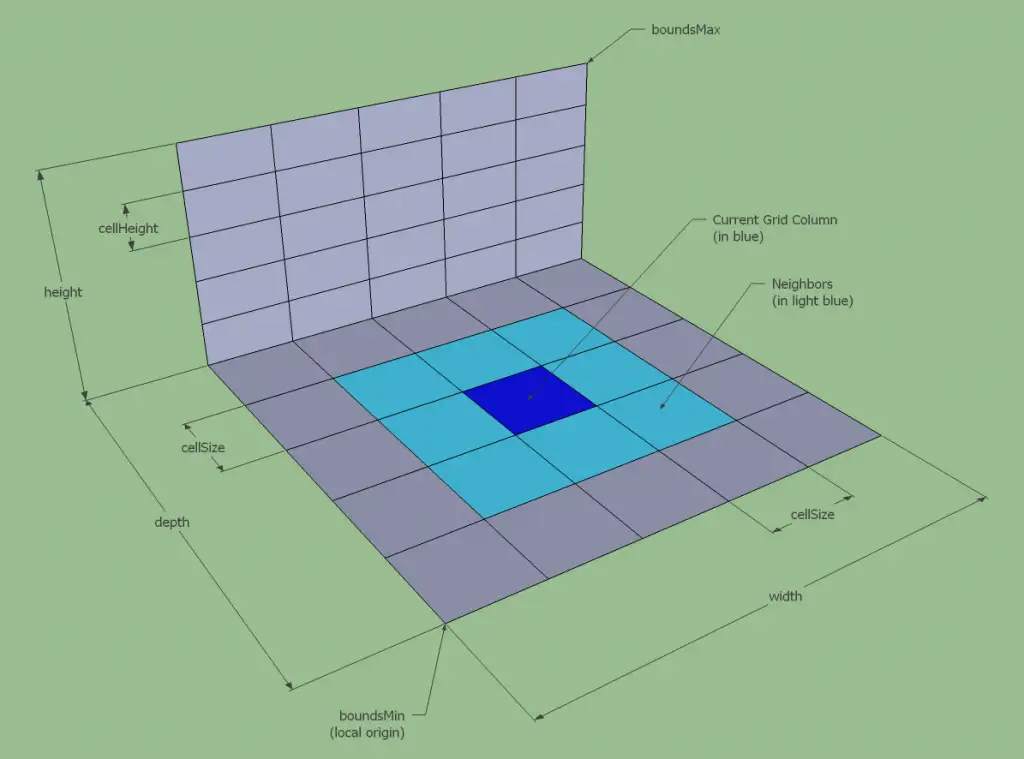

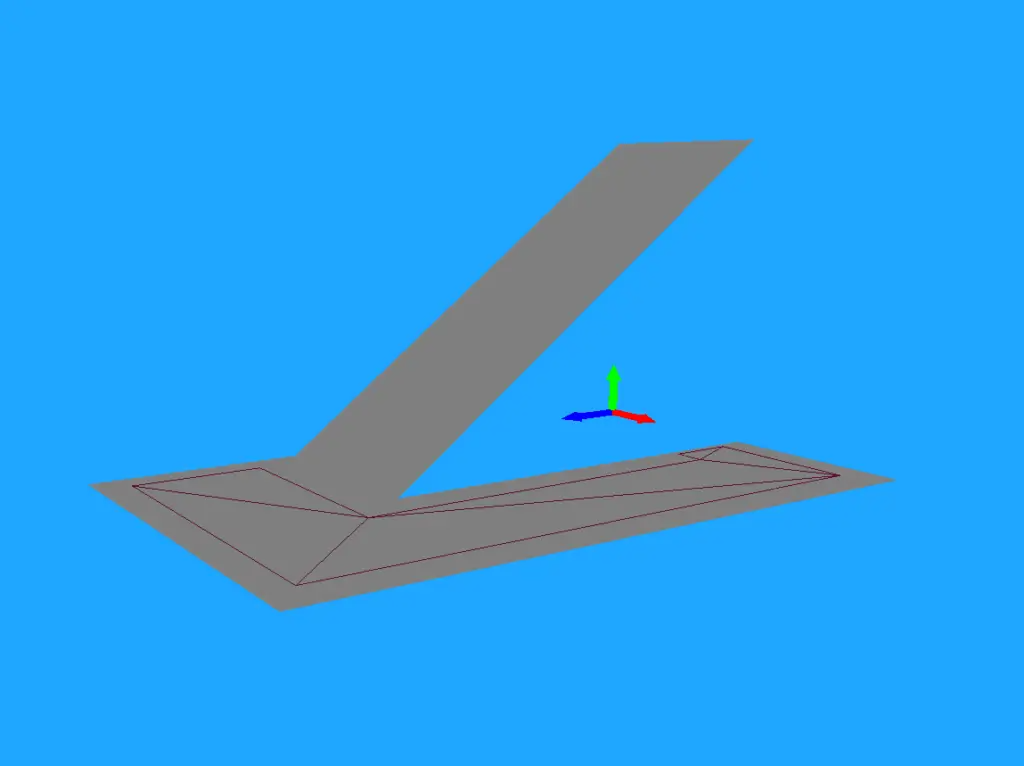

最后构造出来的实心高度场结构可视化如下图:

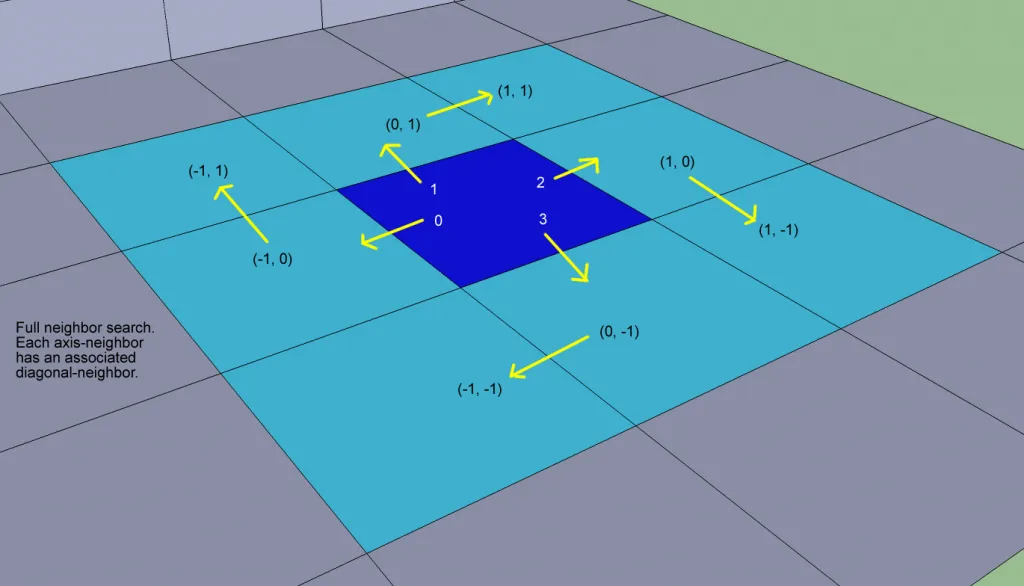

由于后续操作中经常需要执行搜索特定rcSpan的周围的邻居rcSpan的操作,这里的邻居rcSpan要满足两个需求:

- 投影在

XZ平面的网格与当前rcSpan网格相邻,即下图中的浅蓝色的8个格子

- 高度很接近

所以最终在高度场中一个rcspan的邻居rcspan如下:

有了存储所有体素数据的高度场结构定义之后,我们开始将输入Mesh里的所有三角形进行体素化,生成一个一个的体素并将相邻的体素合并为rcspan。

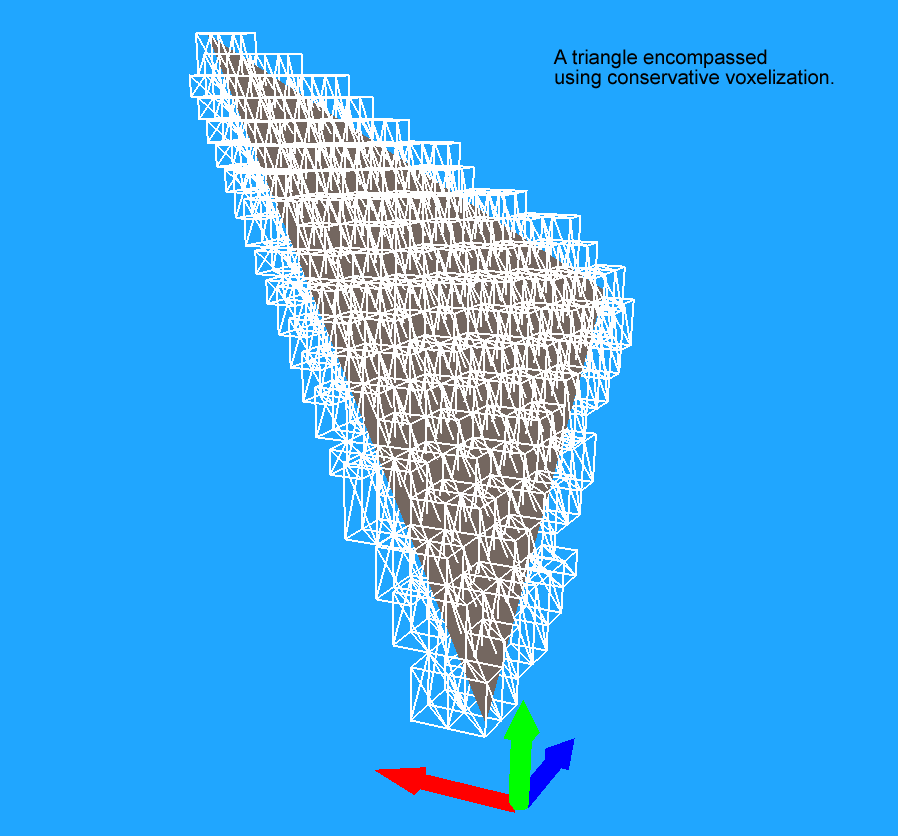

每个三角形都使用保守体素化的方式进行体素化并添加到高度场中。保守体素化是一种确保多边形表面完全被生成的体素包围的算法。下面是使用保守体素化包围三角形的一个例子:

对应的体素化实现函数声明如下:

static bool rasterizeTri(const float* v0, const float* v1, const float* v2,

const unsigned char area, rcHeightfield& hf,

const float* bmin, const float* bmax,

const float cs, const float ics, const float ich,

const int flagMergeThr)

这个函数包含了两重循环:

-

最外层循环是遍历这个三角形在

Z轴上的以cellSize计量的[z_begin, z_end)中的z,计算经过(0,0,z)的XY平面与三角形的相交区域生成的位于此平面左侧的凸多边形A,同时将右侧的三角形替换原始三角形 -

第二层循环则遍历这个

A的AABB在X轴投影[x_begin, x_end)中的x,计算经过(x,0,0)的YZ平面与A的相交区域生成的位于此平面左侧凸多边形B,计算B在Y轴以CellHeight计量的坐标[y_begin, y_end),构造对应的rcSpan,添加到高度场(x,z)对应的列的头部,同时将右侧的多边形替换原始的A

这里两层循环的执行都依赖于获取一个多边形与特定坐标轴垂直平面相交切分为两个凸多边形的计算,对应的函数声明定义如下:

// divides a convex polygons into two convex polygons on both sides of a line

static void dividePoly(const float* in, int nin,

float* out1, int* nout1,

float* out2, int* nout2,

float x, int axis)

这里的(in, nin)代表输入的多边形的坐标数组,axis代表对应的坐标轴索引,取值范围为0,1,2分别对应x,y,z三个轴,而 x则代表裁剪平面在此轴上的取值,out1,nout1和out2,nout2分别代表两个输出结果多边形的顶点列表,out1存储在对应坐标轴投影值都大于x值的多边形,out2则存储在对应坐标轴上投影值都小于x的多边形。了解了上述参数定义之后,我们再来看函数体:

float d[12]; // 存储原来的多边形的每个顶点与分割轴平面的距离

for (int i = 0; i < nin; ++i)

d[i] = x - in[i*3+axis];

int m = 0, n = 0;

for (int i = 0, j = nin-1; i < nin; j=i, ++i)

{

bool ina = d[j] >= 0;

bool inb = d[i] >= 0;

if (ina != inb) // 如果当前点与前一个点分属于 分割平面的两侧

{

float s = d[j] / (d[j] - d[i]); // 计算(i,j)两点之间的直线与分割平面相交的点的坐标

out1[m*3+0] = in[j*3+0] + (in[i*3+0] - in[j*3+0])*s;

out1[m*3+1] = in[j*3+1] + (in[i*3+1] - in[j*3+1])*s;

out1[m*3+2] = in[j*3+2] + (in[i*3+2] - in[j*3+2])*s;

rcVcopy(out2 + n*3, out1 + m*3);

// 分割点需要同时存入左右两个多边形的顶点列表中

m++;

n++;

// add the i'th point to the right polygon. Do NOT add points that are on the dividing line

// since these were already added above

if (d[i] > 0)

{

// 如果当前点在投影轴上的值大于x 则也加入到out1对应的多边形中

rcVcopy(out1 + m*3, in + i*3);

m++;

}

else if (d[i] < 0)

{

// 如果当前点在投影轴上的值小于x 则也加入到out2对应的多边形中

rcVcopy(out2 + n*3, in + i*3);

n++;

}

}

else // 如果都在平面的同一侧 则根据与x的差值计算是否加入到out1还是out2

{

// add the i'th point to the right polygon. Addition is done even for points on the dividing line

if (d[i] >= 0)

{

rcVcopy(out1 + m*3, in + i*3);

m++;

if (d[i] != 0) // 注意这里 如果当前点落在了分割平面上 则则个点会同时加入到两个多边形中

continue;

}

rcVcopy(out2 + n*3, in + i*3);

n++;

}

}

*nout1 = m;

*nout2 = n;

至此场景Mesh体素化的流程走完,高度场中已经拥有了基本的体素span信息,接下来我们需要对span的上表面计算是否可以行走,并更新area字段。这里是否可以行走的判定主要是通过判断这个体素来源的三角形的倾斜角度是否小于配置的参数walkableSlopeAngle,倾斜角小于这个值则代表可以行走,大于这个值则代表不可以行走:

对应的判定函数为rcMarkWalkableTriangles,其函数体比较简单,纯粹的几何向量运算:

/// The default area id used to indicate a walkable polygon.

/// This is also the maximum allowed area id, and the only non-null area id

/// recognized by some steps in the build process.

static const unsigned char RC_WALKABLE_AREA = 63;

void rcMarkWalkableTriangles(rcContext* ctx, const float walkableSlopeAngle,

const float* verts, int nv,

const int* tris, int nt,

unsigned char* areas)

{

rcIgnoreUnused(ctx);

rcIgnoreUnused(nv);

// 计算对应倾斜角度单位向量在x轴的投影值

const float walkableThr = std::cos(walkableSlopeAngle/180.0f*RC_PI);

float norm[3];

for (int i = 0; i < nt; ++i)

{

const int* tri = &tris[i*3];

// 计算这个三角形的单位法线向量 使用叉积计算法线方向然后单位化即可

calcTriNormal(&verts[tri[0]*3], &verts[tri[1]*3], &verts[tri[2]*3], norm);

// 这里的norm[1]就是与Y轴的投影值 如果投影值大于夹角的cos 则代表这个三角形与XZ平面的夹角小于 walkableSlopeAngle 可以行走

if (norm[1] > walkableThr)

areas[i] = RC_WALKABLE_AREA;

}

}

这里计算出来的area负责标记一个三角形体素化添加的所有rcSpan,但是由于多个三角形构造的rcSpan可能重叠,在执行rcSpan的合并时也要对area标记进行合并。两个rcSpan进行合并时,其对应的area标记更新规则如下:

-

如果两者的顶部高度相差小于爬升高度

walkableClimb则执行两个rcspan::area的最大值来更新 -

否则选取顶部最高的

rcSpan的area来更新

筛选可行走表面

rcSpan里的area标记了当前rcSpan是否是可以行走的,判定条件就是三角形的坡度小于walkableSlopeAngle。但是这个只是一个初步的筛选,通过了这个筛选也有可能是不可行走的,例如单独的悬空低坡度小三角形。一个rcSpan的顶部是否可以行走还需要做一些额外的后处理判定,来过滤掉一些特殊情况。这里的特殊情况主要包括如下三种:

-

筛选低垂的可行走障碍 对应的函数为

rcFilterLowHangingWalkableObstacles -

过滤跳台区间 对应的函数为

rcFilterLedgeSpans -

过滤可行走的低高度区间 对应的函数为

rcFilterWalkableLowHeightSpans

//

// Step 3. Filter walkables surfaces.

//

// Once all geoemtry is rasterized, we do initial pass of filtering to

// remove unwanted overhangs caused by the conservative rasterization

// as well as filter spans where the character cannot possibly stand.

if (m_filterLowHangingObstacles)

rcFilterLowHangingWalkableObstacles(m_ctx, m_cfg.walkableClimb, *m_solid);

if (m_filterLedgeSpans)

rcFilterLedgeSpans(m_ctx, m_cfg.walkableHeight, m_cfg.walkableClimb, *m_solid);

if (m_filterWalkableLowHeightSpans)

rcFilterWalkableLowHeightSpans(m_ctx, m_cfg.walkableHeight, *m_solid);

这三种过滤方式都可以通过配置参数来开启,下面我们来分别介绍这三个过滤规则的细节与目的。

筛选低垂的可行走障碍

这个筛选的目的是将一些小的障碍物标记为可行走:如果某个不可行走的rcSpan同一列中有一个高度差不超过爬坡高度的可行走rcSpan,则此rcSpan标记为可以行走.

算法比较简单:迭代每一列,从下往上遍历rcSpan,对于同列任意两个相邻的span1(下)和span2(上),当span1可走,并且span2不可走的时候,计算这两个span的上表面高度差Diff,如果Diff小于配置参数walkableClimb,则将span2设置为可行走:

void rcFilterLowHangingWalkableObstacles(rcContext* ctx, const int walkableClimb, rcHeightfield& solid)

{

rcAssert(ctx);

rcScopedTimer timer(ctx, RC_TIMER_FILTER_LOW_OBSTACLES);

const int w = solid.width;

const int h = solid.height;

for (int y = 0; y < h; ++y)

{

for (int x = 0; x < w; ++x)

{

rcSpan* ps = 0;

bool previousWalkable = false;

unsigned char previousArea = RC_NULL_AREA;

for (rcSpan* s = solid.spans[x + y*w]; s; ps = s, s = s->next)

{

const bool walkable = s->area != RC_NULL_AREA;

// If current span is not walkable, but there is walkable

// span just below it, mark the span above it walkable too.

if (!walkable && previousWalkable)

{

if (rcAbs((int)s->smax - (int)ps->smax) <= walkableClimb)

s->area = previousArea;

}

// Copy walkable flag so that it cannot propagate

// past multiple non-walkable objects.

previousWalkable = walkable;

previousArea = s->area;

}

}

}

}

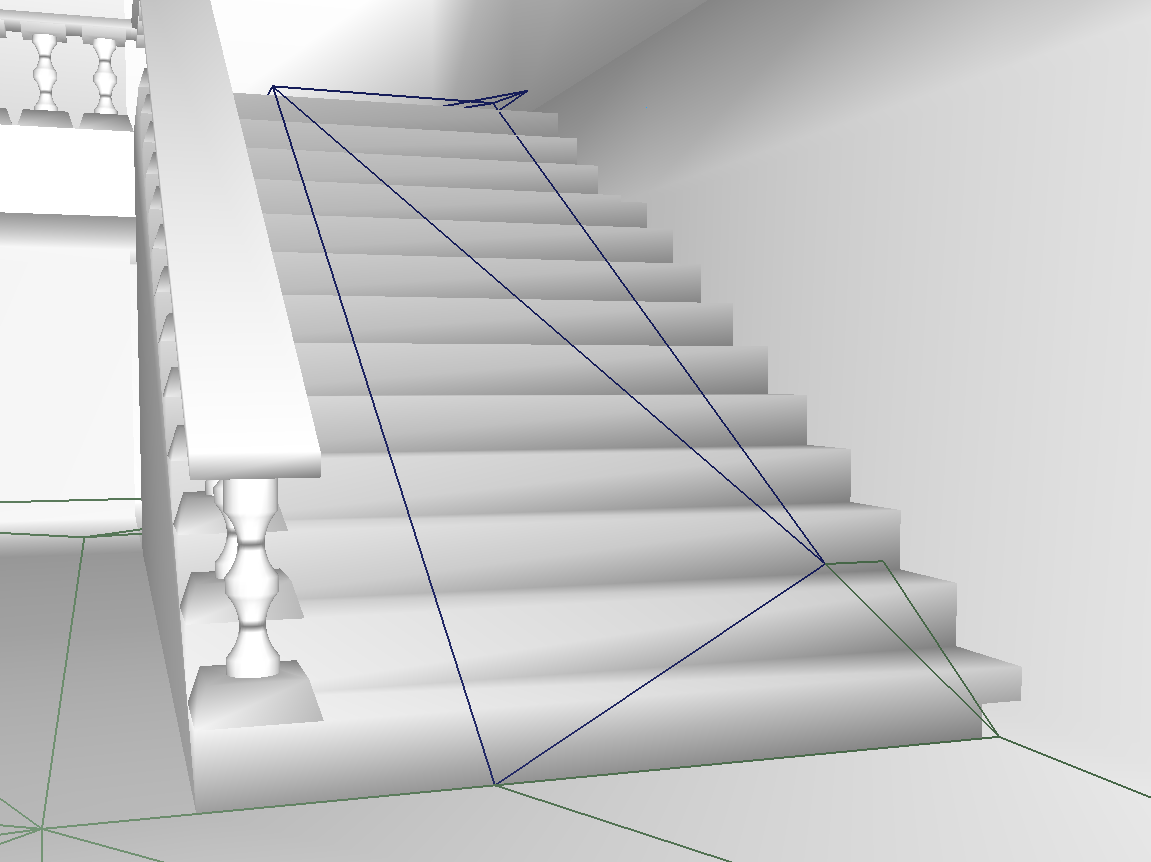

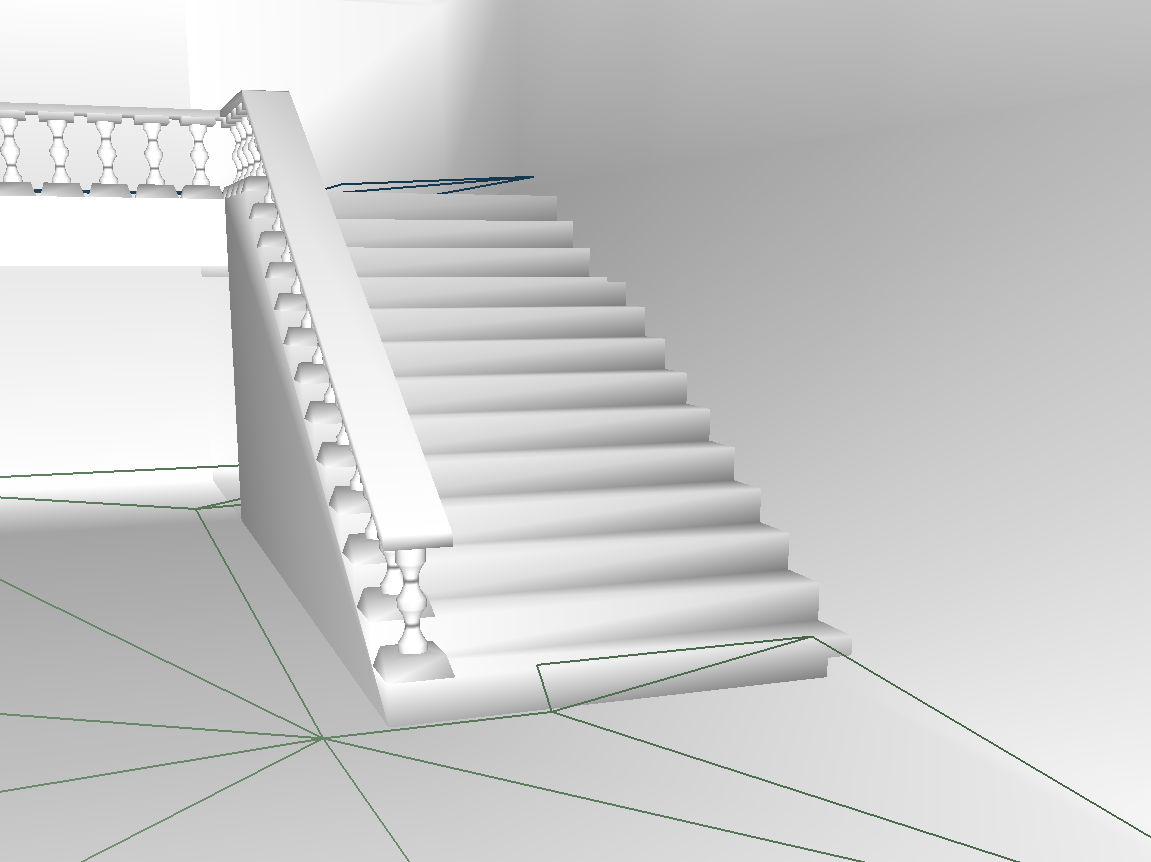

这部分主要是将一些楼梯台阶形式的行走表面连通起来:

如果这个参数设置的太小,则导致楼梯无法连通:

如果这个参数设置的太高,会导致桌子甚至房顶都可以直接从地面寻路过去:

过滤可行走的低高度区间

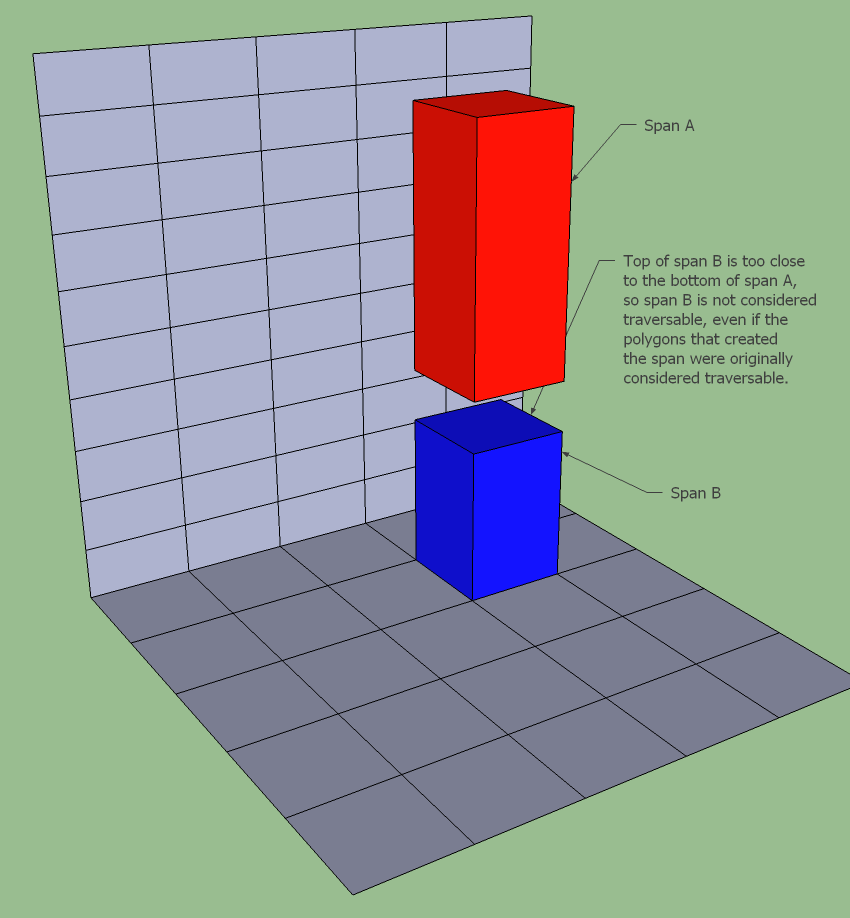

在使用Detour进行寻路时,参与寻路的Agent会有一个身高参数walkableHeight。如果在可行走的span(A)上方的障碍物底面与当前span(A)的顶面高度差小于这个指定的walkableHeight,那么span(A)的顶面则是不可行走的。

对应的实现也很简单:

void rcFilterWalkableLowHeightSpans(rcContext* ctx, int walkableHeight, rcHeightfield& solid)

{

rcAssert(ctx);

rcScopedTimer timer(ctx, RC_TIMER_FILTER_WALKABLE);

const int w = solid.width;

const int h = solid.height;

const int MAX_HEIGHT = 0xffff;

// Remove walkable flag from spans which do not have enough

// space above them for the agent to stand there.

for (int y = 0; y < h; ++y)

{

for (int x = 0; x < w; ++x)

{

for (rcSpan* s = solid.spans[x + y*w]; s; s = s->next)

{

const int bot = (int)(s->smax);

const int top = s->next ? (int)(s->next->smin) : MAX_HEIGHT;

if ((top - bot) <= walkableHeight)

s->area = RC_NULL_AREA;

}

}

}

}

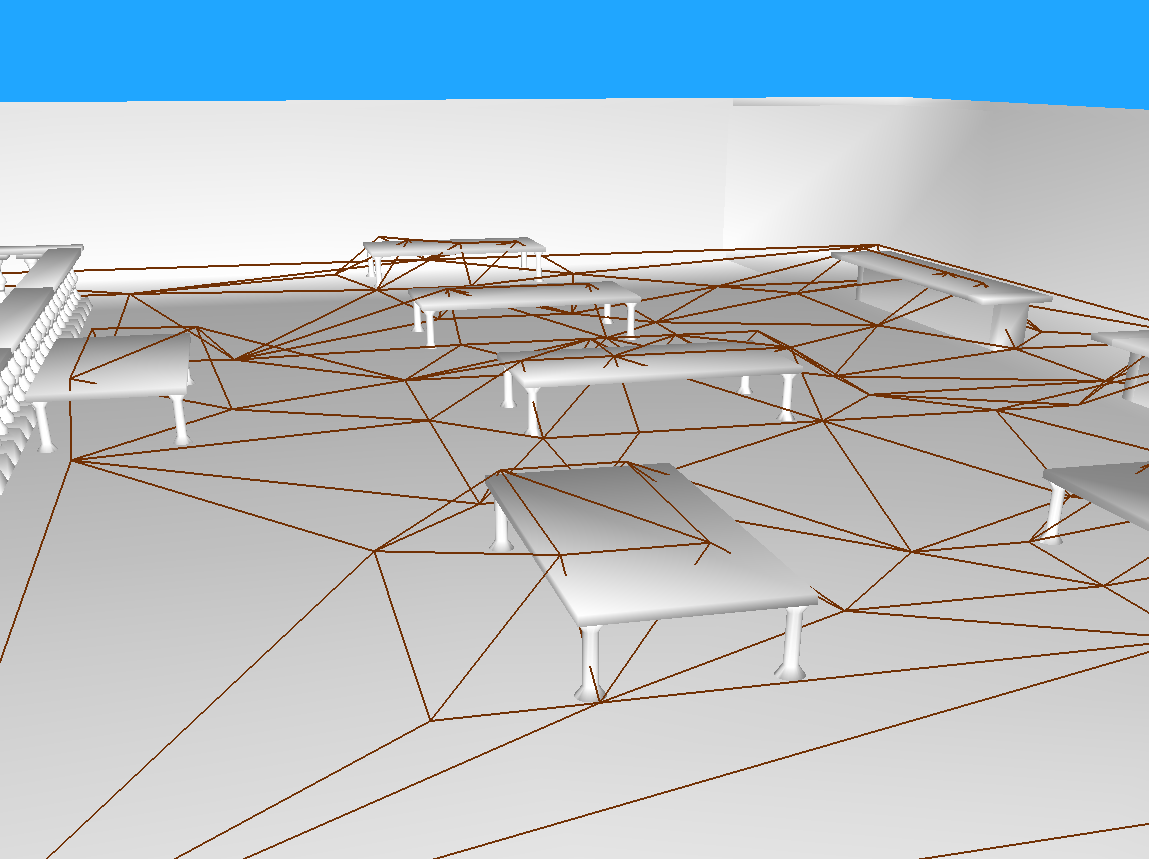

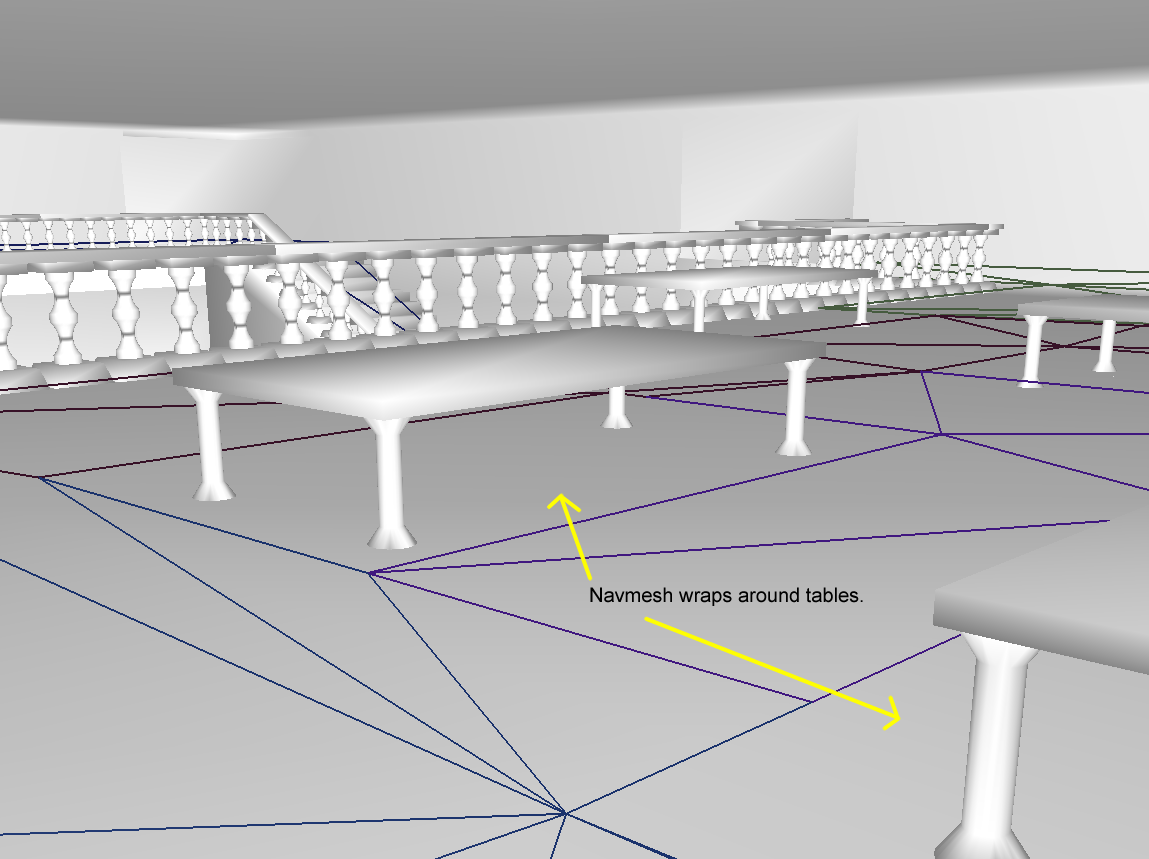

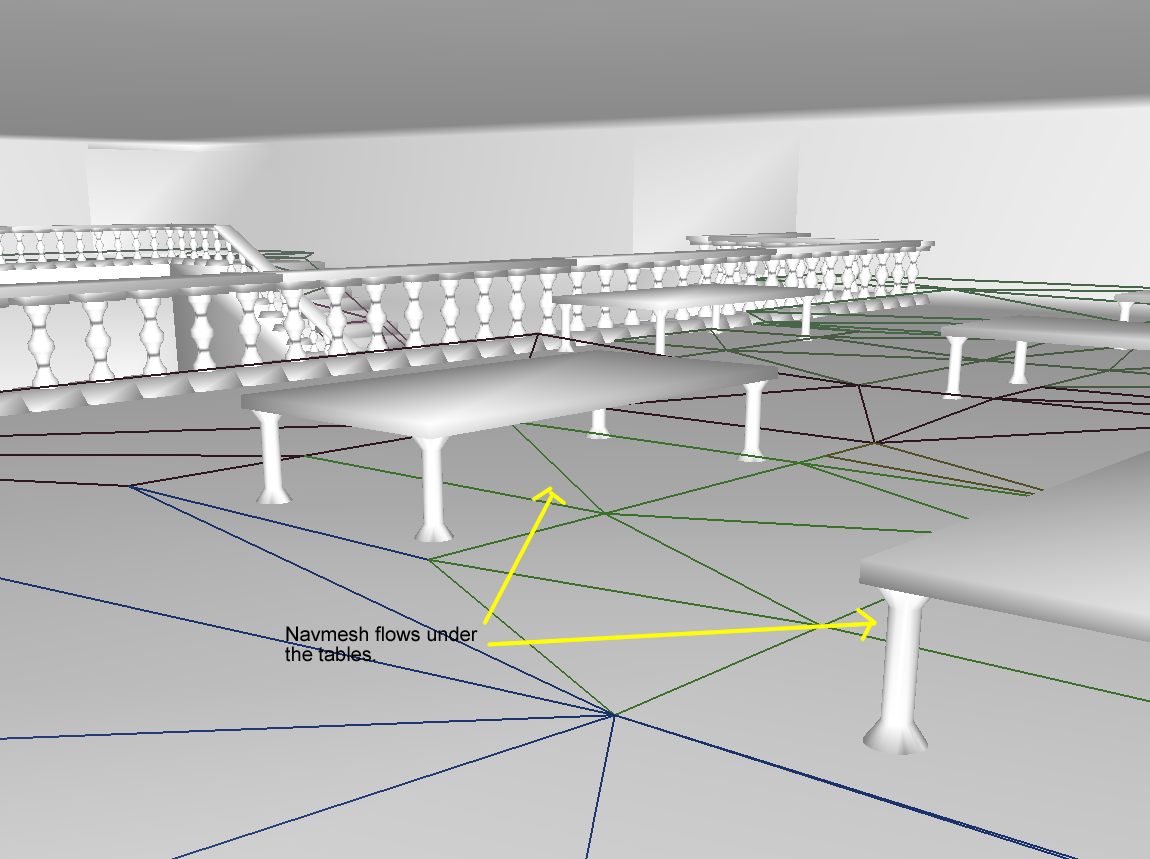

这个参数也需要设置为合适的值去匹配参与寻路的entity的高度,下图就是选取了合适的参数之后,桌子下面的区域不再可通行:

如果这个参数设置的过小,则桌子下面的区域会变得可通行,如果真实高度大于桌子高度但是又是可通行的,则会引起模型与场景的穿插:

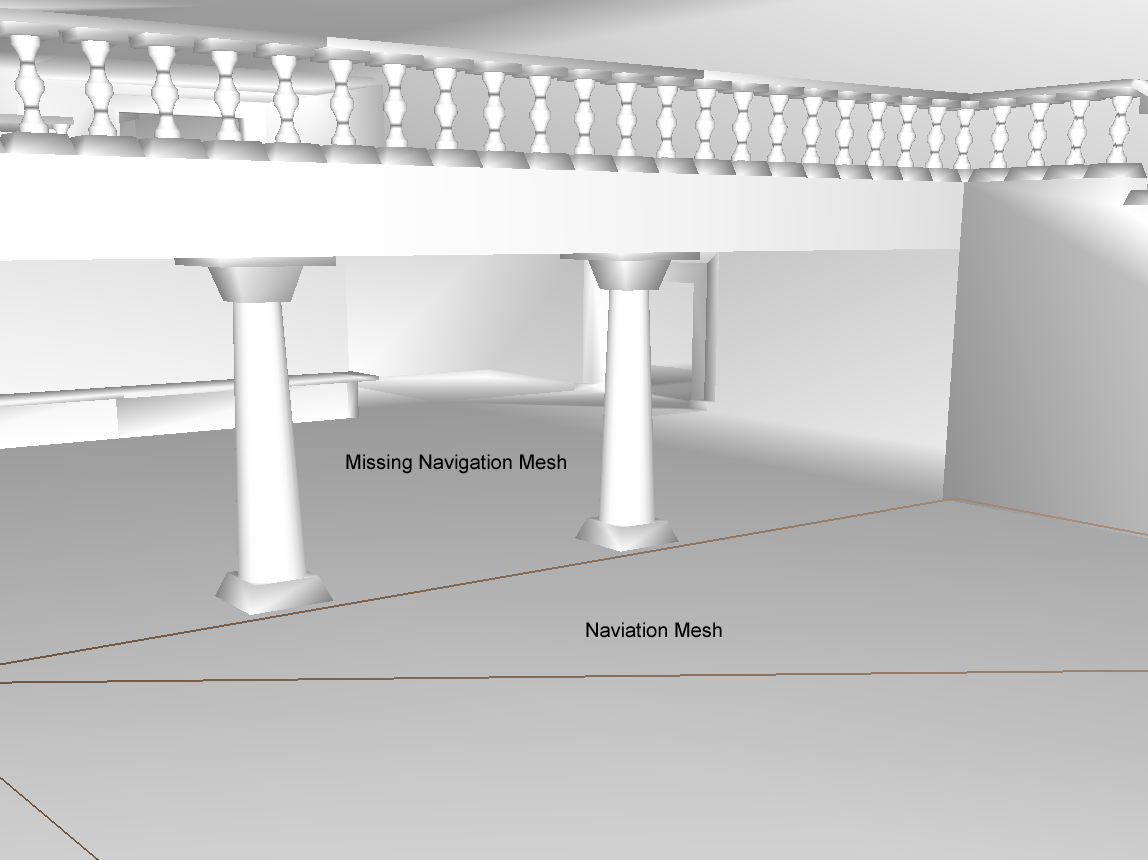

当然太大也不行,会导致下图中天花板下方的区域都不可通行:

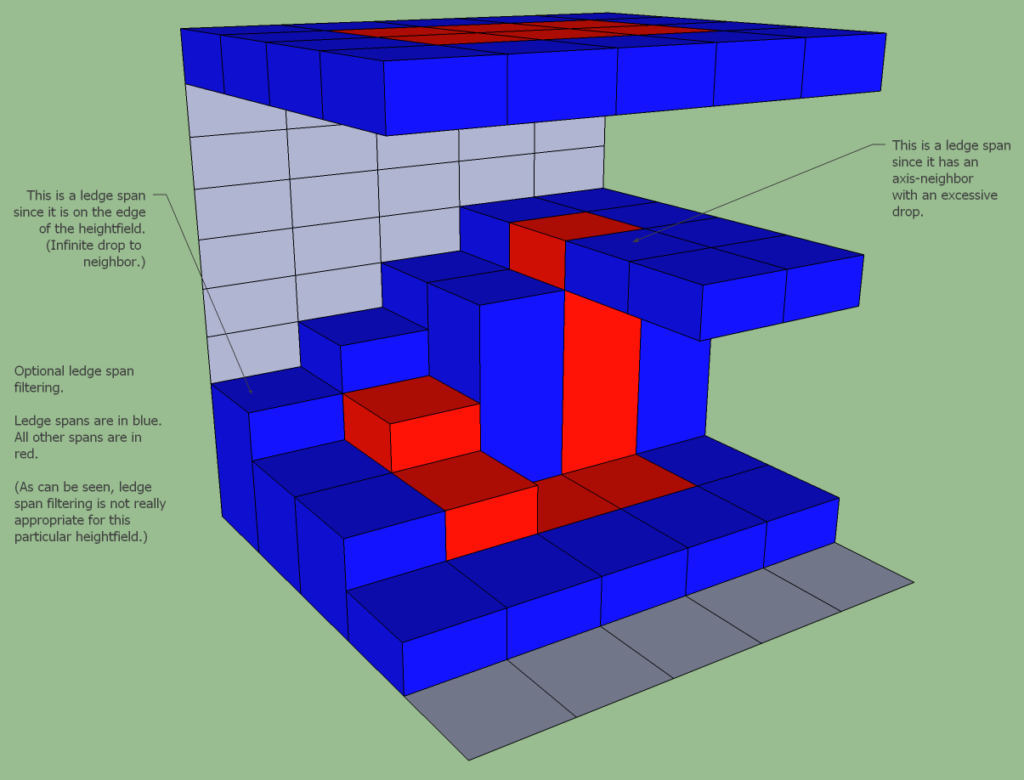

过滤跳台区间

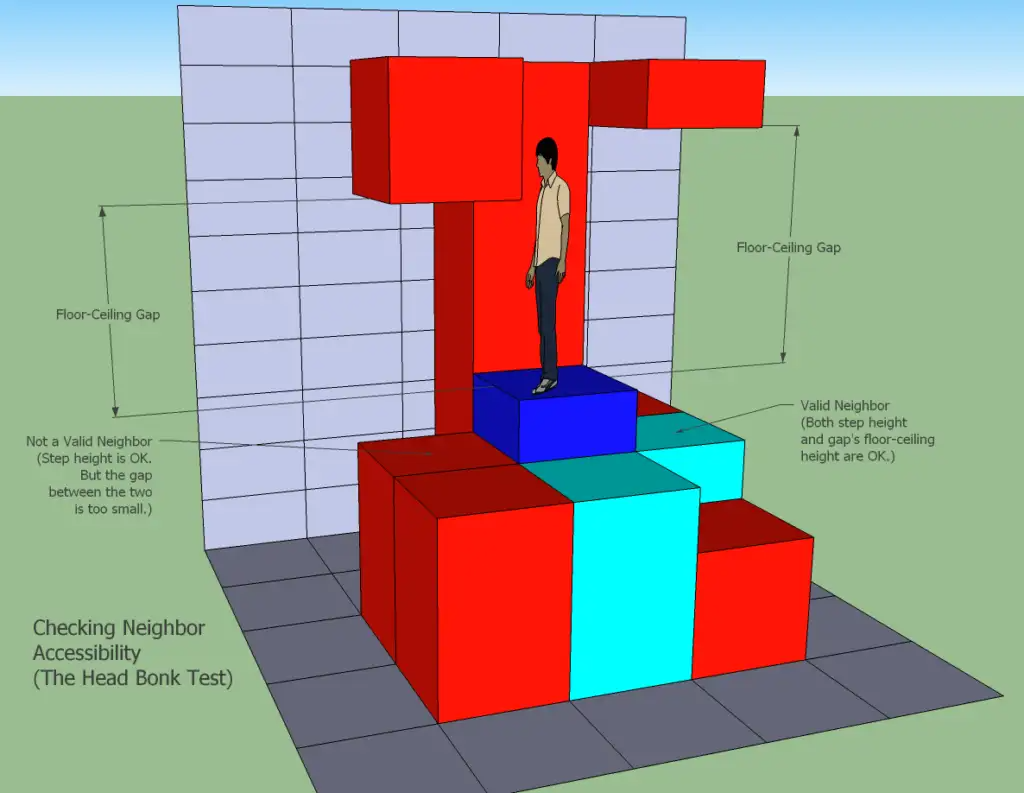

这个步骤负责将处理跨列移动时的规则过滤,避免出现高度下降过快的情况。这里的跨列移动就是从一个可行走span(A)移动到可行走的归属于其他列的span(B),这样的移动需要满足如下条件:

-

span(B)所在的列是span(A)所在列的四个轴向邻居之一 -

Span(B)的顶面高度减去span(A)的顶面高度要小于攀爬高度walkableClimb -

span(A)移动到Span(B)时不会触发walkableHeight高度限制引发的阻挡,此时我们需要获得span(A)上面邻居span(A2)以及span(B)的上面邻居span(B2),计算A2, B2的底面最小值减去A, B的顶面最大值就是从A移动到B的最大允许高度,要求这个值要大于walkableHeight

满足上述条件的span(B)被定义为Span(A)的一个跨列邻居。下图中的浅蓝色span就是当前蓝色span的跨列邻居:

有了跨列邻居之后我们再来定义跳台区间:对于一个span(A)而言,遍历其周围四个轴邻居,对于每个轴邻居获取其中上表面低于当前span(A)上表面高度的跨列邻居span(B)中高度最高者,计算这几个span(B)与span(A)上表面高度差的最小值,如果这个最小值大于指定参数walkableClimb,则当前span(A)为跳台区间。如果span(A)对应的列在场景边界上或者在某个方向的邻居列中没有跨列邻居,则也定义为跳台区间。我们需要将所有为跳台区间的rcSpan标记为不可行走:

在上图中蓝色的span就是所谓的跳台区间,红色的span则是正常区间。这个过滤函数需要处理每一个可行走的rcspan的四个方向邻居列的每个有效跨列移动,因此会出现五重循环:

/// @see rcHeightfield, rcConfig

void rcFilterLedgeSpans(rcContext* ctx, const int walkableHeight, const int walkableClimb,

rcHeightfield& solid)

{

rcAssert(ctx);

rcScopedTimer timer(ctx, RC_TIMER_FILTER_BORDER);

const int w = solid.width;

const int h = solid.height;

const int MAX_HEIGHT = 0xffff;

// Mark border spans.

for (int y = 0; y < h; ++y)

{

for (int x = 0; x < w; ++x)

{

for (rcSpan* s = solid.spans[x + y*w]; s; s = s->next)

{

// Skip non walkable spans.

if (s->area == RC_NULL_AREA)

continue;

// 遍历每个原来可以行走的span

const int bot = (int)(s->smax);

const int top = s->next ? (int)(s->next->smin) : MAX_HEIGHT;

// 跨列邻居的最小高度

int minh = MAX_HEIGHT;

// Min and max height of accessible neighbours.

int asmin = s->smax;

int asmax = s->smax;

// 四方向邻居遍历

for (int dir = 0; dir < 4; ++dir)

{

int dx = x + rcGetDirOffsetX(dir);

int dy = y + rcGetDirOffsetY(dir);

// 超过边界时 不处理

if (dx < 0 || dy < 0 || dx >= w || dy >= h)

{

minh = rcMin(minh, -walkableClimb - bot);

continue;

}

// From minus infinity to the first span.

rcSpan* ns = solid.spans[dx + dy*w];

int nbot = -walkableClimb;

int ntop = ns ? (int)ns->smin : MAX_HEIGHT;

// 这里使用agent的高度过滤掉不可连通的邻居

if (rcMin(top,ntop) - rcMax(bot,nbot) > walkableHeight)

minh = rcMin(minh, nbot - bot);

// Rest of the spans.

for (ns = solid.spans[dx + dy*w]; ns; ns = ns->next)

{

nbot = (int)ns->smax;

ntop = ns->next ? (int)ns->next->smin : MAX_HEIGHT;

// 这里使用agent的高度过滤掉不可连通的邻居

if (rcMin(top,ntop) - rcMax(bot,nbot) > walkableHeight)

{

// 更新跨列邻居减去当前span顶面高度的最小值

minh = rcMin(minh, nbot - bot);

// 如果当前差值在爬升范围内 更新当前span可以上升的最大高度和最小高度

if (rcAbs(nbot - bot) <= walkableClimb)

{

if (nbot < asmin) asmin = nbot;

if (nbot > asmax) asmax = nbot;

}

}

}

}

// 如果存在一个跨列邻居使得从当前span下降到这个跨列邻居所需高度大于爬升高度 则设置为不可行走

if (minh < -walkableClimb)

{

s->area = RC_NULL_AREA;

}

// 如果当前span所能达到的最高高度与最低高度的差值大于爬升高度,则也标记为不可行走

else if ((asmax - asmin) > walkableClimb)

{

s->area = RC_NULL_AREA;

}

}

}

}

}

值得注意的是上面的过滤除了处理了当前span的下降高度之外,还处理了当前span的有效到达高度的最大值与最小值,如果这个区间长度大于爬升高度,则认为当前span会引发一个间接的快速下降过程,因此这种情况下也把当前span设置为了跳台span,标记为不可通行。

区域分割

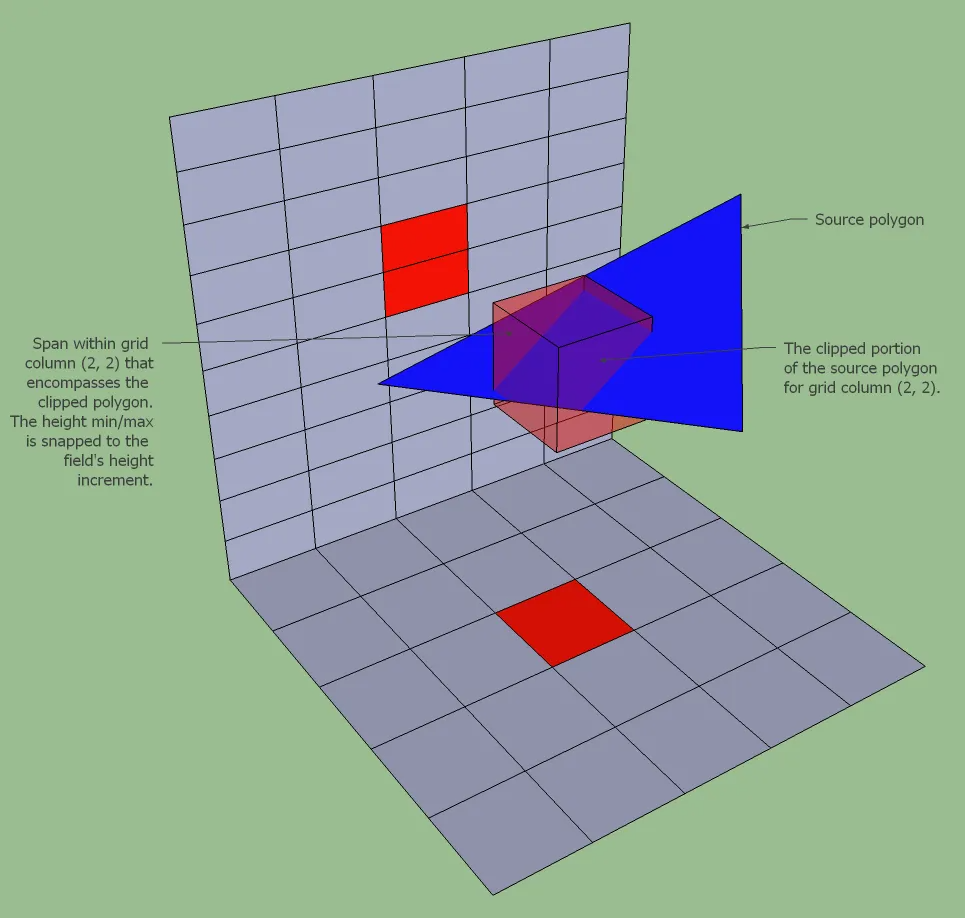

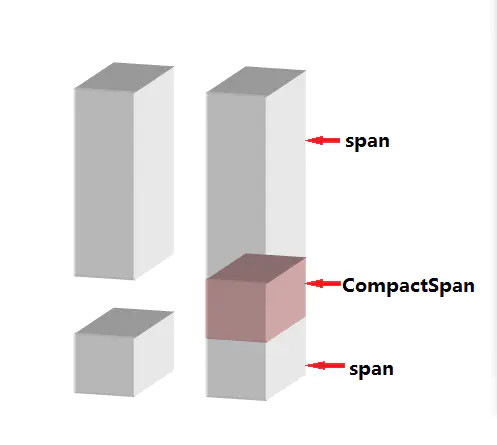

这一阶段的目标是生成以体素表示的输入Mesh的可通过表面,并将可通过的区域分割成可以最终形成简单多边形的相邻的span(表面)区域。此时为了计算连通性,我们需要使用空心的rcCompactSpan来替代原来的rcSpan,

对应的高度场数据也从实心高度场数据rcHeightField转换到了空心压缩高度场数据rcCompactHeightField。

/// Provides information on the content of a cell column in a compact heightfield.

struct rcCompactCell

{

unsigned int index : 24; ///< Index to the first span in the column.

unsigned int count : 8; ///< Number of spans in the column.

};

/// Represents a span of unobstructed space within a compact heightfield.

struct rcCompactSpan

{

unsigned short y; ///< The lower extent of the span. (Measured from the heightfield's base.)

unsigned short reg; ///< The id of the region the span belongs to. (Or zero if not in a region.)

unsigned int con : 24; ///< Packed neighbor connection data.

unsigned int h : 8; ///< The height of the span. (Measured from #y.)

};

/// A compact, static heightfield representing unobstructed space.

/// @ingroup recast

struct rcCompactHeightfield

{

rcCompactHeightfield();

~rcCompactHeightfield();

int width; ///< The width of the heightfield. (Along the x-axis in cell units.)

int height; ///< The height of the heightfield. (Along the z-axis in cell units.)

int spanCount; ///< The number of spans in the heightfield.

int walkableHeight; ///< The walkable height used during the build of the field. (See: rcConfig::walkableHeight)

int walkableClimb; ///< The walkable climb used during the build of the field. (See: rcConfig::walkableClimb)

int borderSize; ///< The AABB border size used during the build of the field. (See: rcConfig::borderSize)

unsigned short maxDistance; ///< The maximum distance value of any span within the field.

unsigned short maxRegions; ///< The maximum region id of any span within the field.

float bmin[3]; ///< The minimum bounds in world space. [(x, y, z)]

float bmax[3]; ///< The maximum bounds in world space. [(x, y, z)]

float cs; ///< The size of each cell. (On the xz-plane.)

float ch; ///< The height of each cell. (The minimum increment along the y-axis.)

rcCompactCell* cells; ///< Array of cells. [Size: #width*#height]

rcCompactSpan* spans; ///< Array of spans. [Size: #spanCount]

unsigned short* dist; ///< Array containing border distance data. [Size: #spanCount]

unsigned char* areas; ///< Array containing area id data. [Size: #spanCount]

};

在上面的结构体定义中,高度场二维平面里的每个cell都有一个rcCompactCell,总体以行优先的形式存储在cells中。然后每个cell内的rcCompactSpan是连续存储的,其存储区域在spans中,所以此时不再使用链表来关联了。rcCompactCell中的index代表其内部的第一个span的在spans里的开始索引,count字段代表当前cell有多少个span。每个rcCompactSpan里用y存储下表面高度,用h存储span的长度,con字段存储了当前span与周围四个邻居cell中相连接的第一个span的数据。

将原有的实心高度场数据rcHeightField转换到空心压缩高度场数据rcCompactHeightField的函数为rcBuildCompactHeightfield,其逻辑很简单。首先预先分配spans对应的内存大小,这部分可以通过rcGetHeightFieldSpanCount计算而来,然后遍历每个rcCompactCell,获取原来实心高度场里对应的rcSpan链表,链表里每个顶面可以行走的rcSpan都会生成一个rcCompactSpan:

const int MAX_HEIGHT = 0xffff;

// Fill in cells and spans.

int idx = 0;

for (int y = 0; y < h; ++y)

{

for (int x = 0; x < w; ++x)

{

const rcSpan* s = hf.spans[x + y*w];

// If there are no spans at this cell, just leave the data to index=0, count=0.

if (!s) continue;

rcCompactCell& c = chf.cells[x+y*w];

c.index = idx;

c.count = 0;

while (s)

{

if (s->area != RC_NULL_AREA)

{

const int bot = (int)s->smax;

const int top = s->next ? (int)s->next->smin : MAX_HEIGHT;

chf.spans[idx].y = (unsigned short)rcClamp(bot, 0, 0xffff);

chf.spans[idx].h = (unsigned char)rcClamp(top - bot, 0, 0xff);

chf.areas[idx] = s->area;

idx++;

c.count++;

}

s = s->next;

}

}

}

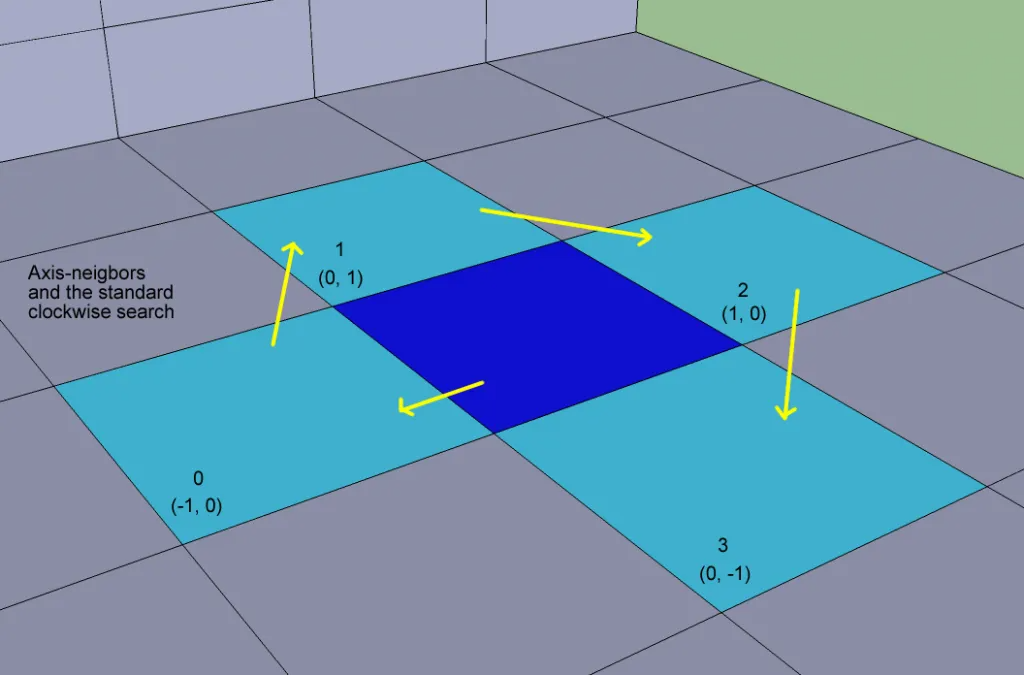

初始化了所有rcCompactSpan的区间和area数据之后,为了后续连通性计算方便,还需要计算周围邻居数据。这里的周围邻居只包括当前rcCompactCell的四个轴向移动的其他rcCompactCell,这里使用了[0,4)作为方向标识,这四个方向邻居以顺时针形式排列:

在后续的代码中,经常使用循环来遍历当前cell的邻居cell,为了避免分支判断,提供了下面的几个辅助函数来计算XZ方向上的偏移:

/// Gets the standard width (x-axis) offset for the specified direction.

/// @param[in] dir The direction. [Limits: 0 <= value < 4]

/// @return The width offset to apply to the current cell position to move

/// in the direction.

inline int rcGetDirOffsetX(int dir)

{

static const int offset[4] = { -1, 0, 1, 0, };

return offset[dir&0x03];

}

/// Gets the standard height (z-axis) offset for the specified direction.

/// @param[in] dir The direction. [Limits: 0 <= value < 4]

/// @return The height offset to apply to the current cell position to move

/// in the direction.

inline int rcGetDirOffsetY(int dir)

{

static const int offset[4] = { 0, 1, 0, -1 };

return offset[dir&0x03];

}

/// Gets the direction for the specified offset. One of x and y should be 0.

/// @param[in] x The x offset. [Limits: -1 <= value <= 1]

/// @param[in] y The y offset. [Limits: -1 <= value <= 1]

/// @return The direction that represents the offset.

inline int rcGetDirForOffset(int x, int y)

{

static const int dirs[5] = { 3, 0, -1, 2, 1 };

return dirs[((y+1)<<1)+x];

}

有了上述的邻居定义和辅助函数之后,计算当前rcCompactSpan的代码就简短了很多:

// Find neighbour connections.

const int MAX_LAYERS = RC_NOT_CONNECTED-1; //62

int tooHighNeighbour = 0;

for (int y = 0; y < h; ++y)

{

for (int x = 0; x < w; ++x)

{

const rcCompactCell& c = chf.cells[x+y*w];

for (int i = (int)c.index, ni = (int)(c.index+c.count); i < ni; ++i)

{

// 遍历当前cell里的所有span

rcCompactSpan& s = chf.spans[i];

for (int dir = 0; dir < 4; ++dir)

{

rcSetCon(s, dir, RC_NOT_CONNECTED);

const int nx = x + rcGetDirOffsetX(dir);

const int ny = y + rcGetDirOffsetY(dir);

// First check that the neighbour cell is in bounds.

if (nx < 0 || ny < 0 || nx >= w || ny >= h)

continue;

// 获取当前dir方向上的邻居cell

const rcCompactCell& nc = chf.cells[nx+ny*w];

for (int k = (int)nc.index, nk = (int)(nc.index+nc.count); k < nk; ++k)

{

const rcCompactSpan& ns = chf.spans[k];

const int bot = rcMax(s.y, ns.y);

const int top = rcMin(s.y+s.h, ns.y+ns.h);

// 遍历邻居cell里的所有空心span 获取一个跨列移动的邻居

// 两个span的高度差不能超过walkableClimb 且允许walkableHeight高度的单位进行通过

if ((top - bot) >= walkableHeight && rcAbs((int)ns.y - (int)s.y) <= walkableClimb)

{

const int lidx = k - (int)nc.index;

if (lidx < 0 || lidx > MAX_LAYERS)

{

tooHighNeighbour = rcMax(tooHighNeighbour, lidx);

continue;

}

// 记录当前方向上的跨列邻居 每一列都只记录一个

rcSetCon(s, dir, lidx);

break;

}

}

}

}

}

}

这里的rcSetCon实现的非常巧妙,尽可能的减少了数据的大小,每个方向的跨列邻居索引压缩为只使用6bit来存储,这样四个方向只需要24bit的空间即可,每次对特定方向的跨列邻居索引做get set的时候都通过位操作来进行:

/// Sets the neighbor connection data for the specified direction.

/// @param[in] s The span to update.

/// @param[in] dir The direction to set. [Limits: 0 <= value < 4]

/// @param[in] i The index of the neighbor span.

inline void rcSetCon(rcCompactSpan& s, int dir, int i)

{

const unsigned int shift = (unsigned int)dir*6;

unsigned int con = s.con;

s.con = (con & ~(0x3f << shift)) | (((unsigned int)i & 0x3f) << shift);

}

/// Gets neighbor connection data for the specified direction.

/// @param[in] s The span to check.

/// @param[in] dir The direction to check. [Limits: 0 <= value < 4]

/// @return The neighbor connection data for the specified direction,

/// or #RC_NOT_CONNECTED if there is no connection.

inline int rcGetCon(const rcCompactSpan& s, int dir)

{

const unsigned int shift = (unsigned int)dir*6;

return (s.con >> shift) & 0x3f;

}

为了省这部分内存带来的限制就是单rcCompactCell内只能有最多63个rcCompactSpan,因为63这个索引被定义为了不可通行。

搞定了压缩高度场的建立之后,下一步需要根据参数walkableRadius来把可通行区域的边缘过滤掉,这个参数的值一般设置为参与寻路的角色胶囊体半径。这个过滤的目的是为了避免寻路角色在区域边缘时出现异常,例如在悬崖边缘浮空或者与围墙穿插,所以要设置这个胶囊体半径的边缘为不可行走。

为了实现这个边缘特定范围过滤,我们需要给每个span赋予一个uint8 dis的值,代表这个span离边缘的距离。以下面的规则来初始化所有的span的dis:

-

如果这个

span不可行走,则设置为0 -

如果这个

span四个方向里存在至少一个列没有跨列邻居,则设置为0,此时需要检查rccompactSpan->con里四个方向的分量是否有等于63的 -

除此之外的

span的dis设置为255,即uint8的上限

然后执行洪泛(FloodFill)法来更新所有span的dis(A),这个更新规则如下:

-

遍历当前

span的四个轴向邻居,获取其中最小的dis(B),然后dis(A) = min(dis(A) , dis(B) + 2),这里使用2作为距离而不是1是因为使用的是最大可能距离而不是中心距离 -

遍历当前

span的四个对角线邻居,获取其中最小的dis(C),然后dis(A) = min(dis(A) , dis(C) + 3),这里使用3作为距离而不是2是因为使用的是最大可能距离而不是中心距离

这个简单的更新规则有个前置条件,即这个span九宫格周围八个span的距离已经更新好了,真要这么做就需要做一个排序。所以recast里使用了一个非常巧妙的方法,执行两次遍历:

- 第一次遍历从左下角

(0, 0)遍历到右上角(w,h),此时只计算当前span的cell偏移量为(-1, 0), (-1, -1),(0, -1), (1, -1)这四个邻居cell里的跨列邻居span,这四个span对应的cell要么在当前cell的正左边,要么在当前cell的下边,肯定在当前cell之前被当前遍历处理过了

for (int y = 0; y < h; ++y)

{

for (int x = 0; x < w; ++x)

{

// 遍历当前cell里的每个span 的(-1, 0), (-1, -1),(0, -1), (1, -1) 跨列邻居

}

}

这次遍历处理完成之后,span对应的dis值存储的就是当前span到正左边或者下边所有不可通行span距离的最小值

- 第二次遍历从右上角

(w,h)遍历到坐下角(0, 0),此时只计算当前span的cell偏移量为(1, 0), (-1, 1),(0, 1), (1, 1)这四个邻居cell里的跨列邻居span,这四个span对应的cell要么在当前cell的正右边,要么在当前cell的上边,肯定在当前cell之前被当前遍历处理过了

for (int y = h-1; y >= 0; --y)

{

for (int x = w-1; x >= 0; --x)

{

// 遍历当前cell里的每个span 的(1, 0), (-1, 1),(0, 1), (1, 1) 跨列邻居

}

}

这次遍历处理完成之后,span对应的dis值存储的就是当前span到所有有不可通行span距离的最小值

我们在span中只存储了四个轴的跨列邻居,那么是如何计算当前span的对角线邻居呢?其实调用两次获取轴向邻居就可以获得对角线邻居。这里以获取span(A)的(-1, -1)偏移量对角线邻居为例,先获取(-1, 0)方向的跨列邻居span(B),然后再获取span(B)在(0, -1)方向的跨列邻居span(C),这就是所需要的对角线邻居:

const rcCompactSpan& s = chf.spans[i];

if (rcGetCon(s, 0) != RC_NOT_CONNECTED)

{

// (-1,0)

const int ax = x + rcGetDirOffsetX(0);

const int ay = y + rcGetDirOffsetY(0);

const int ai = (int)chf.cells[ax+ay*w].index + rcGetCon(s, 0);

const rcCompactSpan& as = chf.spans[ai];

nd = (unsigned char)rcMin((int)dist[ai]+2, 255);

if (nd < dist[i])

dist[i] = nd;

// (-1,-1)

if (rcGetCon(as, 3) != RC_NOT_CONNECTED)

{

const int aax = ax + rcGetDirOffsetX(3);

const int aay = ay + rcGetDirOffsetY(3);

const int aai = (int)chf.cells[aax+aay*w].index + rcGetCon(as, 3);

nd = (unsigned char)rcMin((int)dist[aai]+3, 255);

if (nd < dist[i])

dist[i] = nd;

}

}

两轮过后,每个span参考了周围8个span的dis进行了dis更新,从而得到了正确的dis值。然后将所有dis小于两倍障碍半径的span设置为不可通行:

const unsigned char thr = (unsigned char)(radius*2);

for (int i = 0; i < chf.spanCount; ++i)

if (dist[i] < thr)

chf.areas[i] = RC_NULL_AREA;

做完了边界区域特定半径内禁止通行之后,recast还会调用rcMarkConvexPolyArea对场景中设置的area凸包围盒进行处理,这种包围盒的目的是将其内部的所有span下表面修改span::area字段,以方便后续的业务逻辑做处理。典型的应用场景为标记水体、沼泽地、公路等与平地不一样的区域。函数的执行体很简单,获取这个凸包围盒在XZ平面上的AABB包围盒之后,遍历在这个AABB内的所有cell,将底面中心点在此poly内的span设置对应的area。

for (int z = minz; z <= maxz; ++z)

{

for (int x = minx; x <= maxx; ++x)

{

const rcCompactCell& c = chf.cells[x+z*chf.width];

for (int i = (int)c.index, ni = (int)(c.index+c.count); i < ni; ++i)

{

rcCompactSpan& s = chf.spans[i];

if (chf.areas[i] == RC_NULL_AREA)

continue;

if ((int)s.y >= miny && (int)s.y <= maxy)

{

float p[3];

p[0] = chf.bmin[0] + (x+0.5f)*chf.cs;

p[1] = 0;

p[2] = chf.bmin[2] + (z+0.5f)*chf.cs;

if (pointInPoly(nverts, verts, p))

{

chf.areas[i] = areaId;

}

}

}

}

}

这一步做完之后最终到了使用压缩高度场数据生成区域的逻辑,不过这里的区域生成算法有三种,根据配置调用不同的函数来执行区域生成:

enum SamplePartitionType

{

SAMPLE_PARTITION_WATERSHED,

SAMPLE_PARTITION_MONOTONE,

SAMPLE_PARTITION_LAYERS,

};

-

SAMPLE_PARTITION_WATERSHED代表的是分水岭算法,其函数入口为rcBuildRegions -

SAMPLE_PARTITION_MONOTONE代表的是单调分区算法,其函数入口为rcBuildRegionsMonotone -

SAMPLE_PARTITION_LAYERS代表的是按层分区算法,其函数入口为rcBuildLayerRegions

使用分水岭算法进行区域分割

分水岭算法介绍

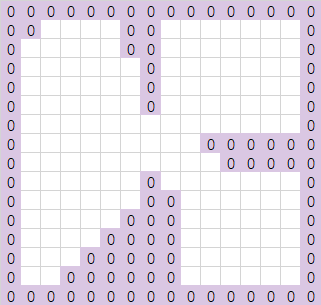

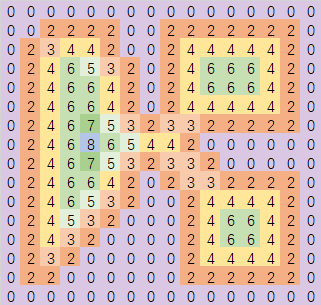

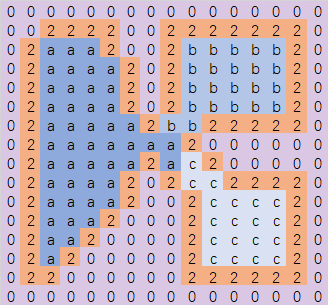

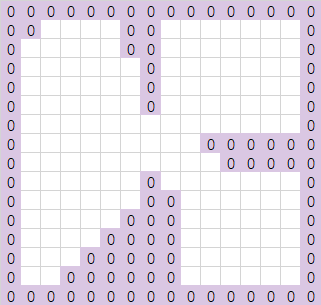

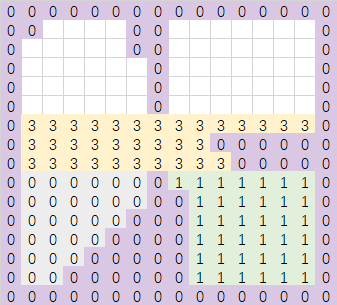

分水岭算法是在图像处理中经常使用的图片分区算法,这个算法要求将图形数据转换为二维平面的灰度数据,灰度值代表此像素的深度,也就是高度的负值。算法流程就是不断地对二维平面进行水平面增长,形成多个独立不相连的水域,深度高的地方将优先得到水域覆盖。随着水平面增长,有些原本不相连的水域开始连通,这些水域之间的连通边界就是所谓的分水岭。而在水平面提升过程中形成的水域被这些分水岭边界切分后就是我们所需要的场景区域划分。这里用文字来描述有点乏力,我们用图形来展示。假设初始时平面场景配置如下,网格中深度值为0的代表不可通行:

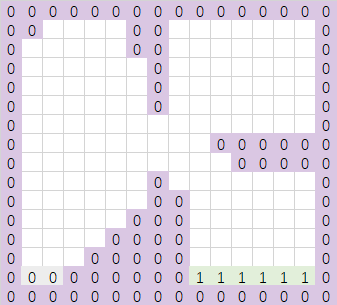

有了这个阻挡信息之后,我们计算网格中每个点到不可通行的网格的最短距离,这里有一个专门的名词叫做距离场(Distance Field)。这个过程类似于前面我们为了做边缘过滤时的处理,这里我们套用recast里的规定,轴向移动的距离为2,对角线移动的距离为3,从而得到了下面的距离场数据:

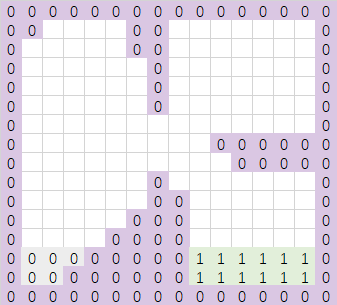

这里的距离场数据就是分水岭算法所期望的深度数据。有了深度数据之后,我们开始来抬升水平面,初始水平面为最大深度值。同时我们获取水平面初始化之后生成的各个独立水域,这里我们给每个水域都赋予一个字母代表的唯一标识符。上图中最大深度为8,对应的点只有一个点,我们为之分配一个区域a。当然实际情况中最大深度对应的点不止有一个,而且点之间可能连通。相同深度且可直接连接的点需要合并区域,不能分配不同的区域标识符。

有了初始水域集合之后,我们记录当前最低水位为h,同时开始抬升水位。但是由于recast设定相邻单元格之间的距离为2,所以每抬升一次,要处理的深度范围在[h-1,h]内的网格:

-

如果网格与当前某个水域相连通,则将这个网格加入此水域

-

如果网格没有与任意水域相连通,则创建一个新的水域,赋予一个新的唯一标识符

下图就是第一次抬升水平面的结果,对应的水域区间为[7, 8],此时a区域增加了两个深度为7的邻接点:

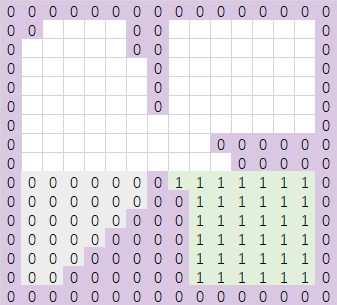

再一次抬升水位,此时水位区间为[5,6],会引发两个新水域的创建,同时a区域进行扩大:

继续抬升水位,此时水位区间为[3,4],三个区域继续扩大,此时会第一次遇到作为分水岭的格子,连通了多个水域,对于分水岭上的格子区域归属我们使用一个简单的规则,采用连通区域中唯一标识符最大的区域。这样可以避免出现小标识符的区域赢家通吃的局面,区域划分更加均衡:

最后一次抬升水位,处理水位区间为[1,2]之间的格子,整个图像分割完毕:

在了解完整体算法核心流程之后,我们再来对照recast的源码进行分析。

距离场创建

分水岭算法的第一步要求把输入数据转换为深度图,在recast中对应的函数为rcBuildDistanceField,内部按序调用两个函数:

-

calculateDistanceField这个就是前面所说的距离场计算函数,这里的逻辑跟前述边界距离计算基本相同,不过前面是以不可行走的span为边界,二距离场计算时遇到span::area不同时就认为遇到了边界 -

boxBlur这个函数用来将距离执行一个周围均值计算,每个span的距离值等于自身距离值加上周围八个邻居span的距离值总和的平均值,这样就可以避免相邻span之间距离差异太大

在RecastDemo中可以可视化的将距离场数据展示出来,以灰度来表明距离区域边界的值,颜色越白代表距离边界越远,颜色越黑代表距离边界越近。

分水岭算法执行

搞定了距离场之后,开始正式的执行分水岭算法的流程,对应的函数为rcBuildRegions。函数开始时负责初始化一些变量,然后开始分水岭的持续迭代:

const int LOG_NB_STACKS = 3;

const int NB_STACKS = 1 << LOG_NB_STACKS; // 8

rcTempVector<LevelStackEntry> lvlStacks[NB_STACKS]; // 这是迭代时作为数组队列使用的结构

for (int i=0; i<NB_STACKS; ++i)

lvlStacks[i].reserve(256);

rcTempVector<LevelStackEntry> stack;

stack.reserve(256);

unsigned short regionId = 1;// 下一个有效的区域id 作为计数器使用

unsigned short level = (chf.maxDistance+1) & ~1; // 距离场的最大距离 + 1

// TODO: Figure better formula, expandIters defines how much the

// watershed "overflows" and simplifies the regions. Tying it to

// agent radius was usually good indication how greedy it could be.

// const int expandIters = 4 + walkableRadius * 2;

const int expandIters = 8;

int sId = -1;

while (level > 0)

{

level = level >= 2 ? level-2 : 0; // 每次迭代时level减2 因为我们定义的相邻span进行轴向移动时的距离为2

sId = (sId+1) & (NB_STACKS-1); // 更新当前要使用的是那一个LevelStackEntry

if (sId == 0)

// 如果迭代次数整除8了 那么遍历距离场里的span 将距离值在[level, level + 16)中的span投递到这八个LevelStackEntry中

// 投递的索引为 (dis - level)/2

sortCellsByLevel(level, chf, srcReg, NB_STACKS, lvlStacks, 1);

else

// 否则将上一次迭代中还没有分配有效region_id的span添加到当前迭代中来使用

appendStacks(lvlStacks[sId-1], lvlStacks[sId], srcReg);

// 分水岭算法的迭代逻辑

// expandRegions

// FloodRegions

}

这里使用sId来索引预先分配的八个LevelStackEntry是为了节省内存,如果每次迭代中都分配一个LevelStackEntry会造成内存很大的浪费,如果只采用双缓冲的话又会导致频繁的去调用sortCellsByLevel执行距离场的遍历,这里为了权衡效率使用了常见的8作为预先分配的数组个数。这样的操作之后,lvlStacks[sId]就存储了当前level里要考虑的span了,现在我们使用expandRegions进行区域扩张,看看哪些span能够合并到现有的区域之中:

static void expandRegions(int maxIter, unsigned short level,

rcCompactHeightfield& chf,

unsigned short* srcReg, unsigned short* srcDist,

rcTempVector<LevelStackEntry>& stack,

bool fillStack)

这个函数的第一个参数代表执行多少次迭代,每次迭代都会执行下面的代码,来尝试将stack里没有region_id的spans合并到相邻的region中:

for (int j = 0; j < stack.size(); j++)

{

int x = stack[j].x;

int y = stack[j].y;

int i = stack[j].index; // 这里的index字段为负数代表已经分配了对应的region

if (i < 0)

{

failed++;

continue;

}

// 所以当前span还没有分配对应region

unsigned short r = srcReg[i];

unsigned short d2 = 0xffff;

const unsigned char area = chf.areas[i];

const rcCompactSpan& s = chf.spans[i];

for (int dir = 0; dir < 4; ++dir)

{

// 遍历四个方向上的邻居

if (rcGetCon(s, dir) == RC_NOT_CONNECTED) continue;

const int ax = x + rcGetDirOffsetX(dir);

const int ay = y + rcGetDirOffsetY(dir);

const int ai = (int)chf.cells[ax+ay*w].index + rcGetCon(s, dir);

// 如果此邻居的表面类型与当前span的表面类型不一样 那么不参与与这个邻居的区域合并

if (chf.areas[ai] != area) continue;

if (srcReg[ai] > 0 && (srcReg[ai] & RC_BORDER_REG) == 0)

{

// srcReg[ai] 大于0代表不是边界,RC_BORDER_REG这个bit代表这个span在高度场的边界内

if ((int)srcDist[ai]+2 < (int)d2)

{

// 选择周围邻居中深度最小的那个作为合并region

// 这里并没有对深度相同时做更多的判断

r = srcReg[ai];

d2 = srcDist[ai]+2;

}

}

}

if (r)//如果从上面的四个邻居中找到了合并的目标region

{

stack[j].index = -1; // 标记为已经合并

dirtyEntries.push_back(DirtyEntry(i, r, d2)); //将合并的数据存下来

}

else

{

// 否则等待下一轮迭代处理

failed++;

}

}

对于在expandRegion执行后stack里还未设置对应region的span,调用floodRegion去尝试分配新的region_id:

// Mark new regions with IDs.

for (int j = 0; j<lvlStacks[sId].size(); j++)

{

LevelStackEntry current = lvlStacks[sId][j];

int x = current.x;

int y = current.y;

int i = current.index;

if (i >= 0 && srcReg[i] == 0)

{

if (floodRegion(x, y, i, level, regionId, chf, srcReg, srcDist, stack))

{

if (regionId == 0xFFFF)

{

ctx->log(RC_LOG_ERROR, "rcBuildRegions: Region ID overflow");

return false;

}

regionId++;

}

}

}

在这个floodRegion中,会执行用栈模拟的DFS遍历,将能从当前span连通的所有其他span都设置上对应的新region_id。不过这里递归时也是有条件的,如果当前要处理的span的八个邻居中存在一个已经分配了区域的span,那这个span不能加入到当前region中,需要等待下一次expandRegion时计算距离最短的region来赋值。这里遍历八个邻居的算法很巧妙,完全通过索引数组来计算的:

// 以顺时针遍历所有的八个邻居

for (int dir = 0; dir < 4; ++dir)

{

// 8 connected

if (rcGetCon(cs, dir) != RC_NOT_CONNECTED)

{

const int ax = cx + rcGetDirOffsetX(dir);

const int ay = cy + rcGetDirOffsetY(dir);

const int ai = (int)chf.cells[ax+ay*w].index + rcGetCon(cs, dir);

// as就是当前的轴向邻居

const rcCompactSpan& as = chf.spans[ai];

const int dir2 = (dir+1) & 0x3;

if (rcGetCon(as, dir2) != RC_NOT_CONNECTED)

{

const int ax2 = ax + rcGetDirOffsetX(dir2);

const int ay2 = ay + rcGetDirOffsetY(dir2);

const int ai2 = (int)chf.cells[ax2+ay2*w].index + rcGetCon(as, dir2);

// as2就是顺时针顺序中as的下一个

const rcCompactSpan& as2 = chf.spans[ai2];

}

}

}

下图就是对应的邻居遍历顺序:

至此,分水岭算法执行区域划分的流程结束。整体流程的时间复杂度大概为span的数量乘以距离场里的最大值,由于单cell中span数量最多为64,所以最坏时间复杂度大概为XZ平面边长的立方。因此随着场景的变大,此过程的执行时间会膨胀的很快。不过NavMesh一般都是离线执行的,所以一般来说也不在乎生成时间,同时又由于分水岭的区域分割效果比较好,因此默认选取这个算法作为区域生成算法。

region 结构体创建

在分水岭算法将span都标记好了对应的区域之后,开始调用mergeAndFilterRegions创建region信息。

struct rcRegion

{

inline rcRegion(unsigned short i) :

spanCount(0),

id(i),

areaType(0),

remap(false),

visited(false),

overlap(false),

connectsToBorder(false),

ymin(0xffff),

ymax(0)

{}

int spanCount; // 当前region内有多少个span

unsigned short id; // 当前region的唯一标识符 大于0

unsigned char areaType; // 当前region的区域类型

bool remap;

bool visited; // 这是一个临时变量不用管

bool overlap; // 当前region是否会跨层 即包括同一个cell里的多个span

bool connectsToBorder; // 当前region是否在边缘

unsigned short ymin, ymax; // 当前region的高度上下界

rcIntArray connections; // 与当前region连通的其他region的id

rcIntArray floors; //这里存储在`XZ`平面上与当前region有重叠的其他region的id

};

这里connections字段的初始化逻辑比较复杂,采用了下面的逻辑来处理:

// Check if this cell is next to a border.

int ndir = -1;

for (int dir = 0; dir < 4; ++dir)

{

if (isSolidEdge(chf, srcReg, x, y, i, dir))

{

ndir = dir;

break;

}

}

if (ndir != -1)

{

// The cell is at border.

// Walk around the contour to find all the neighbours.

walkContour(x, y, i, ndir, chf, srcReg, reg.connections);

}

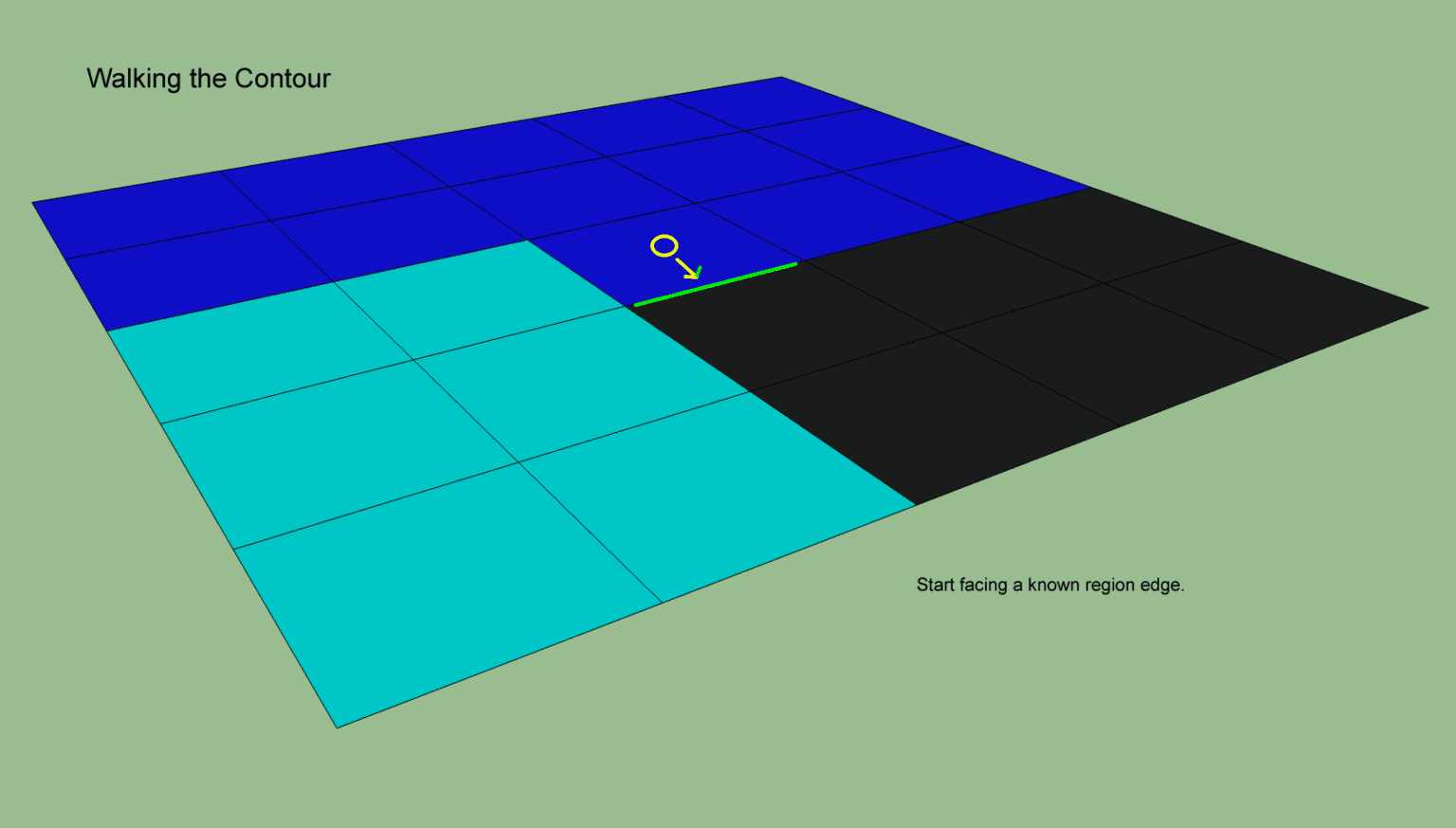

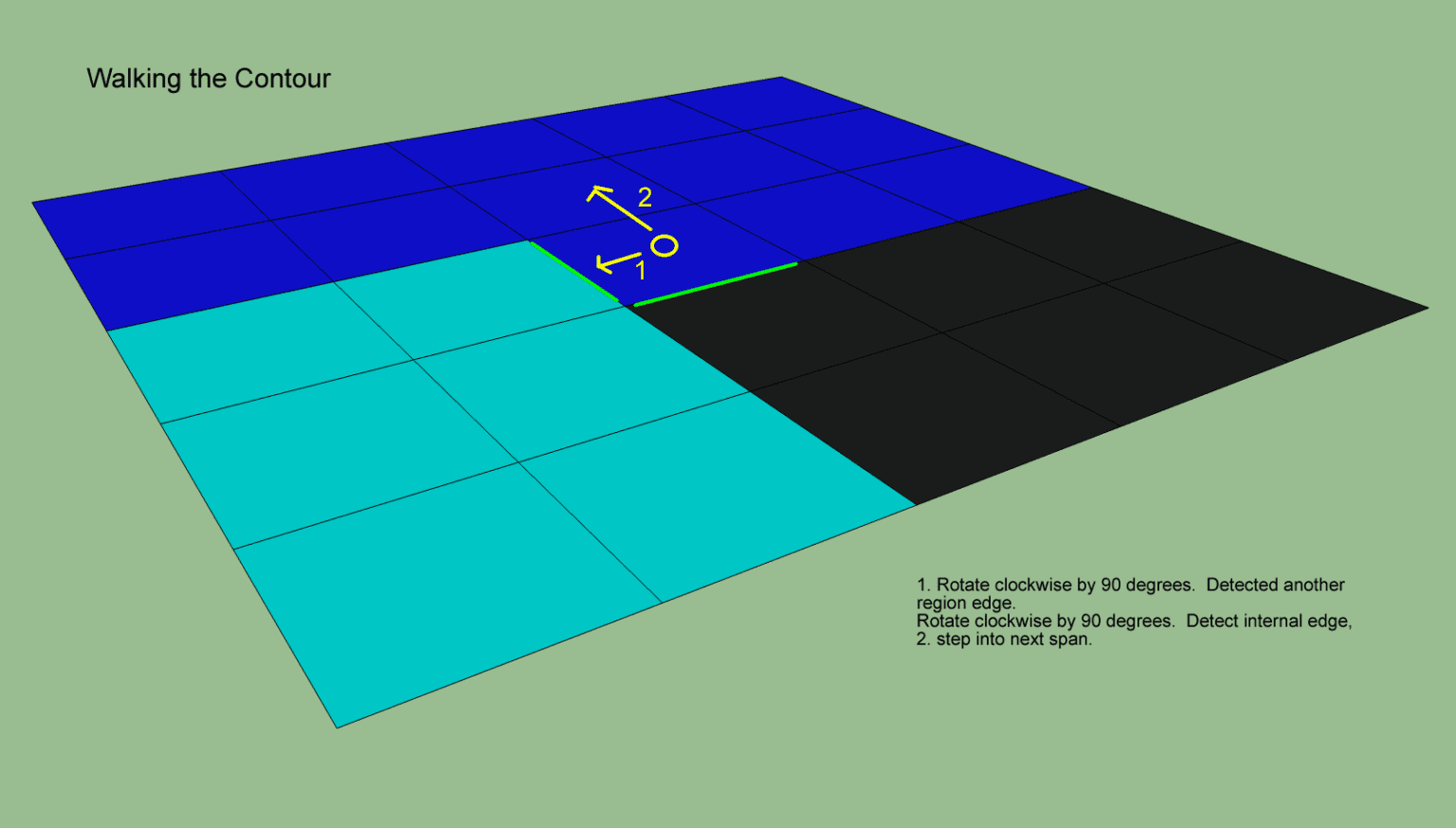

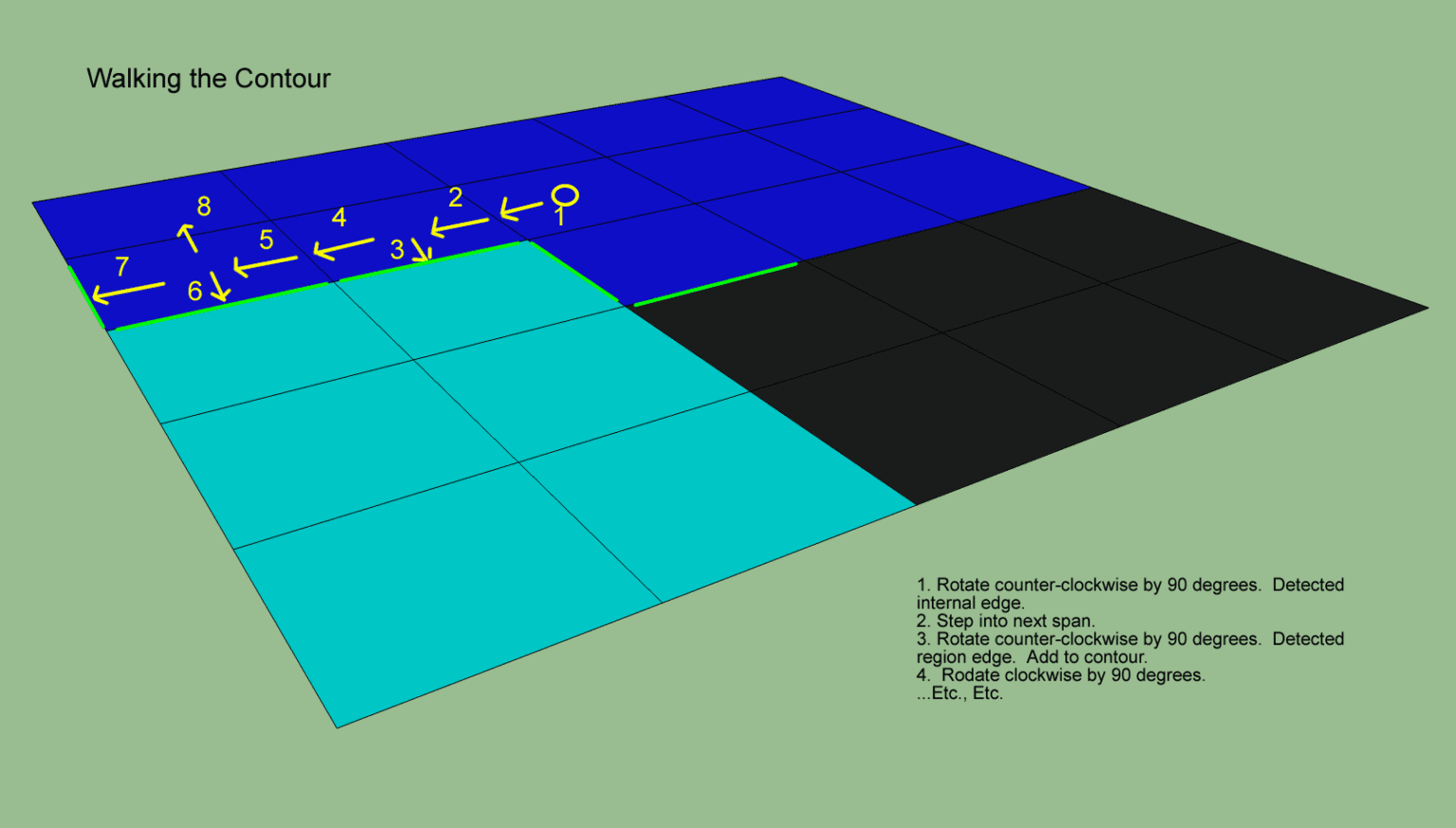

首先遍历当前span的四个方向邻居,调用isSolidEdge来判定当前span在dir方向的邻居是否归属于其他region。如果当前span存在某个方向能连接到其他region,则调用walkContour从这个span出来沿着当前region的边界上的span进行遍历,同时收集与当前region邻接的region_id存储到connections中。

static void walkContour(int x, int y, int i, int dir,

rcCompactHeightfield& chf,

const unsigned short* srcReg,

rcIntArray& cont)

{

// 初始的时候 cells[x][y] 上的span[i] 在dir方向能连通到其他区域 因此当前span肯定是当前region边界上的一个span

int startDir = dir;

int starti = i;

const rcCompactSpan& ss = chf.spans[i];

unsigned short curReg = 0;

if (rcGetCon(ss, dir) != RC_NOT_CONNECTED)

{

// 这个连通判断在外面已经判断通过了

const int ax = x + rcGetDirOffsetX(dir);

const int ay = y + rcGetDirOffsetY(dir);

const int ai = (int)chf.cells[ax+ay*chf.width].index + rcGetCon(ss, dir);

curReg = srcReg[ai];

}

cont.push(curReg); // 加入到连通数组中

int iter = 0;

while (++iter < 40000)

{

const rcCompactSpan& s = chf.spans[i];

// 获取当前要处理的span在当前dir方向是否能连接到其他region

if (isSolidEdge(chf, srcReg, x, y, i, dir))

{

// r代表此方向上的连通region

unsigned short r = 0;

if (rcGetCon(s, dir) != RC_NOT_CONNECTED)

{

const int ax = x + rcGetDirOffsetX(dir);

const int ay = y + rcGetDirOffsetY(dir);

const int ai = (int)chf.cells[ax+ay*chf.width].index + rcGetCon(s, dir);

r = srcReg[ai];

}

if (r != curReg)

{

curReg = r;

cont.push(curReg);

}

// 然后更新下一个判断方向,为顺时针遍历

dir = (dir+1) & 0x3; // Rotate CW

}

else

{

// 如果此方向上的邻居还属于当前region

int ni = -1;

const int nx = x + rcGetDirOffsetX(dir);

const int ny = y + rcGetDirOffsetY(dir);

if (rcGetCon(s, dir) != RC_NOT_CONNECTED)

{

const rcCompactCell& nc = chf.cells[nx+ny*chf.width];

ni = (int)nc.index + rcGetCon(s, dir);

}

if (ni == -1)

{

// Should not happen.

return;

}

// 则将span进行更新 同时方向逆时针回拨

x = nx;

y = ny;

i = ni;

dir = (dir+3) & 0x3; // Rotate CCW

}

if (starti == i && startDir == dir)

{

// 到这里说明已经回到了初始点的初始方向 遍历边界结束

break;

}

}

// 由于region与region之间的边界是连续的 所以con数组有很多连续相同的元素 这里会进行连续重复元素的精简

if (cont.size() > 1)

{

for (int j = 0; j < cont.size(); )

{

int nj = (j+1) % cont.size();

if (cont[j] == cont[nj])

{

for (int k = j; k < cont.size()-1; ++k)

cont[k] = cont[k+1];

cont.pop();

}

else

++j;

}

}

}

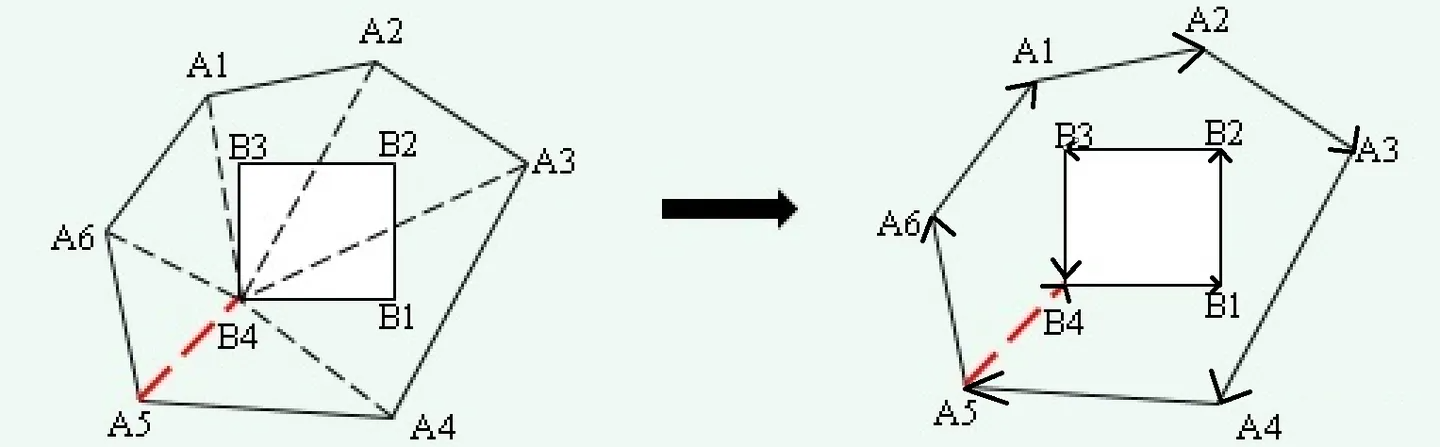

上面的遍历边界流程可以用下面的图形来可视化的展示,初始的时候我们选择这条浅蓝色的边,箭头指向的方向为其邻居region的连通方向:

然后继续遍历当前span顺时针下去的其他方向,直到某个方向上连接的是自身区域:

此时需要切换span,同时方向逆时针回拨90度,然后继续开始遍历边界,下面的带序号的边代表在对应的span里遍历四个轴方向的顺序:

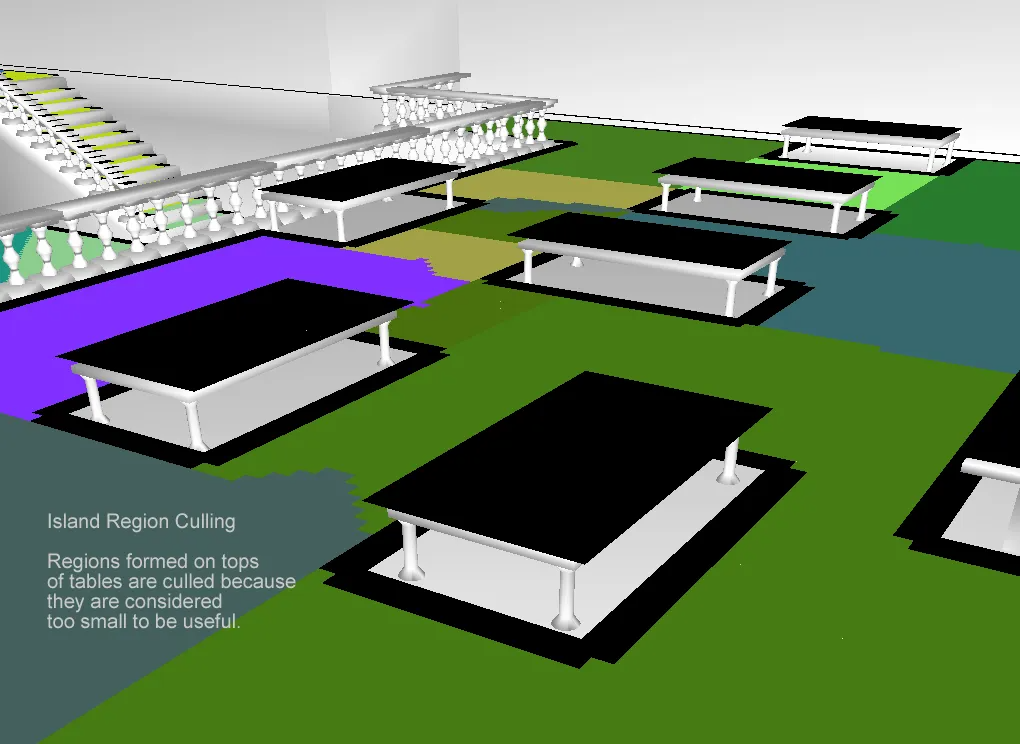

面积过小区域合并

建立了初始的区域之后还要接入一个后处理,删除一些面积过于小的区域。因为分水岭算法经常会造成一小块凸起区域被周围的一个大区域围住,导致后续的多边形划分出现问题。这里有个配置参数minRegionArea,代表最小可行走区域面积,用此参数来删除所有的小区域。实现上就是遍历所有生成的region,如果从这个region可直接或间接连通的所有region的span总数小于这个minRegionArea,这把这些连通的小region都删除:

// Remove too small regions.

rcIntArray stack(32);

rcIntArray trace(32);

for (int i = 0; i < nreg; ++i)

{

rcRegion& reg = regions[i];

if (reg.id == 0 || (reg.id & RC_BORDER_REG)) //边界region不处理

continue;

if (reg.spanCount == 0) //异常region不处理

continue;

if (reg.visited) // 已经在之前遍历的region连通过了 不处理

continue;

// Count the total size of all the connected regions.

// Also keep track of the regions connects to a tile border.

bool connectsToBorder = false;

int spanCount = 0;

stack.clear();

trace.clear();

reg.visited = true;

stack.push(i);

// 下面计算所有可以从当前region出发能到达的region的集合 其实就是一个无向图的连通分量

while (stack.size())

{

// Pop

int ri = stack.pop();

rcRegion& creg = regions[ri];

spanCount += creg.spanCount;

trace.push(ri);

for (int j = 0; j < creg.connections.size(); ++j)

{

if (creg.connections[j] & RC_BORDER_REG)

{

connectsToBorder = true;

continue;

}

rcRegion& neireg = regions[creg.connections[j]];

if (neireg.visited)

continue;

if (neireg.id == 0 || (neireg.id & RC_BORDER_REG))

continue;

// Visit

stack.push(neireg.id);

neireg.visited = true;

}

}

// 如果当前连通分量的span数量小于指定值,且不是tile边界上的的区域 则删除当前连通分量里的所有region

if (spanCount < minRegionArea && !connectsToBorder)

{

// Kill all visited regions.

for (int j = 0; j < trace.size(); ++j)

{

regions[trace[j]].spanCount = 0;

regions[trace[j]].id = 0;

}

}

}

最终成果就是将下图中的桌面设置为了不可行走,因为其表面积太小了:

裁剪完成之后,一些小区域仍然可能残留下来,因为其连通着某些大区域,此时需要将这些小区域合并到对应的大区域中,这里有一个配置参数mergeRegionSize,span数量小于此配置的region将会被合并,不过两个region能否合并还需要通过一个额外的测试:

static bool canMergeWithRegion(const rcRegion& rega, const rcRegion& regb)

{

// 两个区域的表面类型不同 无法合并

if (rega.areaType != regb.areaType)

return false;

int n = 0;

for (int i = 0; i < rega.connections.size(); ++i)

{

if (rega.connections[i] == regb.id)

n++;

}

// 如果两者之间有多条邻接边 合并时可能导致新的大region把原来的某个临接region包围住 因此不能合并

if (n > 1)

return false;

// 如果两个区域在XZ平面上有重叠,也不能参与合并

for (int i = 0; i < rega.floors.size(); ++i)

{

if (rega.floors[i] == regb.id)

return false;

}

return true;

}

有了上面这个合并限制之后,开始循环检测所有的region中是否有可以合并的:

// Merge too small regions to neighbour regions.

int mergeCount = 0 ;

do

{

mergeCount = 0;

for (int i = 0; i < nreg; ++i)

{

rcRegion& reg = regions[i];

if (reg.id == 0 || (reg.id & RC_BORDER_REG)) // 不可行走或者tile边界区域不会合并

continue;

if (reg.overlap) // 有跨层联通span的不会合并

continue;

if (reg.spanCount == 0) // 异常区域不会合并

continue;

// span数量大于这个值 且有个边界区域邻居的 不参与合并

if (reg.spanCount > mergeRegionSize && isRegionConnectedToBorder(reg))

continue;

// 遍历当前所有的邻居区域找到其中span数量最小的region

int smallest = 0xfffffff;

unsigned short mergeId = reg.id;

for (int j = 0; j < reg.connections.size(); ++j)

{

if (reg.connections[j] & RC_BORDER_REG) continue;

rcRegion& mreg = regions[reg.connections[j]];

// 这里要排除所有与边界region连通的邻居

if (mreg.id == 0 || (mreg.id & RC_BORDER_REG) || mreg.overlap) continue;

if (mreg.spanCount < smallest &&

canMergeWithRegion(reg, mreg) &&

canMergeWithRegion(mreg, reg))

{

smallest = mreg.spanCount;

mergeId = mreg.id;

}

}

// 找到一个邻居 将当前region合并过去

if (mergeId != reg.id)

{

unsigned short oldId = reg.id;

rcRegion& target = regions[mergeId];

// 执行span的合并 更新邻居列表

if (mergeRegions(target, reg))

{

for (int j = 0; j < nreg; ++j)

{

if (regions[j].id == 0 || (regions[j].id & RC_BORDER_REG)) continue;

// 如果之前有一个region已经被合并到了当前region 更新其合并目标为新的region

if (regions[j].id == oldId)

regions[j].id = mergeId;

// 将原来所有region里指向当前region的边 都替换为指向要合并的region

replaceNeighbour(regions[j], oldId, mergeId);

}

mergeCount++;

}

}

}

}

while (mergeCount > 0); // 直到一轮循环过后没有新的region触发合并 才结束整体的合并流程

区域重映射

经过区域裁剪和合并后,有效region会变少。为了减少后续操作中不必要的内存开销,现在需要对区域的regionID执行remap操作来重新映射为连续的数字,以此来降低regionID的最大值。

// Compress region Ids.

for (int i = 0; i < nreg; ++i)

{

regions[i].remap = false;

if (regions[i].id == 0) continue; // Skip nil regions.

if (regions[i].id & RC_BORDER_REG) continue; // Skip external regions.

regions[i].remap = true; // 标记所有可行走的且非边界上的区域为可重定向

}

unsigned short regIdGen = 0;

for (int i = 0; i < nreg; ++i)

{

if (!regions[i].remap) // 如果已经被重定向了 则不需要处理

continue;

unsigned short oldId = regions[i].id;

unsigned short newId = ++regIdGen;

// 合并组里的id统一更换

for (int j = i; j < nreg; ++j)

{

if (regions[j].id == oldId)

{

regions[j].id = newId;

regions[j].remap = false;

}

}

}

maxRegionId = regIdGen;

// 最后更新span对应的区域id

for (int i = 0; i < chf.spanCount; ++i)

{

if ((srcReg[i] & RC_BORDER_REG) == 0)

srcReg[i] = regions[srcReg[i]].id;

}

区域的重叠问题

这里其实还有最后一个步骤,将所有含有跨层数据的区域的id记录下来并返回:

// Return regions that we found to be overlapping.

for (int i = 0; i < nreg; ++i)

if (regions[i].overlap)

overlaps.push(regions[i].id);

但是其实外部并没有对这个数组做处理,只是在注释里说要把这些与自身重叠的区域拆成多个不重叠的:

// Merge regions and filter out smalle regions.

rcIntArray overlaps;

chf.maxRegions = regionId;

if (!mergeAndFilterRegions(ctx, minRegionArea, mergeRegionArea, chf.maxRegions, chf, srcReg, overlaps))

return false;

// If overlapping regions were found during merging, split those regions.

if (overlaps.size() > 0)

{

ctx->log(RC_LOG_ERROR, "rcBuildRegions: %d overlapping regions.", overlaps.size());

}

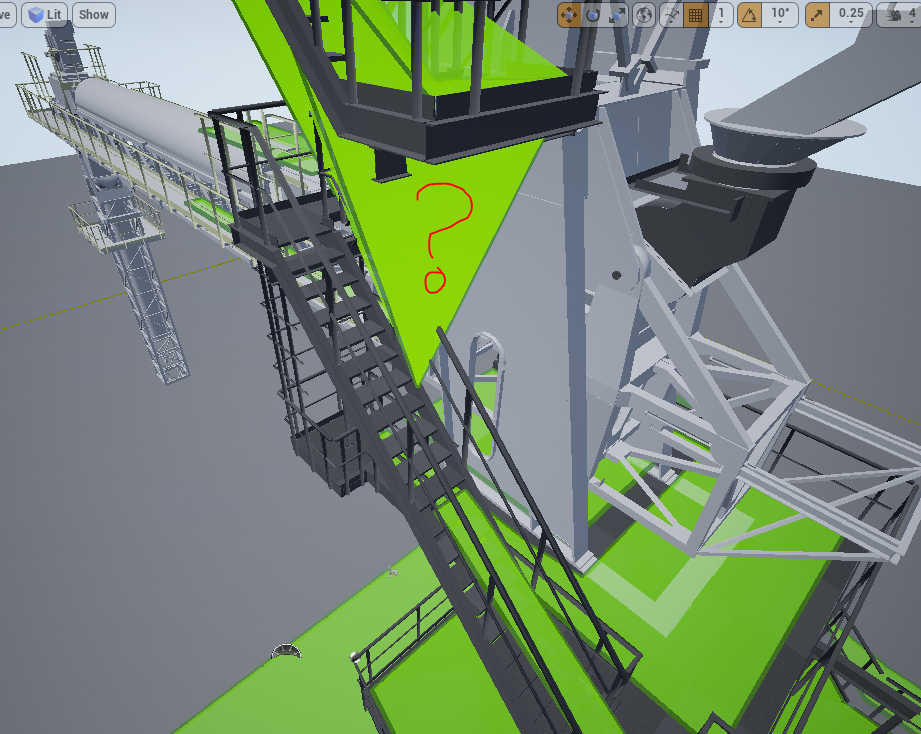

看来只是写了一个TODO,但是没有具体实现,打了一个错误日志对使用者进行警告。那这种overlap的情况会带来怎样的危害呢,请看下图:

在这张图中,我们发现在旋转楼梯上出现了一个很不符合直觉的可行走三角形,同时一些本来应该在楼梯上的三角形并没有生成。造成这个异常的原因是螺旋楼梯中的一部分跨层数据归属于同一个region,然后这种跨层region在后续的三角形切分时无法正确的被处理。

如果想要去解决这个overlap问题,则需要将这个region继续做切分。最简单的做法就是选择一个特定高度Y的XZ平面将原有的区域切分成为上中下三个部分,所有底面高度大于Y+walkableClimb的span划分到一个region,所有底面高度小于Y-walkableClimb的span划分到一个region,剩下的span划分为一个region, 如果切分后的region还有重叠部分再继续切割。例如上图中选择旋转楼梯的转角平面部分作为切分平面,两个切分平面构造出五个不再overlap的区域。当然这个方法也不保证一定有效,所以recast官方也暂时将此问题搁置了。

使用单调分区算法进行区域分割

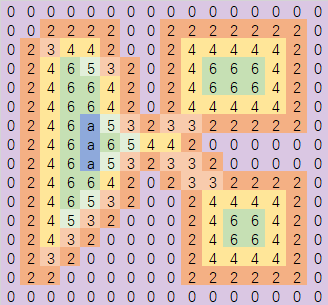

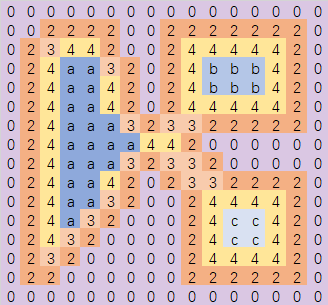

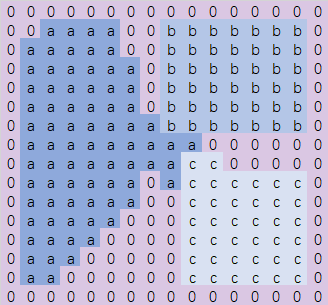

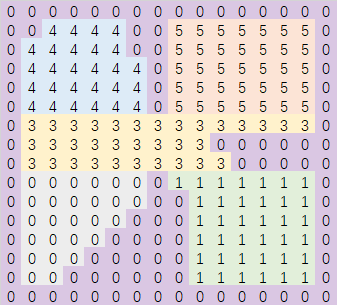

单调分区算法相对于分水岭算法来说就简单很多了,在平面网格上进行一次二维遍历即可得到结果区域,下面我们继续使用之前使用的平面网格示例来介绍其算法核心思想。初始时的平面网格如下:

在这个地图上我们开始从下到上从左到右的逐行扫描,如果遇到一个不与之前分配好的region连通的可行走网格,则分配一个新的region。所以扫描了第一行之后,我们创建了两个新的区域:

再向上扫描一行,得到下面的区域扩散结果:

继续扫描四行,结果如下:

此时要扫描的下一行有点特殊,因为这一行会同时与区域0和区域1相交,对于这种同时与多个区域相连通的连续行,分配一个新的region,继续向上扫描两行之后得到了下面的结果:

再上面一行会出现两个不连通的连续区域,此时将这两个区域分配新的region,然后继续向上,得到的最终结果如下:

在Recast的源码中负责这个流程的函数为rcBuildRegionsMonotone, 在函数流程中为了方便记录每一行切分出来的每条连续网格组成的条带,使用了下面的数据结构:

struct rcSweepSpan

{

unsigned short rid; // 当前条带在所属行里的条带id

unsigned short id; // 当前条带分配的区域id

unsigned short ns; // 当前条带里的span数量

unsigned short nei; // 当前条带下方的邻居区域id 0代表没有初始化 RC_NULL_NEI 代表有多个

};

算法开始时需要分配好一些资源:

const int nsweeps = rcMax(chf.width,chf.height); // 最坏情况下每个cell单独一个条带

rcScopedDelete<rcSweepSpan> sweeps((rcSweepSpan*)rcAlloc(sizeof(rcSweepSpan)*nsweeps, RC_ALLOC_TEMP));

rcIntArray prev(256); // 存储

unsigned short id = 1; // 用来分配区域id的计数器

// 每次扫描XZ平面的一行

for (int y = borderSize; y < h-borderSize; ++y)

{

// Collect spans from this row.

prev.resize(id+1);

memset(&prev[0],0,sizeof(int)*id);

unsigned short rid = 1;

for (int x = borderSize; x < w-borderSize; ++x)

{

// 遍历这行中的每一个cell

const rcCompactCell& c = chf.cells[x+y*w];

for (int i = (int)c.index, ni = (int)(c.index+c.count); i < ni; ++i)

{

// 遍历当前cell里的每一个span

const rcCompactSpan& s = chf.spans[i];

if (chf.areas[i] == RC_NULL_AREA) continue;

// 找到当前spanXZ平面左边的邻居对应的已分配区域id

unsigned short previd = 0;

if (rcGetCon(s, 0) != RC_NOT_CONNECTED)

{

const int ax = x + rcGetDirOffsetX(0);

const int ay = y + rcGetDirOffsetY(0);

const int ai = (int)chf.cells[ax+ay*w].index + rcGetCon(s, 0);

if ((srcReg[ai] & RC_BORDER_REG) == 0 && chf.areas[i] == chf.areas[ai])

previd = srcReg[ai];

}

if (!previd) // 如果左边没有邻居 说明当前span是一个新的条带的开始 分配一个新的条带id

{

previd = rid++;

sweeps[previd].rid = previd;

sweeps[previd].ns = 0;

sweeps[previd].nei = 0;

}

// 然后再找当前span下方邻居对应的区域id

if (rcGetCon(s,3) != RC_NOT_CONNECTED)

{

const int ax = x + rcGetDirOffsetX(3);

const int ay = y + rcGetDirOffsetY(3);

const int ai = (int)chf.cells[ax+ay*w].index + rcGetCon(s, 3);

if (srcReg[ai] && (srcReg[ai] & RC_BORDER_REG) == 0 && chf.areas[i] == chf.areas[ai])

{

unsigned short nr = srcReg[ai];

if (!sweeps[previd].nei || sweeps[previd].nei == nr)

{

// 如果前面条带下方邻居区域没有初始化过 或者下方的邻居所属区域等于前面计算好的邻居区域id

// 则把当前点加入到前面条带中

sweeps[previd].nei = nr;

sweeps[previd].ns++;

prev[nr]++;

}

else

{

// 前面条带下面有多个不同区域的邻居 需要分配单独的区域id

sweeps[previd].nei = RC_NULL_NEI;

}

}

}

// 先暂时赋值为条带id 等待后续条带id分配了region id之后再修正

srcReg[i] = previd;

}

}

// Create unique ID.

for (int i = 1; i < rid; ++i)

{

// 遍历前面分割出来的多个条带

if (sweeps[i].nei != RC_NULL_NEI && sweeps[i].nei != 0 &&

prev[sweeps[i].nei] == (int)sweeps[i].ns)

{

// 如果这个条带下方的邻居区域只有一个 且这个邻居区域上方的条带也只有一个

// 则当前条带的区域id等于其下方邻居所属的区域id

sweeps[i].id = sweeps[i].nei;

}

else

{

// 下方有多个相邻区域 或者与多个条带共享当前下方的邻居

// 需要分配一个新的区域id

sweeps[i].id = id++;

}

}

// 所有的条带id都分配了一个对应的region id之后

// 将每个span的region id正确的赋值为对应条带的region id

for (int x = borderSize; x < w-borderSize; ++x)

{

const rcCompactCell& c = chf.cells[x+y*w];

for (int i = (int)c.index, ni = (int)(c.index+c.count); i < ni; ++i)

{

if (srcReg[i] > 0 && srcReg[i] < rid)

srcReg[i] = sweeps[srcReg[i]].id;

}

}

}

上面的部分就是执行monotone算法的过程,函数整体就是使用三重循环去遍历所有的span,所以整个monotone算法的时间复杂度为span数量的常数,已经不可能再降低下去了。但是这个算法过于追求速度导致了区域的形状非常不令人满意,会出现很多的长条,唯一的好处就是这种分区方法不会造成前述的overlap问题。

执行完成之后也会调用mergeAndFilterRegions这个函数来创建Region结构体并合并一些过于小的区域到周围的大区域中。

{

rcScopedTimer timerFilter(ctx, RC_TIMER_BUILD_REGIONS_FILTER);

// Merge regions and filter out small regions.

rcIntArray overlaps;

chf.maxRegions = id;

if (!mergeAndFilterRegions(ctx, minRegionArea, mergeRegionArea, chf.maxRegions, chf, srcReg, overlaps))

return false;

// Monotone partitioning does not generate overlapping regions.

}

由于mergeAndFilterRegions的时间复杂度也是span数量的常数,所以整体不影响rcBuildRegionsMonotone的整体时间复杂度。,但是调用mergeAndFilterRegions合并之后可能会导致region的overlap。除非是运行时生成NavMesh。正常情况下不会去选择monotone作为生成方式。

使用分层算法进行区域分割

这里分层算法的入口是rcBuildLayerRegions,这个算法基本等价于monotone算法,唯一的修正就是进行最后的区域合并过程调用的不再是可能会造成overlap的mergeAndFilterRegions,换成了一个确保不会造成overlap的mergeAndFilterLayerRegions。不过这个函数与mergeAndFilterRegions的差异没多大,就下面部分体现出了不同,这部分代码在创建初始Region之后:

// Create 2D layers from regions.

unsigned short layerId = 1;

for (int i = 0; i < nreg; ++i)

regions[i].id = 0;

// Merge montone regions to create non-overlapping areas.

rcIntArray stack(32);

for (int i = 1; i < nreg; ++i)

{

rcRegion& root = regions[i];

// Skip already visited.

if (root.id != 0)

continue;

// Start search.

root.id = layerId;

stack.clear();

stack.push(i);

while (stack.size() > 0)

{

// Pop front

rcRegion& reg = regions[stack[0]];

for (int j = 0; j < stack.size()-1; ++j)

stack[j] = stack[j+1];

stack.resize(stack.size()-1);

const int ncons = (int)reg.connections.size();

for (int j = 0; j < ncons; ++j)

{

const int nei = reg.connections[j];

rcRegion& regn = regions[nei];

// Skip already visited.

if (regn.id != 0)

continue;

// Skip if different area type, do not connect regions with different area type.

if (reg.areaType != regn.areaType)

continue;

// 如果当前邻居span所属的region与当前合并中的region有xz平面交集 则禁止合并

bool overlap = false;

for (int k = 0; k < root.floors.size(); k++)

{

if (root.floors[k] == nei)

{

overlap = true;

break;

}

}

if (overlap)

continue;

// Deepen

stack.push(nei);

// Mark layer id

regn.id = layerId;

// 如果合并进去了 则将地面xz的相交区域扩大

for (int k = 0; k < regn.floors.size(); ++k)

addUniqueFloorRegion(root, regn.floors[k]);

root.ymin = rcMin(root.ymin, regn.ymin);

root.ymax = rcMax(root.ymax, regn.ymax);

root.spanCount += regn.spanCount;

regn.spanCount = 0;

root.connectsToBorder = root.connectsToBorder || regn.connectsToBorder;

}

}

layerId++;

}

上面的代码就是查找连接过来的region时如果发现与当前计算出来的合并区域有overlap的地方,则不把这个区域与当前已经生成的合并区域进行合并。不过这个函数无法在分水岭生成的初始区域上执行,因为分水岭生成的初始区域可能已经有overlap了,这里再考虑避免overlap已经晚了。

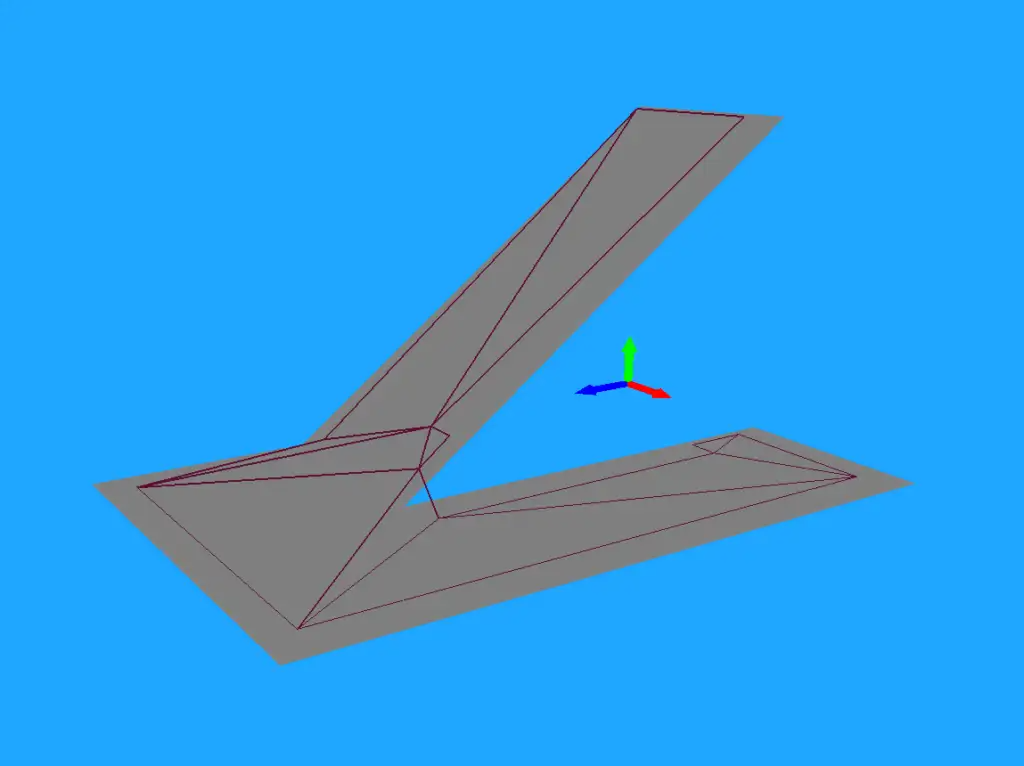

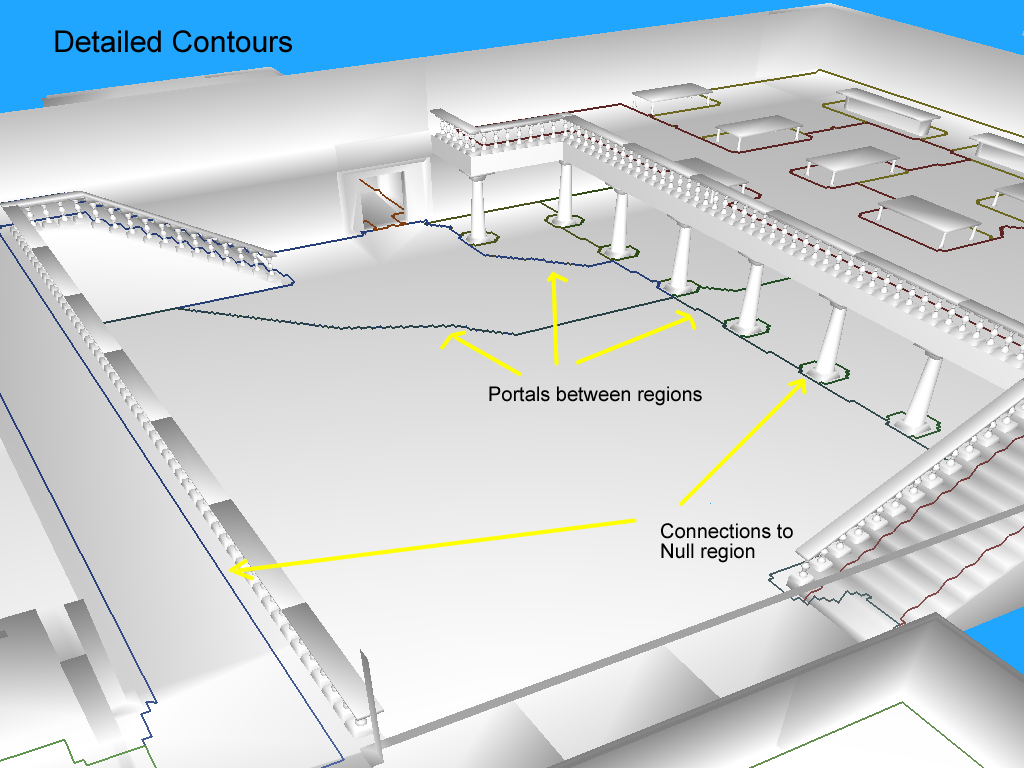

区域轮廓生成与平滑

在经过区域生成之后,原有的压缩高度场里的span都分配好了对应的区域id。这些区域数据可以极大的加速原来基于span的联通路径查找,因为我们可以把整个场景的连通图从span连通图切换到区域连通图,节点数量会降低到原来的几十分之一甚至几百分之一。但是Recast并没有止步于此,因为存储span的压缩高度场数据消耗了过多的内存。为了打造一个更加完美的寻路数据结构,需要找到一个更省内存的描述区域数据的方法。Recast使用的方法是只存储区域的边界信息,生成一些简单的多边形,也就是区域的轮廓Contour,这个过程对应的函数为rcBuildContours。

标记在边界区域的span

这部分的代码很简单,遍历每个span查找其四个方向的邻居所属区域是否等于当前区域即可:

// 这里的flag数组标记每个span在四个方向是否与其他非自身可行区域相连 如果相连则对应方向的bit设置为1

// 如果与边界相邻 则设置为0

rcScopedDelete<unsigned char> flags((unsigned char*)rcAlloc(sizeof(unsigned char)*chf.spanCount, RC_ALLOC_TEMP));

// Mark boundaries.

for (int y = 0; y < h; ++y)

{

for (int x = 0; x < w; ++x)

{

const rcCompactCell& c = chf.cells[x+y*w];

for (int i = (int)c.index, ni = (int)(c.index+c.count); i < ni; ++i)

{

unsigned char res = 0;

const rcCompactSpan& s = chf.spans[i];

if (!chf.spans[i].reg || (chf.spans[i].reg & RC_BORDER_REG))

{

flags[i] = 0;

continue;

}

for (int dir = 0; dir < 4; ++dir)

{

unsigned short r = 0;

if (rcGetCon(s, dir) != RC_NOT_CONNECTED) // 找到当前方向的邻居span所在的区域

{

const int ax = x + rcGetDirOffsetX(dir);

const int ay = y + rcGetDirOffsetY(dir);

const int ai = (int)chf.cells[ax+ay*w].index + rcGetCon(s, dir);

r = chf.spans[ai].reg;

}

if (r == chf.spans[i].reg) // 如果邻居区域与当前span的区域相同

res |= (1 << dir); // 则这方向对应的bit设置为1

}

// 然后取反 所以某个方向的bit为1代表此方向连通到其他区域

flags[i] = res ^ 0xf;

}

}

}

构造区域轮廓点

这里定义了一个与之前创建Region时使用的WalkContour同名的函数来收集一个Region的顺时针存储的边界span列表。之所以同名是因为其逻辑类似,但是又有那么一些不同。

static void walkContour(int x, int y, int i,

rcCompactHeightfield& chf,

unsigned char* flags, rcIntArray& points)

{

// 找到第一个与其他区域连通的方向

unsigned char dir = 0;

while ((flags[i] & (1 << dir)) == 0)

dir++;

unsigned char startDir = dir;

int starti = i;

const unsigned char area = chf.areas[i];

int iter = 0;

while (++iter < 40000)

{

// 如果当前span在dir方向联通到了其他区域

if (flags[i] & (1 << dir))

{

bool isBorderVertex = false;

bool isAreaBorder = false;

// 下面的px py pz 代表当前点对应的轮廓点坐标

int px = x;

int py = getCornerHeight(x, y, i, dir, chf, isBorderVertex);

int pz = y;

switch(dir)

{

case 0: pz++; break;

case 1: px++; pz++; break;

case 2: px++; break;

}

int r = 0;

const rcCompactSpan& s = chf.spans[i];

if (rcGetCon(s, dir) != RC_NOT_CONNECTED)

{

const int ax = x + rcGetDirOffsetX(dir);

const int ay = y + rcGetDirOffsetY(dir);

const int ai = (int)chf.cells[ax+ay*chf.width].index + rcGetCon(s, dir);

r = (int)chf.spans[ai].reg;

if (area != chf.areas[ai]) // 检测邻居区域的地表类型是否改变

isAreaBorder = true;

}

if (isBorderVertex)

r |= RC_BORDER_VERTEX;

if (isAreaBorder)

r |= RC_AREA_BORDER;

// 将当前点加入到边界拐角点

points.push(px);

points.push(py);

points.push(pz);

points.push(r);

// 清除掉此方向的边界联通标记 避免后面的循环重复处理

flags[i] &= ~(1 << dir);

dir = (dir+1) & 0x3; // 顺时针旋转90度

}

else

{

// 如果此方向不与其他区域相连 那么应该是与当前同区域的一个span相连

int ni = -1; // 记录此方向 联通的邻居span的索引

const int nx = x + rcGetDirOffsetX(dir);

const int ny = y + rcGetDirOffsetY(dir);

const rcCompactSpan& s = chf.spans[i];

if (rcGetCon(s, dir) != RC_NOT_CONNECTED)

{

const rcCompactCell& nc = chf.cells[nx+ny*chf.width];

ni = (int)nc.index + rcGetCon(s, dir);

}

if (ni == -1)

{

// Should not happen.

return;

}

// 跳转到这个邻居span

x = nx;

y = ny;

i = ni;

dir = (dir+3) & 0x3; // 同时逆时针旋转90度

}

if (starti == i && startDir == dir) // 如果遇到了开始时的节点与方向 则迭代结束

{

break;

}

}

}

这个walkContour函数与区域构建时的walkContour唯一不同的地方在于计算了遍历时遇到的轮廓点(px, py, pz)。轮廓点连接起来则组成了当前Region的轮廓边,为了让相邻的两个区域共享同一条轮廓边,需要让两个连通且属于不同区域的span计算出来的轮廓点坐标相同。所以这里的轮廓点根据连通方向来选择:

- 连通方向为左边

dir=0,轮廓点选择当前span的XZ上方,即pz++ - 连通方向为上边

dir=1,轮廓点选择当前span的XZ右上方,即px++,pz++ - 连通方向为右边

dir=2,轮廓点选择当前span的XZ右方,即px++ - 连通方向为下边

dir=3,轮廓点取其自身

所以一个轮廓点会最多对应四个边界span。

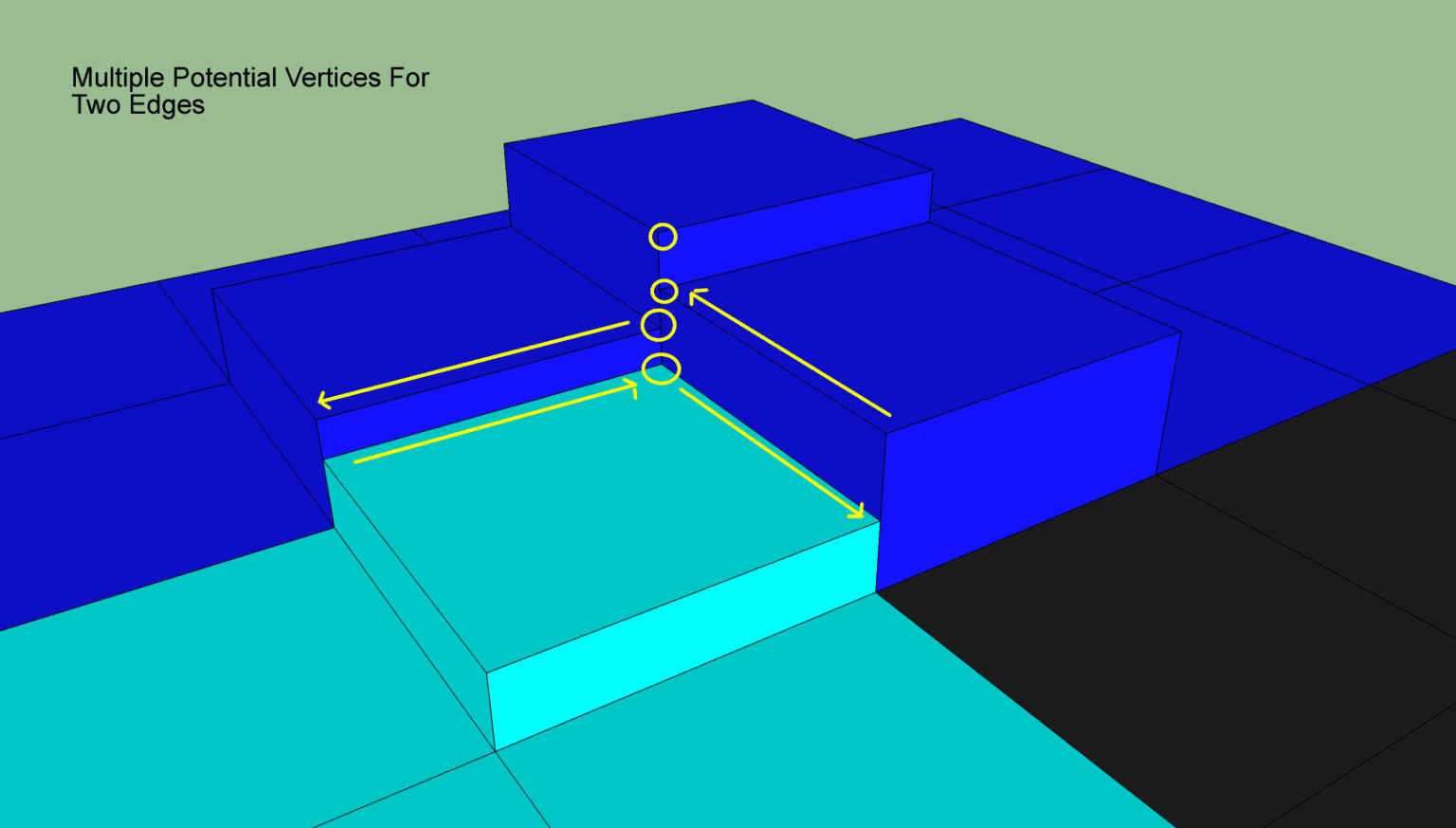

上面的规则只是计算出来了轮廓点的XZ平面坐标,我们还需要知道这个轮廓点的Y轴坐标。由于同一个span作为轮廓点可能出现四次,所以其Y轴坐标有四种选择方案:

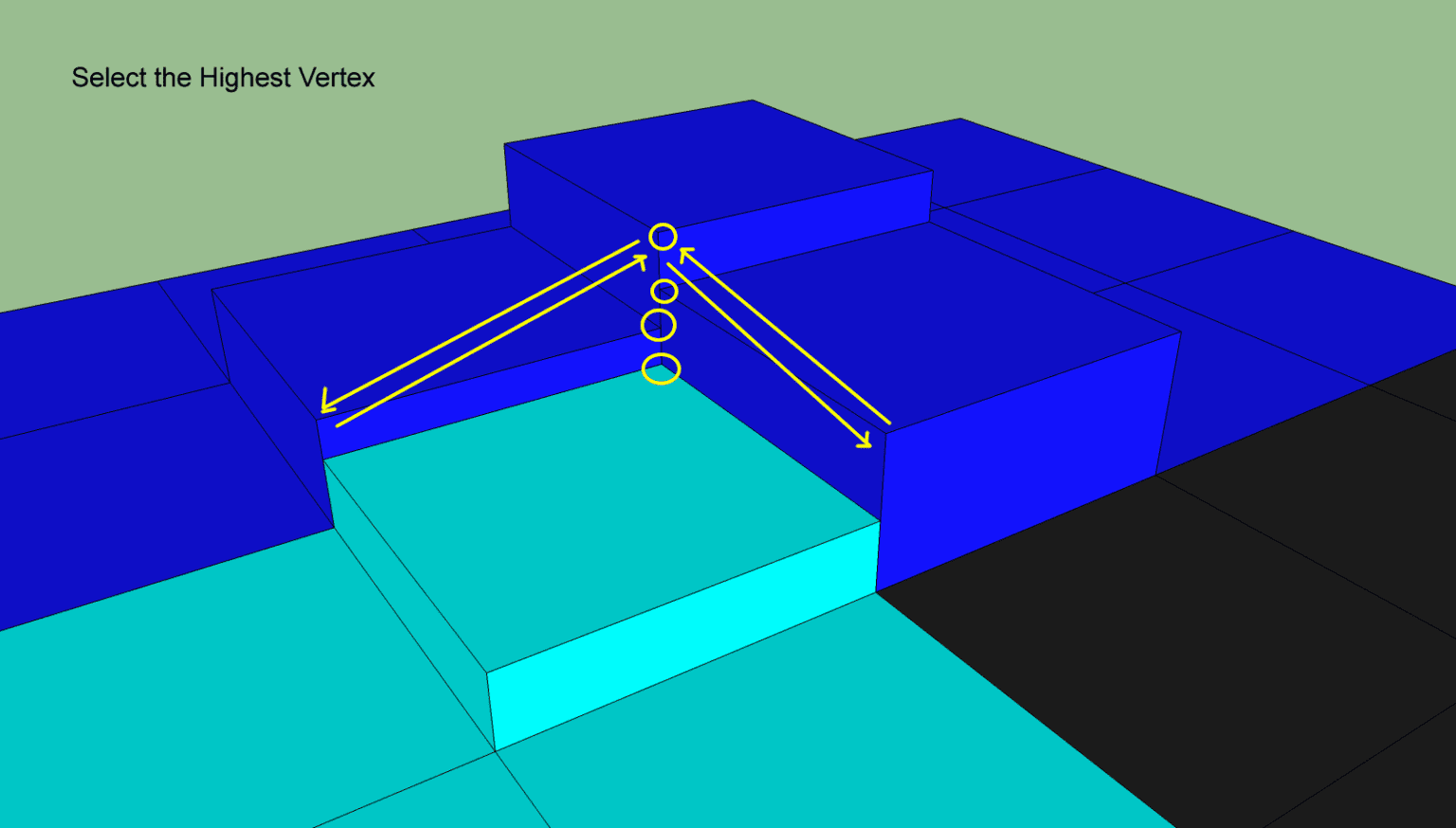

为了避免出现太多的轮廓点,我们需要为这四种情况计算出相同的Y轴坐标,最安全的的方法就是选取表面高度最高的,这样能避免轮廓边与地表出现穿插:

这部分使用了getCornerHeight(x, y, i, dir, chf, isBorderVertex)来计算,不过这个函数不仅计算了轮廓点的Y值,还计算了这个轮廓点是否处于边界上:

static int getCornerHeight(int x, int y, int i, int dir,

const rcCompactHeightfield& chf,

bool& isBorderVertex)

{

const rcCompactSpan& s = chf.spans[i];

int ch = (int)s.y;

int dirp = (dir+1) & 0x3; //顺时针旋转90度

// 一个轮廓点对应了四个span 0自身 1 dir方向 2 dir+45度 3 dir加90度

unsigned int regs[4] = {0,0,0,0};

// 每个int低16位代表邻居的区域id 高16位代表邻居的地表类型

// 在两个不同地表边界上的轮廓点会被标记起来

regs[0] = chf.spans[i].reg | (chf.areas[i] << 16);

if (rcGetCon(s, dir) != RC_NOT_CONNECTED)

{

const int ax = x + rcGetDirOffsetX(dir);

const int ay = y + rcGetDirOffsetY(dir);

const int ai = (int)chf.cells[ax+ay*chf.width].index + rcGetCon(s, dir);

const rcCompactSpan& as = chf.spans[ai];

ch = rcMax(ch, (int)as.y);

regs[1] = chf.spans[ai].reg | (chf.areas[ai] << 16); //

if (rcGetCon(as, dirp) != RC_NOT_CONNECTED)

{

// 这里就是dir + 45度的邻居

const int ax2 = ax + rcGetDirOffsetX(dirp);

const int ay2 = ay + rcGetDirOffsetY(dirp);

const int ai2 = (int)chf.cells[ax2+ay2*chf.width].index + rcGetCon(as, dirp);

const rcCompactSpan& as2 = chf.spans[ai2];

ch = rcMax(ch, (int)as2.y);

regs[2] = chf.spans[ai2].reg | (chf.areas[ai2] << 16);

}

}

if (rcGetCon(s, dirp) != RC_NOT_CONNECTED)

{

// 这里是dir + 90度的邻居

const int ax = x + rcGetDirOffsetX(dirp);

const int ay = y + rcGetDirOffsetY(dirp);

const int ai = (int)chf.cells[ax+ay*chf.width].index + rcGetCon(s, dirp);

const rcCompactSpan& as = chf.spans[ai];

ch = rcMax(ch, (int)as.y);

regs[3] = chf.spans[ai].reg | (chf.areas[ai] << 16);

if (rcGetCon(as, dir) != RC_NOT_CONNECTED)

{

// 这里又计算了一次dir + 45

const int ax2 = ax + rcGetDirOffsetX(dir);

const int ay2 = ay + rcGetDirOffsetY(dir);

const int ai2 = (int)chf.cells[ax2+ay2*chf.width].index + rcGetCon(as, dir);

const rcCompactSpan& as2 = chf.spans[ai2];

ch = rcMax(ch, (int)as2.y);

regs[2] = chf.spans[ai2].reg | (chf.areas[ai2] << 16);

}

}

// 检查是否是特殊边界顶点

for (int j = 0; j < 4; ++j)

{

// 构造顺时针顺序

const int a = j;

const int b = (j+1) & 0x3;

const int c = (j+2) & 0x3;

const int d = (j+3) & 0x3;

// 当前span与后面的span同属于一个边界区域

const bool twoSameExts = (regs[a] & regs[b] & RC_BORDER_REG) != 0 && regs[a] == regs[b];

// 剩下的两个span都不在边界区域内

const bool twoInts = ((regs[c] | regs[d]) & RC_BORDER_REG) == 0;

// 剩下的两个span的地表相同

const bool intsSameArea = (regs[c]>>16) == (regs[d]>>16);

// 四个点都是可行走平面

const bool noZeros = regs[a] != 0 && regs[b] != 0 && regs[c] != 0 && regs[d] != 0;

if (twoSameExts && twoInts && intsSameArea && noZeros)

{

// 则当前轮廓点在边界上

isBorderVertex = true;

break;

}

}

return ch;

}

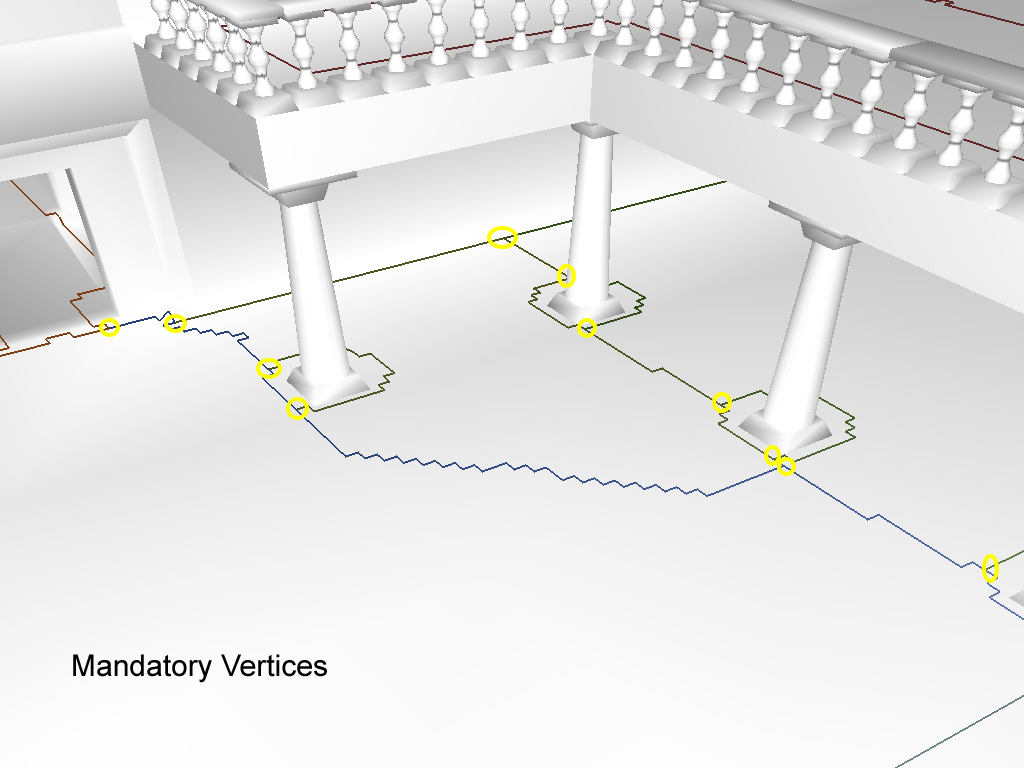

获取轮廓强制顶点

经过上面的轮廓点构造之后,每个区域都可以使用连续且闭合的轮廓点路径来描述。但是这个路径里的相邻轮廓点组成的边数量太多了,因为相邻的两个轮廓点要么是轴邻居要么是对角线邻居,最大距离只有3。

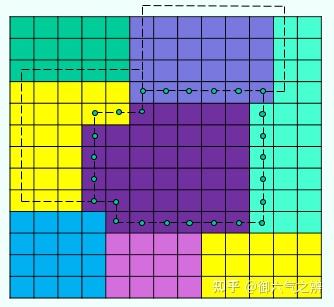

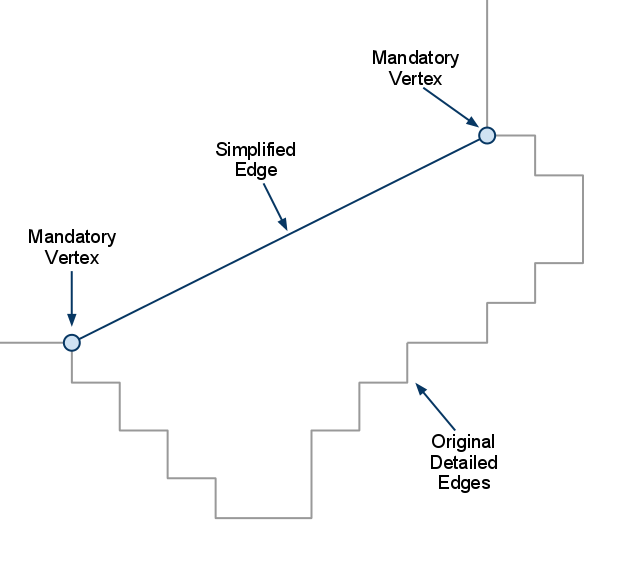

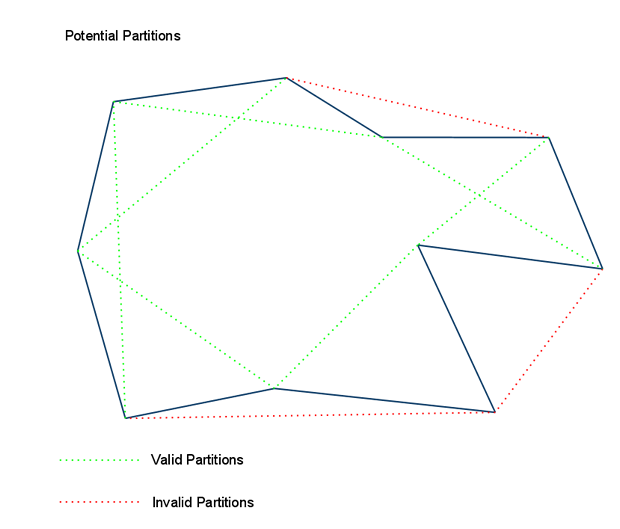

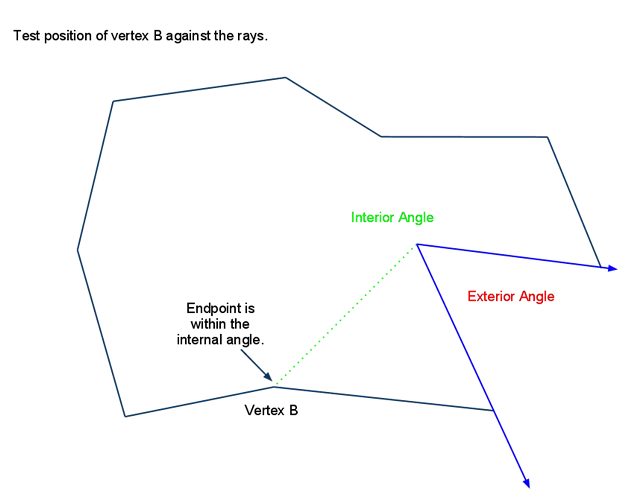

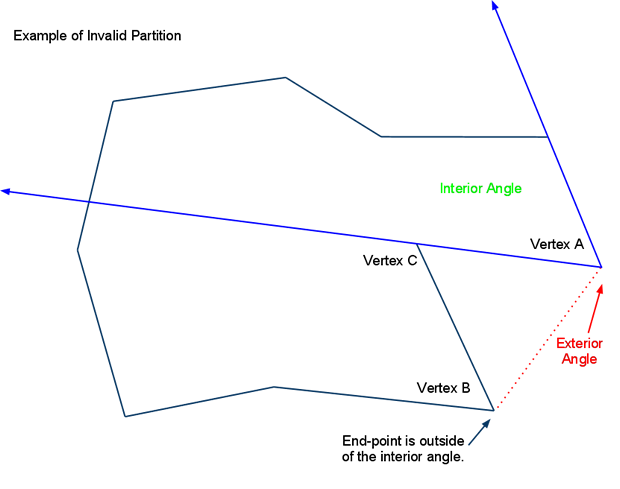

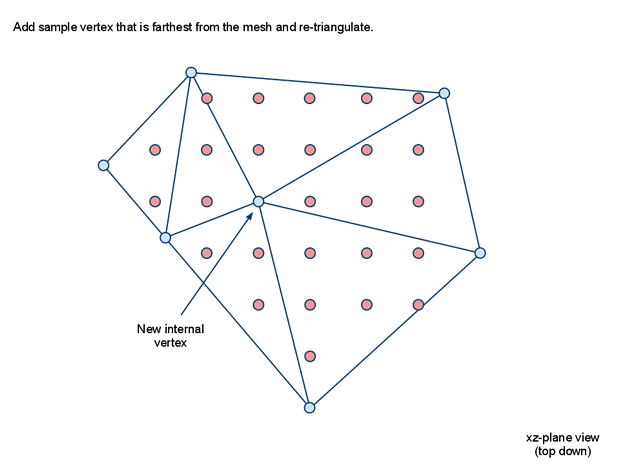

在平面中其实很多轮廓点是共线的,或者近似共线。如上图所示,连续轮廓点组成了很多的轴平行直线或者锯齿样折线。对于一条线段来说,只使用首尾两个端点的数据即可描述,然而其体素化的点数量则与线段长度正相关。所以接下来Recast将连续相邻的轮廓点闭合路径转简化形状相似的线段闭合路径,用这个线段闭合路径来描述区域,这个简化过程其实就是轮廓点的删除过程。为了确定哪些轮廓点可以删除哪些轮廓点必须保留,Recast引入了强制顶点(Mandatory Vertices)的概念:区域连接发生变化的顶点。这种强制顶点需要满足下面的两个条件之一:

-

两个可行走区域边界上的顶点

-

可行走区域与不可行走区域边界上的顶点

这个简化过程会将对应的函数为simplifyContour::

static void simplifyContour(rcIntArray& points, rcIntArray& simplified,

const float maxError, const int maxEdgeLen, const int buildFlags)

points参数里存储了一个区域的轮廓点数组, 每个轮廓点由四个整数组成(x,y,z,r),这里的r是通过前述的walkContour构造而来的,低16位代表区域标识符,如果为0则代表不可行走:

// walkcontour中的r相关代码片段

static const int RC_BORDER_VERTEX = 0x10000;

static const int RC_AREA_BORDER = 0x20000;

bool isBorderVertex = false;

bool isAreaBorder = false;

int py = getCornerHeight(x, y, i, dir, chf, isBorderVertex);

r = (int)chf.spans[ai].reg;

if (area != chf.areas[ai])

isAreaBorder = true;

if (isBorderVertex) // 如果当前轮廓点连通到不可行走区域 则设置此bit为true

r |= RC_BORDER_VERTEX;

if (isAreaBorder)

r |= RC_AREA_BORDER; // 如果当前轮廓点会连接不同的地表 则设置此bit为true

在simplifyContour中,开头先找到初始的简化点:

static const int RC_CONTOUR_REG_MASK = 0xffff;

// Add initial points.

bool hasConnections = false; // 这个代表是否连通到其他可行走区域

for (int i = 0; i < points.size(); i += 4) // 每个轮廓点用了四个int(x,y,z,r)

{

if ((points[i+3] & RC_CONTOUR_REG_MASK) != 0)

{

hasConnections = true;

break;

}

}

if (hasConnections)

{

// 找到轮廓点中邻居区域发生改变的点

for (int i = 0, ni = points.size()/4; i < ni; ++i)

{

int ii = (i+1) % ni;

// 相邻两个点的连通邻居不一样

const bool differentRegs = (points[i*4+3] & RC_CONTOUR_REG_MASK) != (points[ii*4+3] & RC_CONTOUR_REG_MASK);

// 出现了从可行走区域到不可行走区域的变化

const bool areaBorders = (points[i*4+3] & RC_AREA_BORDER) != (points[ii*4+3] & RC_AREA_BORDER);

if (differentRegs || areaBorders)

{

// 将(x, y, z, i) 这四元组存储到simplified中

simplified.push(points[i*4+0]);

simplified.push(points[i*4+1]);

simplified.push(points[i*4+2]);

simplified.push(i);

}

}

}

下图中使用黄色圆圈来标注一些符合上述要求的强制顶点:

如果当前区域没有符合要求的简化点,则会选择左下和右上的两个点作为简化点:

if (simplified.size() == 0)

{

// If there is no connections at all,

// create some initial points for the simplification process.

// Find lower-left and upper-right vertices of the contour.

int llx = points[0];

int lly = points[1];

int llz = points[2];

int lli = 0;

int urx = points[0];

int ury = points[1];

int urz = points[2];

int uri = 0;

for (int i = 0; i < points.size(); i += 4)

{

int x = points[i+0];

int y = points[i+1];

int z = points[i+2];

if (x < llx || (x == llx && z < llz))

{

llx = x;

lly = y;

llz = z;

lli = i/4;

}

if (x > urx || (x == urx && z > urz))

{

urx = x;

ury = y;

urz = z;

uri = i/4;

}

}

simplified.push(llx);

simplified.push(lly);

simplified.push(llz);

simplified.push(lli);

simplified.push(urx);

simplified.push(ury);

simplified.push(urz);

simplified.push(uri);

}

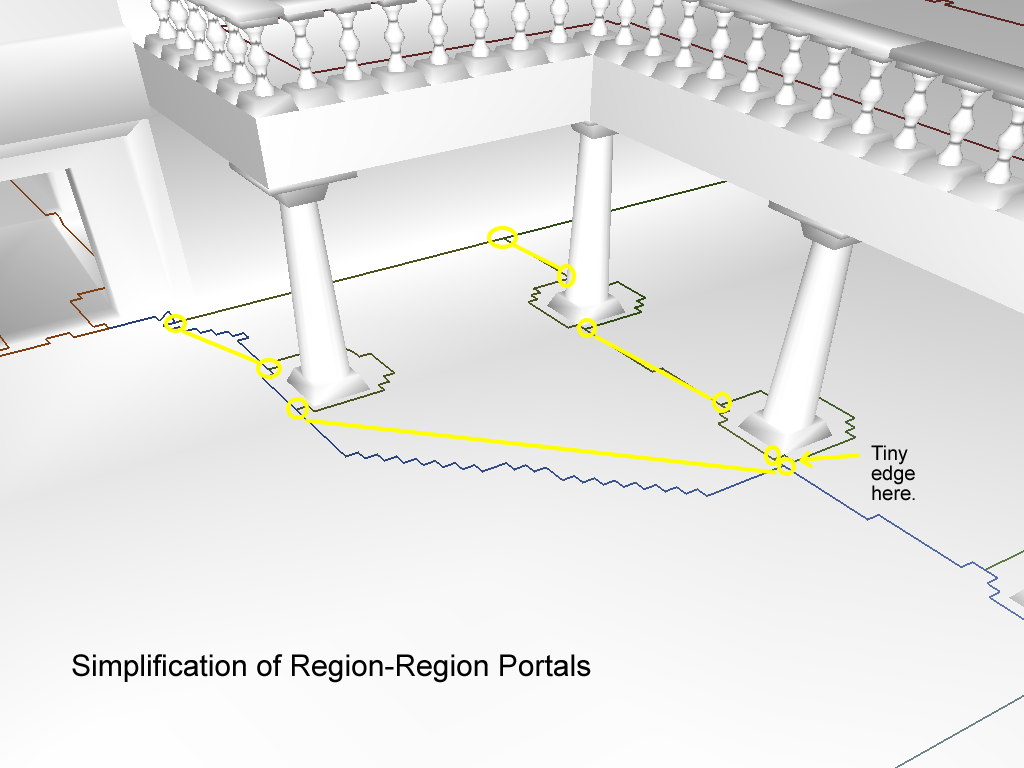

获取了强制顶点之后,将一个区域内按照顺时针存储的强制顶点首尾相连,就形成了当前区域的简化边界:

回收轮廓点来匹配区域边界

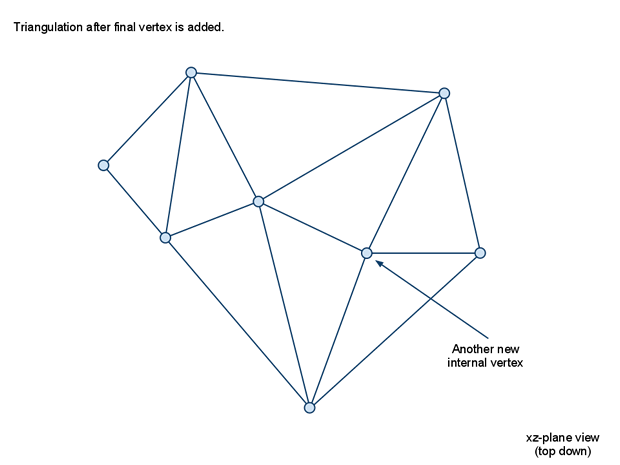

不过这样的简化边界可能过于简化了,会导致与原始区域不怎么匹配。此时需要找到原始的轮廓点里与对应的简化边界距离大于最大简化误差maxSimplificationError的点,重新插入到简化边界中,使得边界更匹配原始区域形状。这里的距离计算使用的是在XZ平面上点到直线的距离,因此执行轮廓点回收之后,多边形的XZ平面投影能够更加的拟合原始区域的XZ投影。

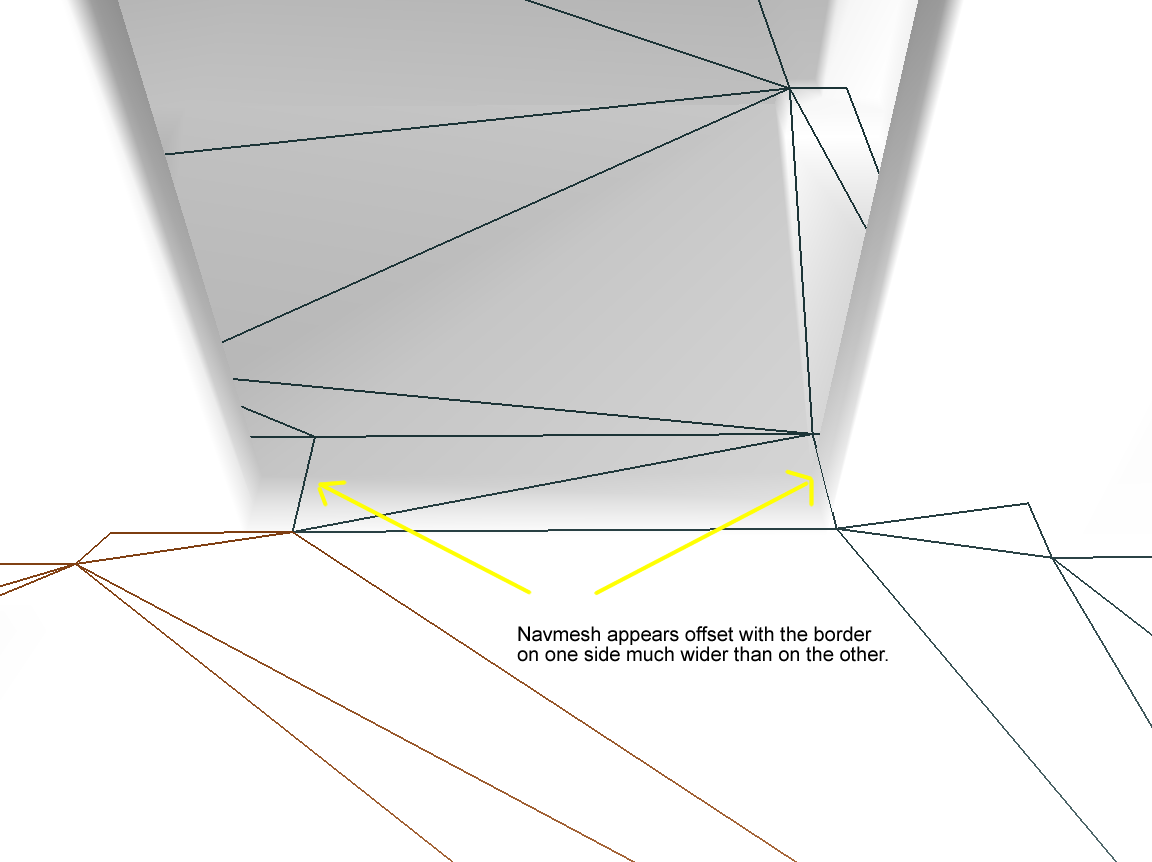

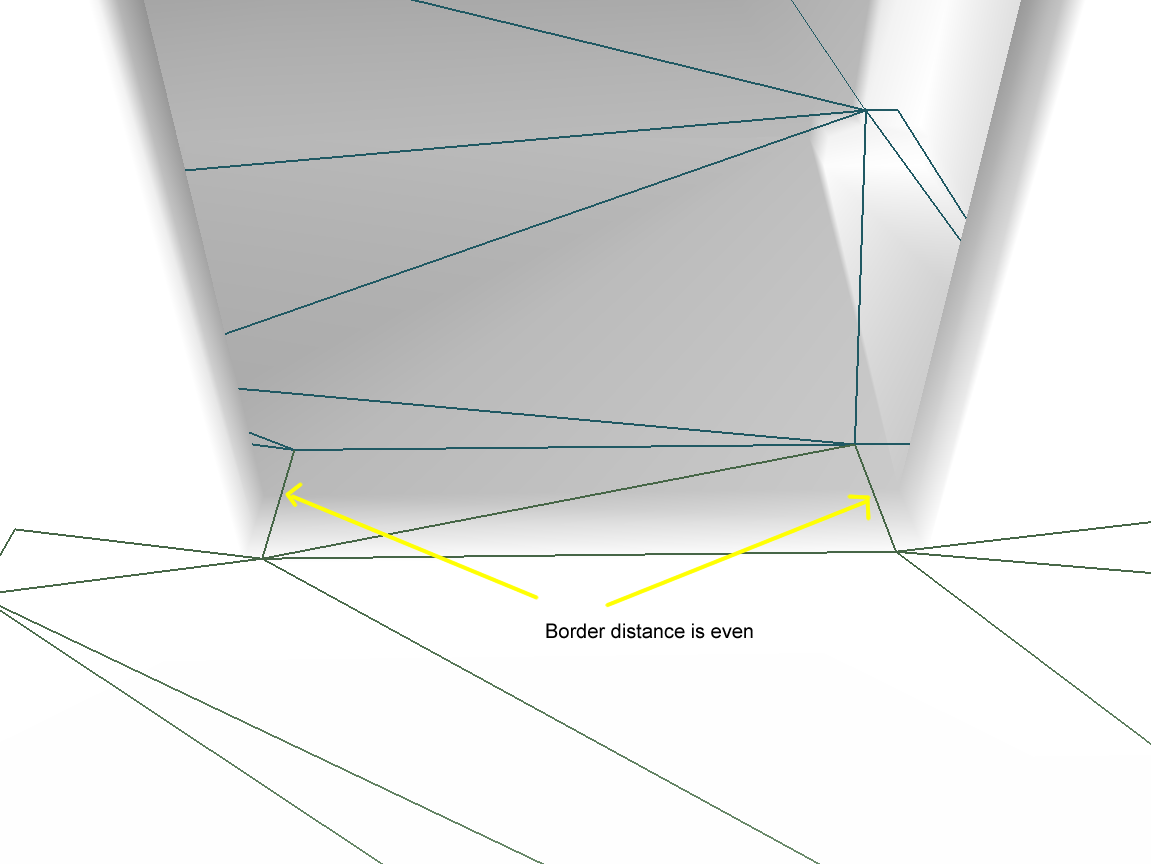

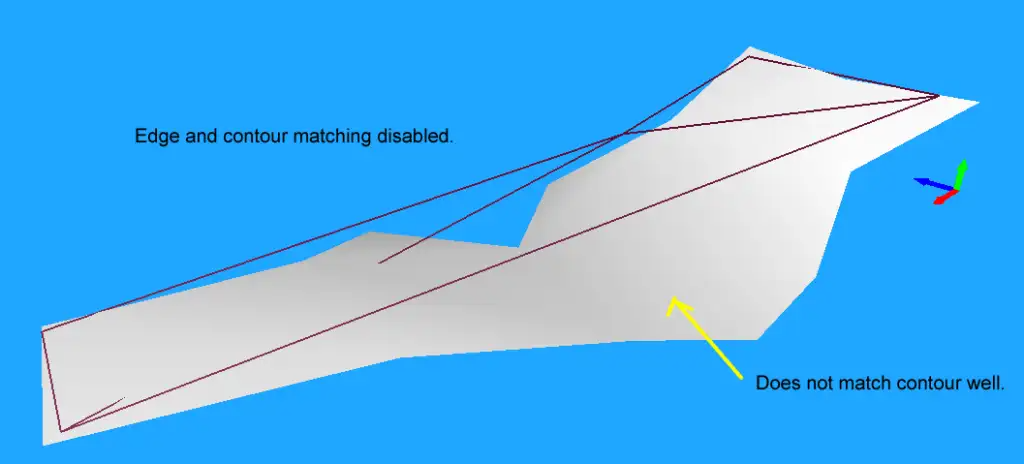

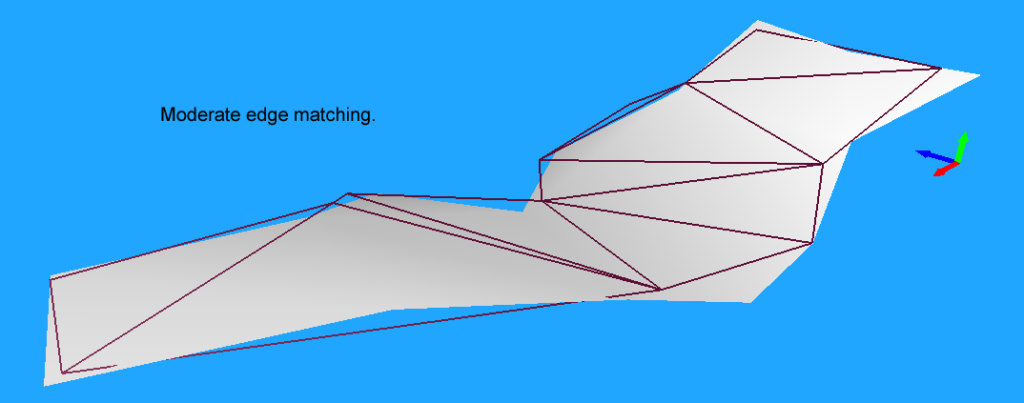

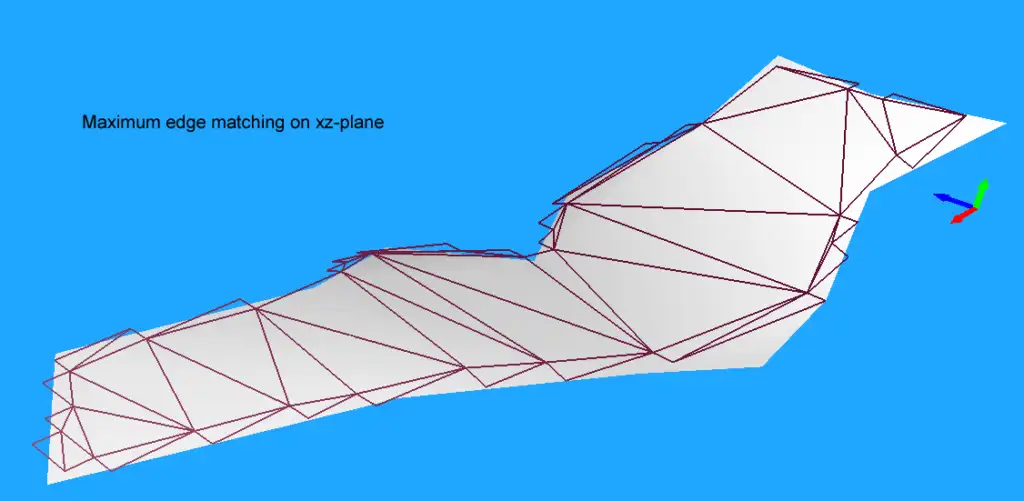

当完全不使用maxSimplificationError来添加节点的时候,会产生下面的偏移比较严重的边界:

使用合适大小的最大简化误差来增加轮廓点之后,得到了一个比较完美的匹配:

不过此参数如果设置的太小,会导致回收了太多的轮廓点从而生成了很多的小多边形,反而影响后续各种处理的效率:

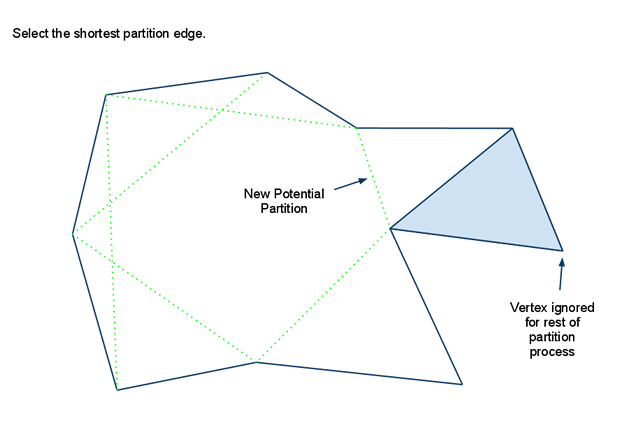

这个过程其实是一个递归过程,每次处理存储在simplified两个相邻的简化点A,B,这两个简化点对应的points数组连续区间为[C, D],遍历[C, D]中所有的点计算到边(A, B)的距离最大值,如果这个最大值大于了maxSimplificationError,则将距离最大值对应的点E插入到simplified数组中,使得A,E,B是三个相邻的元素,然后再对A,E递归处理。

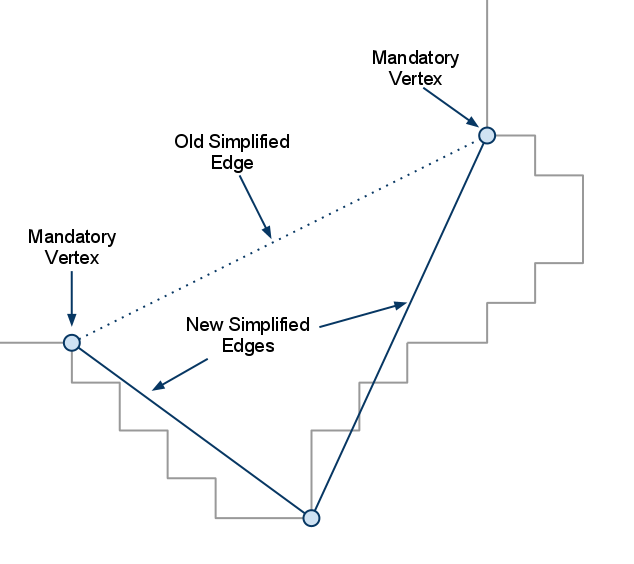

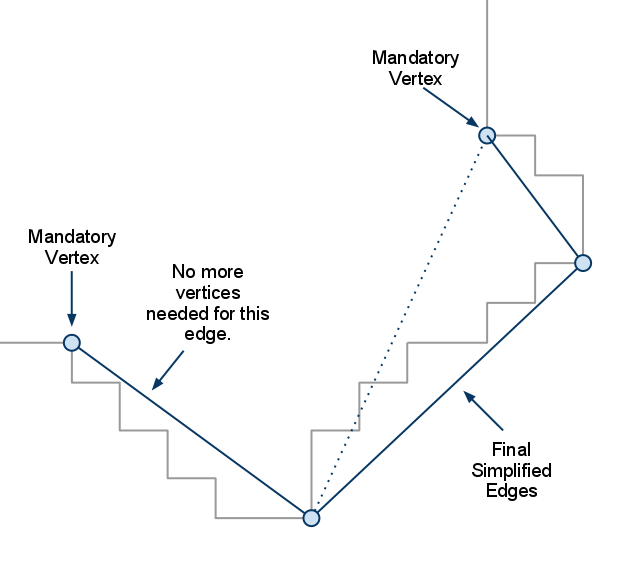

下面给出这个递归处理的图例来加深理解,初始时我们选择了两个点,构造了一条简化边:

找到覆盖的原始轮廓点区间内与这条简化边偏移最大的,如果大于偏移误差则添加这个点到简化点中,同时构造了两个新的简化边:

然后再递归处理这两条新的边,直到没有新的简化点出现,代表最开始的简化边的轮廓点回收执行完成:

对应的代码如下:

// Add points until all raw points are within

// error tolerance to the simplified shape.

const int pn = points.size()/4;

for (int i = 0; i < simplified.size()/4; )

{

// 获取相邻的两个点 构造一条简化边

int ii = (i+1) % (simplified.size()/4);

int ax = simplified[i*4+0];

int az = simplified[i*4+2];

int ai = simplified[i*4+3];

int bx = simplified[ii*4+0];

int bz = simplified[ii*4+2];

int bi = simplified[ii*4+3];

// Find maximum deviation from the segment.

float maxd = 0;

int maxi = -1;

// 下面三个变量是用来控制节点便利时的方向

int ci, cinc, endi;

// 下面的操作来确保b点一定在a点右侧 这样方便后续的距离计算

if (bx > ax || (bx == ax && bz > az))

{

cinc = 1;

ci = (ai+cinc) % pn;

endi = bi;

}

else

{

// 不在右侧则swap

cinc = pn-1;

ci = (bi+cinc) % pn;

endi = ai;

rcSwap(ax, bx);

rcSwap(az, bz);

}

// 只处理与不可连通区域交界的边

if ((points[ci*4+3] & RC_CONTOUR_REG_MASK) == 0 ||

(points[ci*4+3] & RC_AREA_BORDER))

{

while (ci != endi)

{

float d = distancePtSeg(points[ci*4+0], points[ci*4+2], ax, az, bx, bz);

if (d > maxd)

{

maxd = d; // 获取简化边对应的节点区间内离简化边最远的点索引

maxi = ci;

}

ci = (ci+cinc) % pn;

}

}

if (maxi != -1 && maxd > (maxError*maxError))

{

// 添加这个最远点到simplified数组中

simplified.resize(simplified.size()+4);

const int n = simplified.size()/4;

for (int j = n-1; j > i; --j)

{

// 触发了所有后续节点的移动

simplified[j*4+0] = simplified[(j-1)*4+0];

simplified[j*4+1] = simplified[(j-1)*4+1];

simplified[j*4+2] = simplified[(j-1)*4+2];

simplified[j*4+3] = simplified[(j-1)*4+3];

}

simplified[(i+1)*4+0] = points[maxi*4+0];

simplified[(i+1)*4+1] = points[maxi*4+1];

simplified[(i+1)*4+2] = points[maxi*4+2];

simplified[(i+1)*4+3] = maxi;

}

else

{

// 没有需要添加的点 处理下一条简化边

++i;

}

}

回收了一些轮廓点之后,得到了下图中的简化轮廓:

拆分过长的边界线段

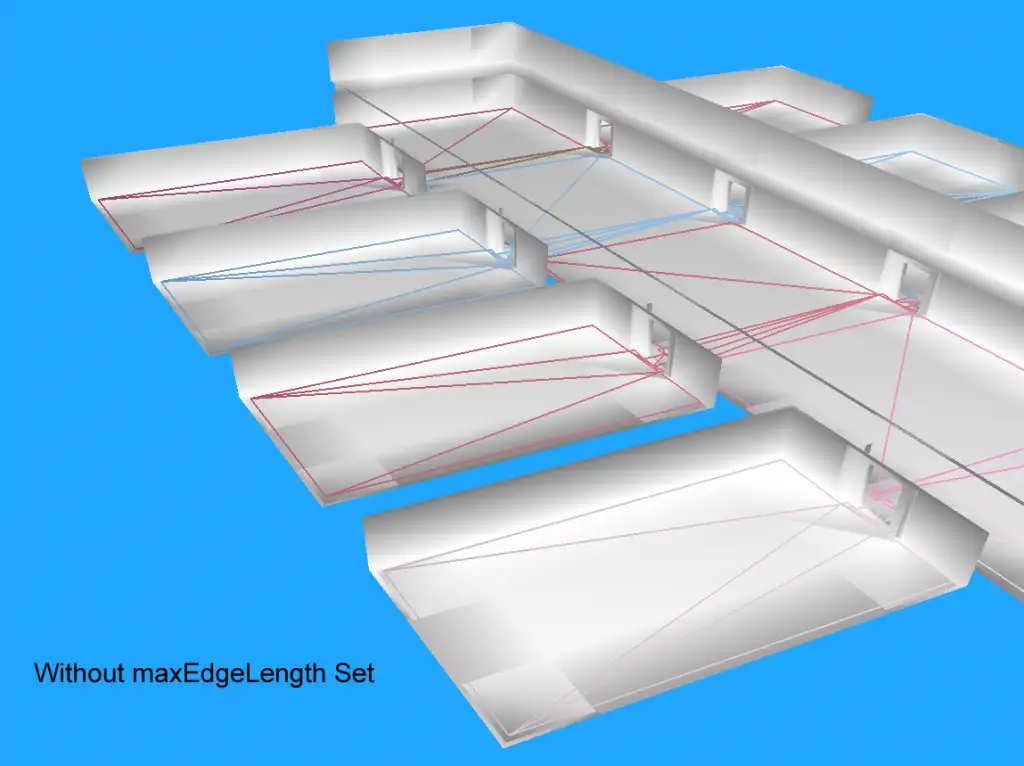

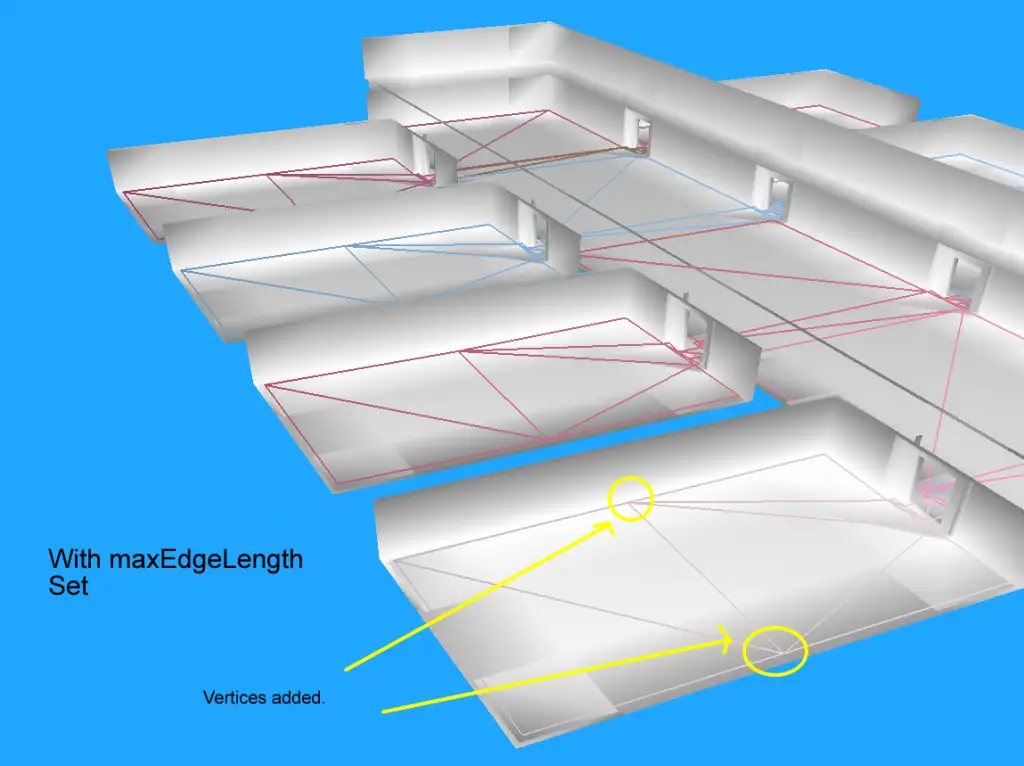

为了避免在后续的三角化分中出现过于长且细的三角形,接下来还有一步后处理,将太长的简化边进行切分,这里使用了外部传递过来的maxEdgeLen作为边长度的筛选参数。

在开启这个长边拆分之前,生成的三角形如下:

开启长边拆分后,生成的三角形如下:

这个长边拆分执行过程与前面的回收轮廓点的流程基本差不多,也是一个递归过程:

// Split too long edges.

if (maxEdgeLen > 0 && (buildFlags & (RC_CONTOUR_TESS_WALL_EDGES|RC_CONTOUR_TESS_AREA_EDGES)) != 0)

{

for (int i = 0; i < simplified.size()/4; )

{

const int ii = (i+1) % (simplified.size()/4);

const int ax = simplified[i*4+0];

const int az = simplified[i*4+2];

const int ai = simplified[i*4+3];

const int bx = simplified[ii*4+0];

const int bz = simplified[ii*4+2];

const int bi = simplified[ii*4+3];

// Find maximum deviation from the segment.

int maxi = -1;

int ci = (ai+1) % pn;

bool tess = false;

// 靠近非连通区域的边

if ((buildFlags & RC_CONTOUR_TESS_WALL_EDGES) && (points[ci*4+3] & RC_CONTOUR_REG_MASK) == 0)

tess = true;

// 靠近不同地表的边

if ((buildFlags & RC_CONTOUR_TESS_AREA_EDGES) && (points[ci*4+3] & RC_AREA_BORDER))

tess = true;

if (tess)

{

int dx = bx - ax;

int dz = bz - az;

if (dx*dx + dz*dz > maxEdgeLen*maxEdgeLen)

{

// 如果当前边长度过长

const int n = bi < ai ? (bi+pn - ai) : (bi - ai);

if (n > 1) // 两点之间有其他轮廓点

{

// 则将边对应轮廓点区间的中间点加入

if (bx > ax || (bx == ax && bz > az))

maxi = (ai + n/2) % pn;

else

maxi = (ai + (n+1)/2) % pn;

}

}

}

// 将这个指定点添加到simplified数组 构造出两条新的边

if (maxi != -1)

{

// Add space for the new point.

// 这段代码与前一段代码块中对应内容一样 因此省略

}

else

{

++i;

}

}

}

创建基础轮廓信息

/// Represents a simple, non-overlapping contour in field space.

struct rcContour

{

int* verts; ///< Simplified contour vertex and connection data. [Size: 4 * #nverts]

int nverts; ///< The number of vertices in the simplified contour.

int* rverts; ///< Raw contour vertex and connection data. [Size: 4 * #nrverts]

int nrverts; ///< The number of vertices in the raw contour.

unsigned short reg; ///< The region id of the contour.

unsigned char area; ///< The area id of the contour.

};

rcContour* cont = &cset.conts[cset.nconts++];

cont->nverts = simplified.size()/4;

cont->verts = (int*)rcAlloc(sizeof(int)*cont->nverts*4, RC_ALLOC_PERM);

if (!cont->verts)

{

ctx->log(RC_LOG_ERROR, "rcBuildContours: Out of memory 'verts' (%d).", cont->nverts);

return false;

}

memcpy(cont->verts, &simplified[0], sizeof(int)*cont->nverts*4);

cont->nrverts = verts.size()/4;

cont->rverts = (int*)rcAlloc(sizeof(int)*cont->nrverts*4, RC_ALLOC_PERM);

if (!cont->rverts)

{

ctx->log(RC_LOG_ERROR, "rcBuildContours: Out of memory 'rverts' (%d).", cont->nrverts);

return false;

}

memcpy(cont->rverts, &verts[0], sizeof(int)*cont->nrverts*4);

cont->reg = reg;

cont->area = area;

消除空洞

在使用分水岭算法生成区域时,如果遇到一些无法寻路的小凸起,会形成一些不可寻路的小空洞。如果这个空洞的外围属于同一个区域的话,会导致区域的边界无法组成一个简单多边形,导致后续的三角形切分失败。所以区域轮廓生成的最后一部需要将这些空洞对应的多边形轮廓删除,合并到包围这个空洞的区域内。